The Temporal Opportunist: Self-Supervised Multi-Frame Monocular Depth

ABSTRACT

提出目前存在的问题

对于许多应用来说,视频帧的序列信息在测试阶段也可以获得,但大多数单目网络没有使用这个额外的信号,忽略了重要的信息;这些方法要么在测试阶段使用计算量大的细化技术,要么采用非循环网络,间接使用那些本就可获得的几何信息。

本文方法和创新点

提出了ManyDepth,一种自适应的稠密深度估计方法,能够在测试阶段利用序列信息。

提出了一个端到端的cost volume,基于只用自监督训练的方法

采用了一个新的一致性损失,当cost volume不可靠时忽略它

实验效果提升

在KITTI和Cityscape上的实验表明我们的方法比所有已发布的自监督baseline都要好,包括那些在测试阶段使用单帧或多帧的方法。

INTRODUCTION

问题:

在测试阶段,实际情况下可以得到不止一帧,而现有的单目方法没有使用这些额外的帧

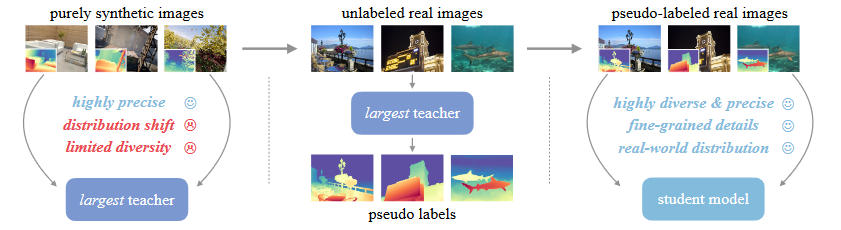

将子监督训练直接应用于多视角平面扫描立体结构会产生较差的结果

本文提出(创新点)

① 在训练和测试阶段都使用这些额外的帧来对多帧的深度估计系统进行自监督

② 使用了一些新方法来处理由移动物体,尺寸模糊和静态相机引起的问题

一个新的自监督多帧深度估计模型

引入了有效的损失和训练解决方法来解决运动物体和静态场景的影响

提出了一个自适应cost volume解决尺度模糊问题

PROPOSED METHOD

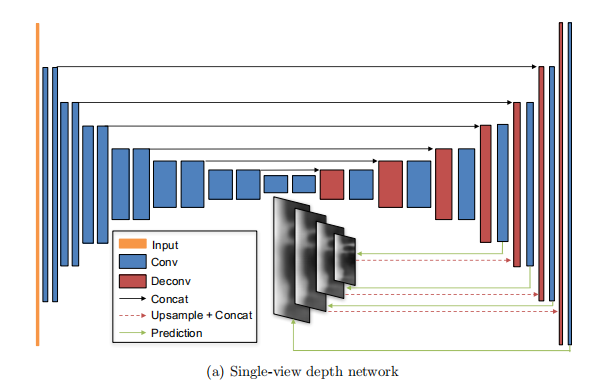

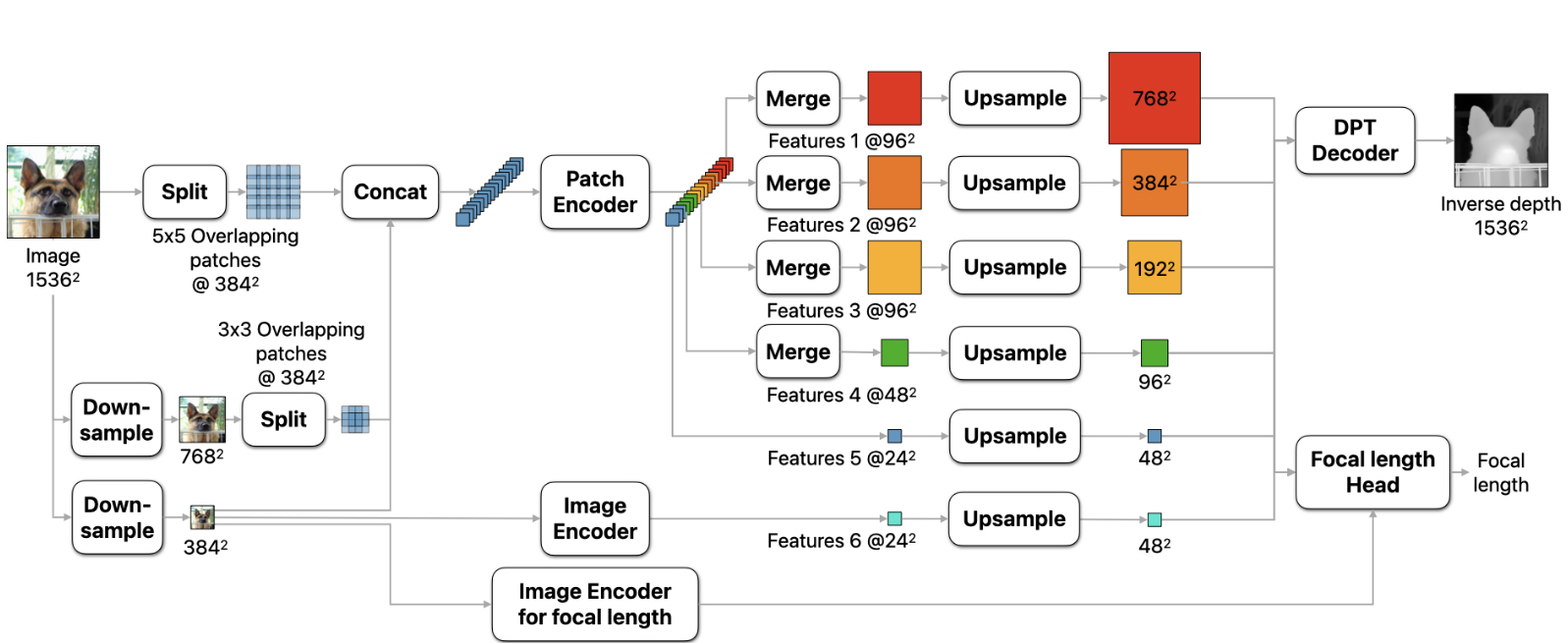

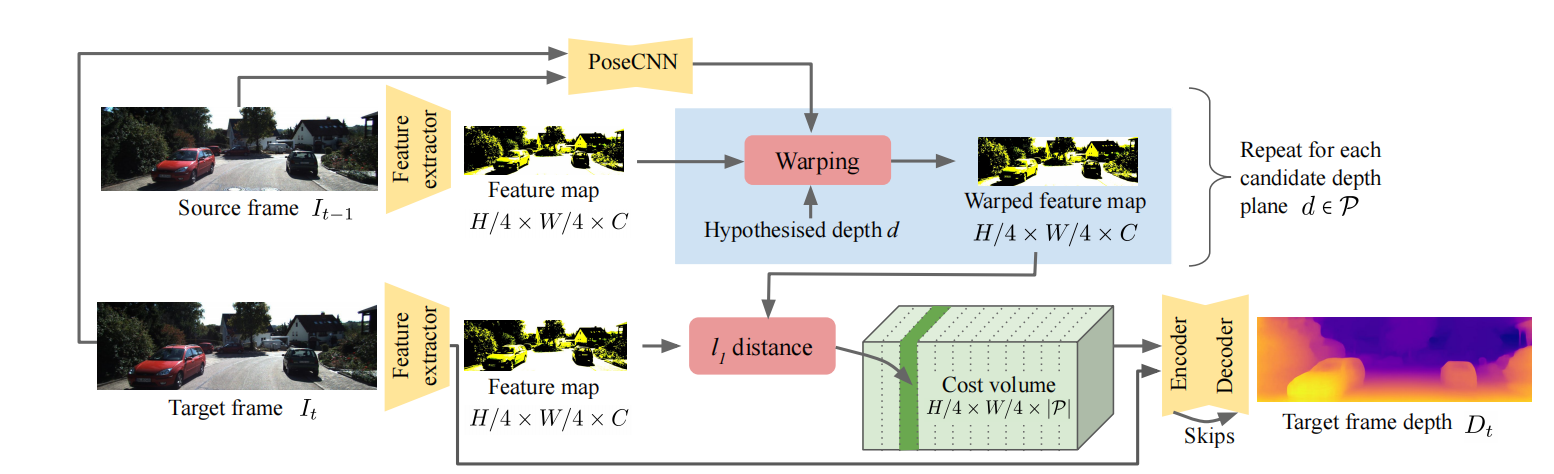

模型结构

使用前后帧作为监督信号

在训练和测试阶段用一个可微的位姿网络预测位姿

不需要对运动的物体进行mask

假设已知固定地相机内参

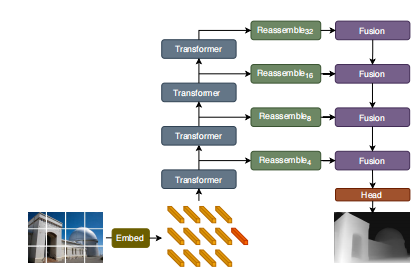

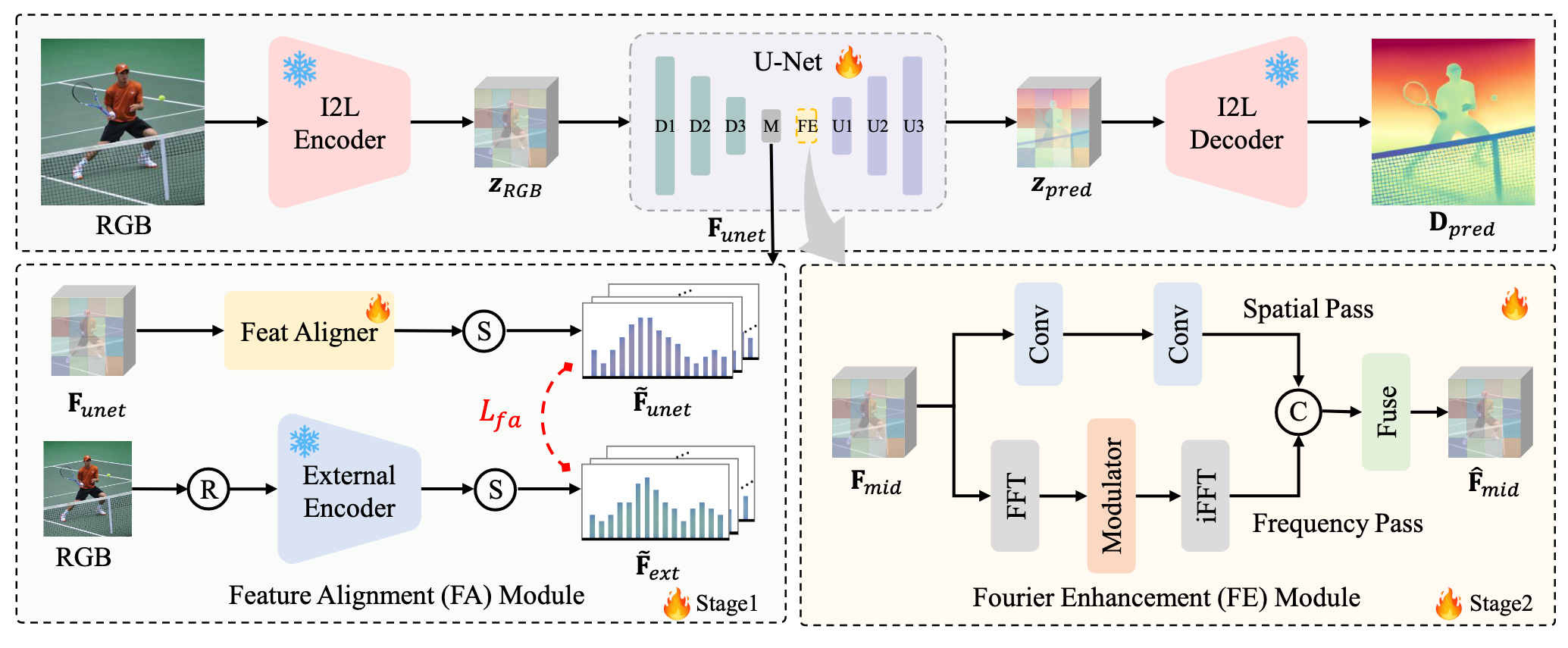

模型分解—1:自监督单目深度估计

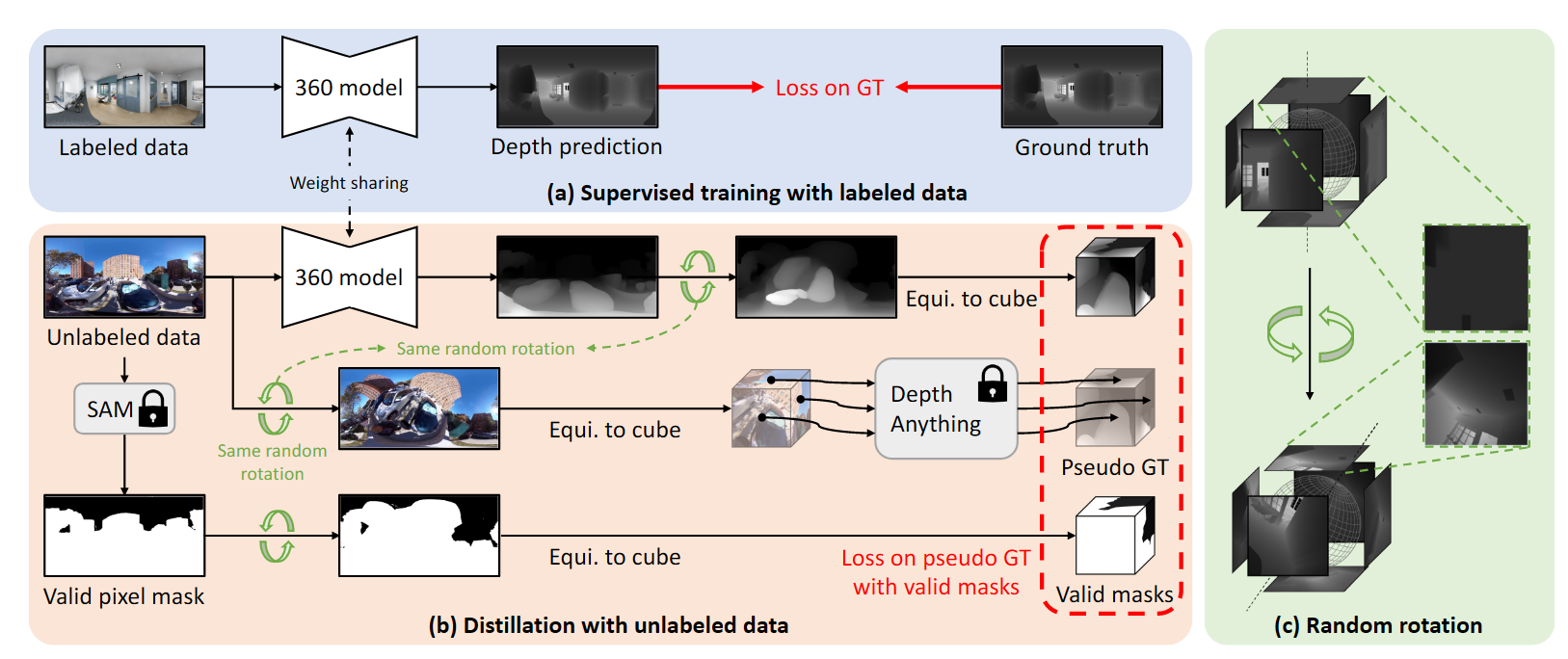

模型分解—2:构建cost volume

衡量目标图像中像素和附近源图像中像素的在不同深度值的几何兼容性

最终的cost volume是扭曲后的特征图与It的特征图之间的绝对差异,描述了对于某一像素,P中每一个d,其是正确深度的可能性有多少

能够使网络利用不同视角的输入

模型分解—3:自适应cost volume

问题:需要已知的深度范围

解决方法:让深度范围从数据中学习得到

在一个训练batch内,计算预测的深度图的平均最小与最大值,并用此数据来更新dmin和dmax的指数移动平均估计。

处理cost volume过拟合

cost volume中的信息旨在特定的环境下可靠,如具有纹理表面的静态区域

使用单独的网络进行规范,对每一个训练图像生成一个深度图,用一个二值的mask来定义可能有问题的像素

模型分解—4:静止相机和序列的开始

问题:如何预测那些处于序列开始的图像的深度

解决方法:在概率为p的训练过程中,将cost volume替换为零张量,在测试时,如果It-1不存在,就将cost volume替换为0

问题:相机在It-1和It之间没有移动

解决方法:在训练阶段,概率为q,将It-1替换为cost volume,为It的颜色增强版本