VGGT-Ω

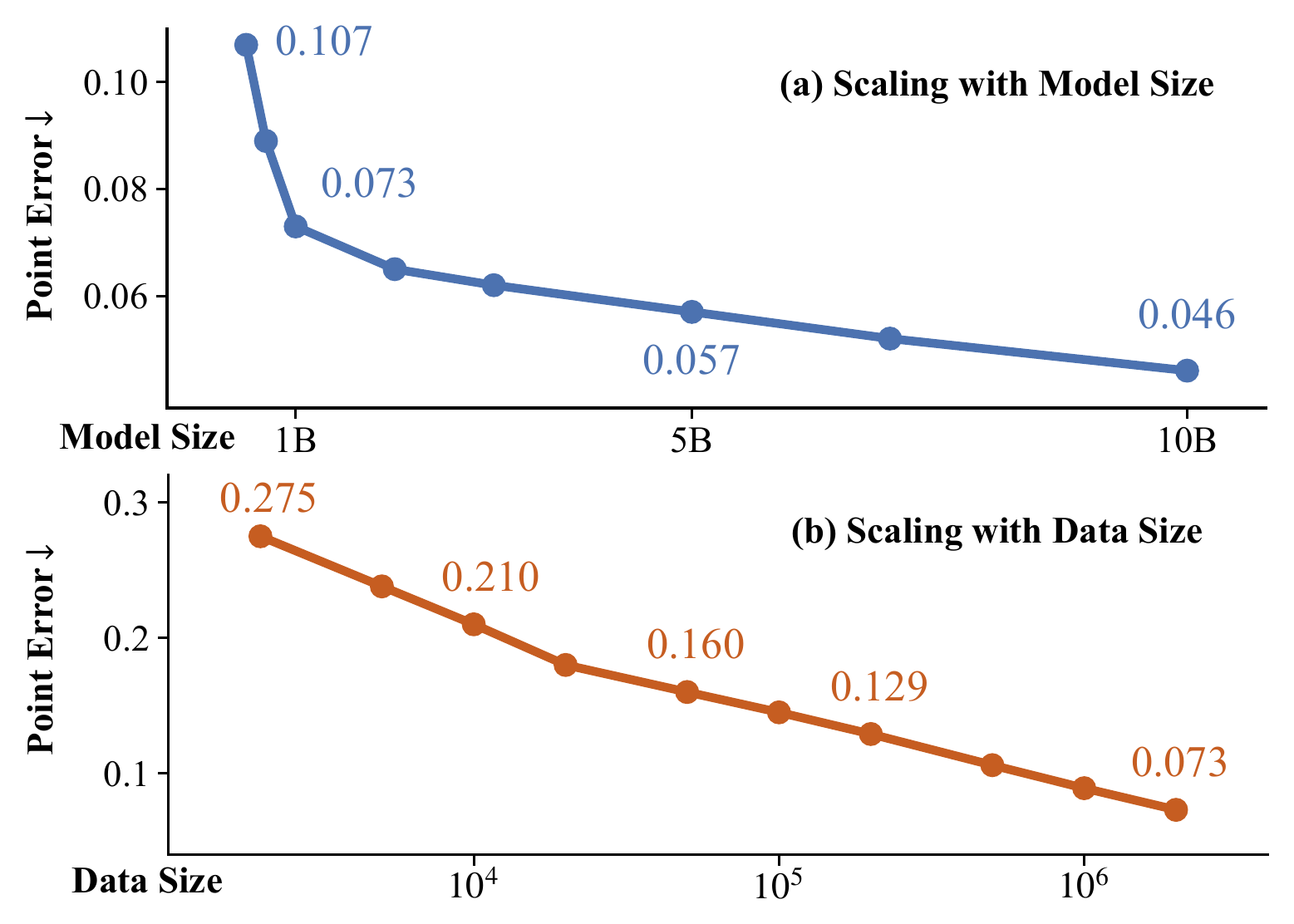

作者:Jianyuan Wang, Minghao Chen, Shangzhan Zhang, Nikita Karaev, Johannes Schönberger, Patrick Labatut, Piotr Bojanowski, David Novotny, Andrea Vedaldi, Christian Rupprecht 单位:Visual Geometry Group, University of Oxford; Meta AI 会议:CVPR 2026 Oral / 2026 Arxiv 链接:https://arxiv.org/abs/2605.15195, Project Page 研究动机VGGT-Ω 这篇文章关心的不是“能不能再把 VGGT 做强一点”,而是一个更底层的问题:前馈式三维重建模型是否也像语言模型、2D 视觉基础模型一样,具有可预期的 scaling law。原始 VGGT 已经证明了 feed-forward reconstruction 可以在很多场景中接近甚至超过传统 SfM/优化式方法,但它仍然有几个限制: 全局...

LoRA: Low-Rank Adaptation of Large Language Models

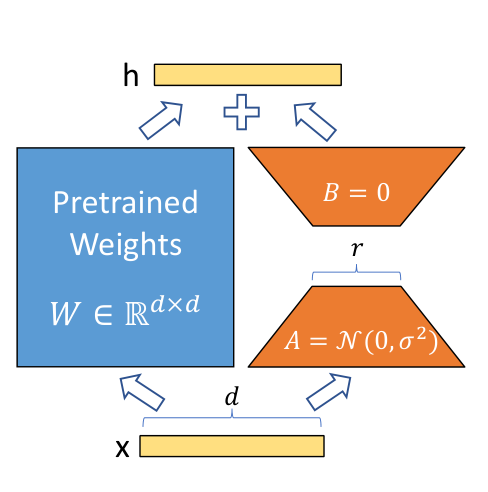

作者:Edward J. Hu, Yelong Shen, Phillip Wallis, Zeyuan Allen-Zhu, Yuanzhi Li, Shean Wang, Lu Wang, Weizhu Chen 单位:Microsoft Corporation 会议:ICLR 2022 Poster 链接:https://arxiv.org/abs/2106.09685, OpenReview, Code 研究动机1.大模型微调真正贵的地方,不只是一次训练的算力,而是每个下游任务都要保存和部署一整份模型权重。 以 GPT-3 175B 为例,论文把全量微调后的单任务模型存储开销估计为约 350GB。如果一个服务要支持很多任务,每个任务都保存一份完整模型,部署、切换、I/O 和显存都会变成系统瓶颈。 2.已有参数高效方法解决了“训练参数少”的一部分问题,但留下了新的部署代价。 Adapter 在 Transformer 层里串联额外模块,会增加推理深度,因此在线小 batch 场景下可能带来明显延迟;Prefix Tuning / Prompt Tuning 把可训练...

VLM3: Vision Language Models Are Native 3D Learners

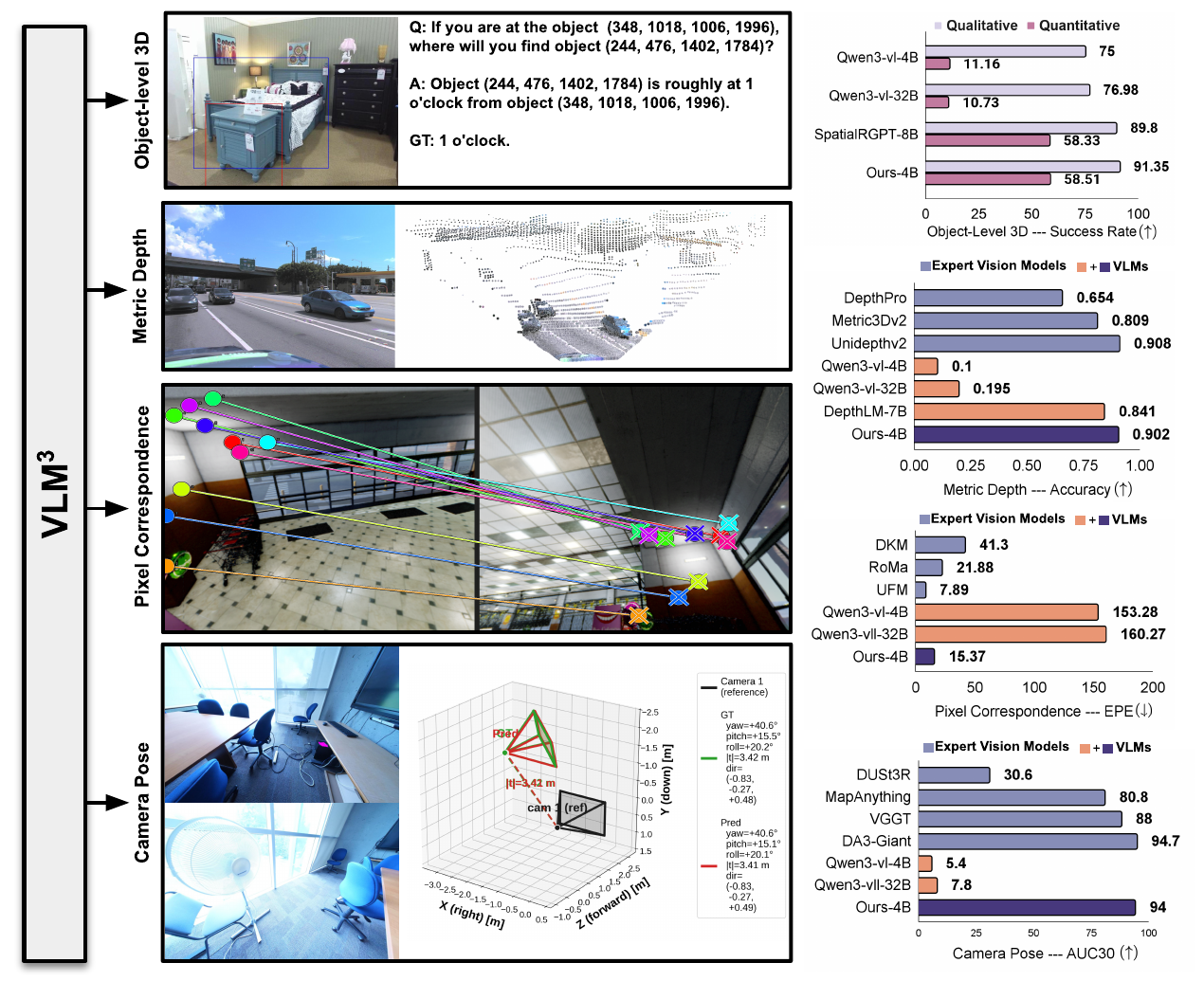

作者:Zhipeng Cai, Zhuang Liu, Yunyang Xiong, Zechun Liu, Vikas Chandra, Yangyang Shi 单位:Meta, Princeton University 会议:2026 Arxiv 链接:https://arxiv.org/abs/2605.30561 代码:https://github.com/facebookresearch/VLM3 研究动机 这篇文章的核心问题不是再做一个 3D 专家模型,而是反过来追问: 标准 VLM 在不改架构、不加专门 3D head、不使用复杂回归损失的情况下,能否通过文本监督学会细粒度 3D 任务? 这个问题成立的背景有三层。 现有 VLM 在语义理解上很强,但 3D 理解仍然经常依赖专门模型。例如深度估计、像素对应、相机位姿估计通常需要 DPT/FPN/匹配网络/位姿回归头等任务结构。 近期 DepthLM 已经说明,标准 VLM 可以通过文本输出单点 metric depth,但它仍然依赖视觉 marker...

Unified Panoramic Geometry Estimation via Multi-View Foundation Models

作者:Vukasin Bozic, Isidora Slavkovic, Dominik Narnhofer, Nando Metzger, Denis Rozumny, Konrad Schindler, Nikolai Kalischek 单位:ETH Zurich, Google, Athlence Sports, Meta 会议:2026 arXiv(NeurIPS 2026 preprint,未见公开接收信息) 链接:https://arxiv.org/abs/2605.26368 研究动机 透视图上的几何基础模型这两年进步很快,像 DA3 这类多视角 Transformer 已经能把单张图像也做出相当强的三维几何重建能力。但它们默认服务的是 perspective image,每张图只有局部视野,做完整空间理解仍然要靠多视角拼接。 全景图天然覆盖 $360^\circ \times 180^\circ$,理论上更适合一次性恢复完整场景结构;问题在于现有全景深度/法线方法长期受两件事卡住:一是高质量全景几何数据少,模型容易在小数据集上过拟合;二是...

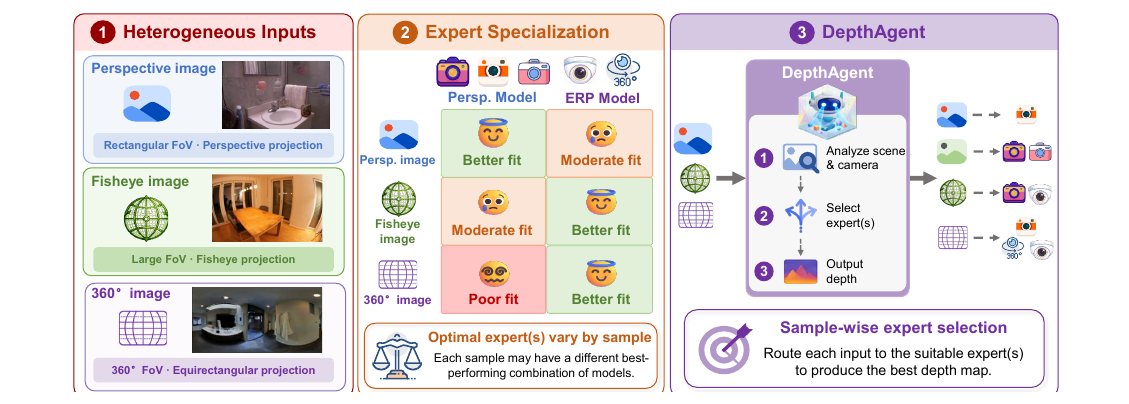

DepthAgent: Towards Better Universal Depth Estimation via Sample-wise Expert Selection

作者:Jie Zhu, Girish Chandar Ganesan, Xiaoming Liu 单位:Michigan State University, University of North Carolina at Chapel Hill 会议:2026 Arxiv 链接:https://arxiv.org/abs/2605.23281 研究动机 这篇文章的出发点很实际:现在单目 metric depth 模型已经很多,而且每个模型都很强,但真实部署时输入并不总是同一种相机。普通透视图、鱼眼图、ERP 全景图在成像几何上差别很大,一个模型即使在平均指标上很强,也不一定能稳定覆盖所有相机域。 已有“通用深度估计”通常试图训练一个统一模型,或者对多个模型做固定规则融合。但本文先指出一个更细的现象:不同 depth expert 的强弱不是随机的,而是和相机几何、场景类型、样本难度强相关。 Table 1 说明了这个现象。透视数据里,Perspective 系模型作为 best single 的比例达到 80.1%;Native ERP 数据里,ERP 系模型作为 best...

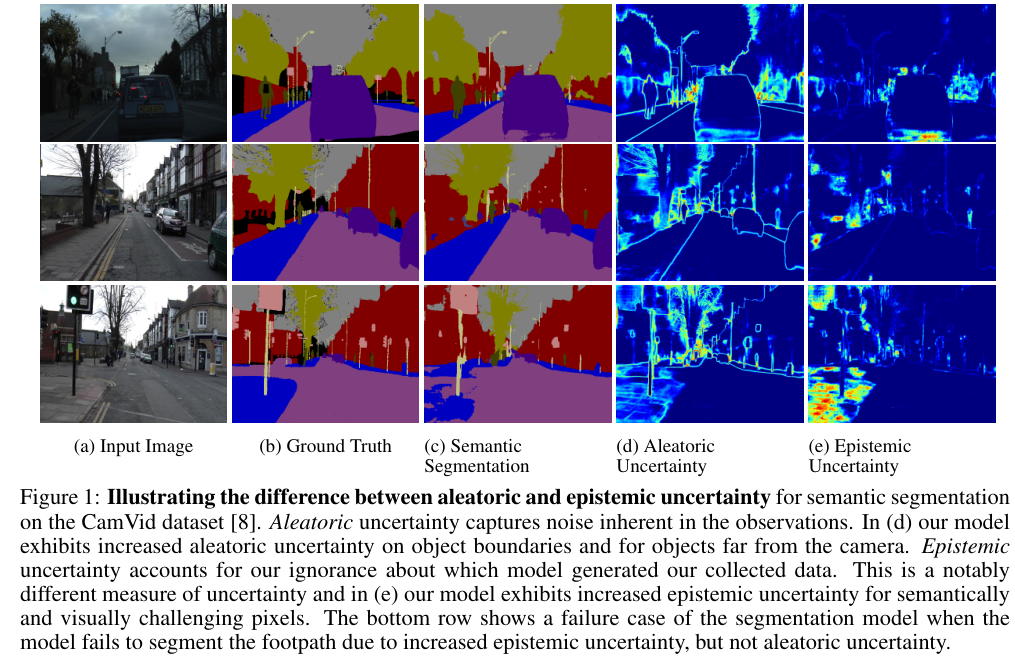

What Uncertainties Do We Need in Bayesian Deep Learning for Computer Vision?

作者:Alex Kendall, Yarin Gal 单位:University of Cambridge 会议:NIPS 2017 链接:https://arxiv.org/abs/1703.04977 研究动机这篇文章讨论的是一个很基础但长期被深度视觉模型忽略的问题:模型什么时候应该说“我不知道”。 在语义分割、深度估计、自动驾驶感知等任务中,模型输出通常被当作确定答案使用。但视觉输入里有两类不确定性: Aleatoric uncertainty:观测本身带来的噪声,例如远处物体、遮挡边界、反光区域、模糊深度标签。这类不确定性即使增加数据也不一定消失。 Epistemic uncertainty:模型认知不足带来的不确定性,例如训练集覆盖不够、测试样本分布偏离训练集。这类不确定性理论上可以通过更多数据降低。 Figure 1 是整篇论文的直观入口:aleatoric uncertainty 更像“图像/标注天然困难在哪里”,常出现在物体边界、远距离区域;epistemic uncertainty...

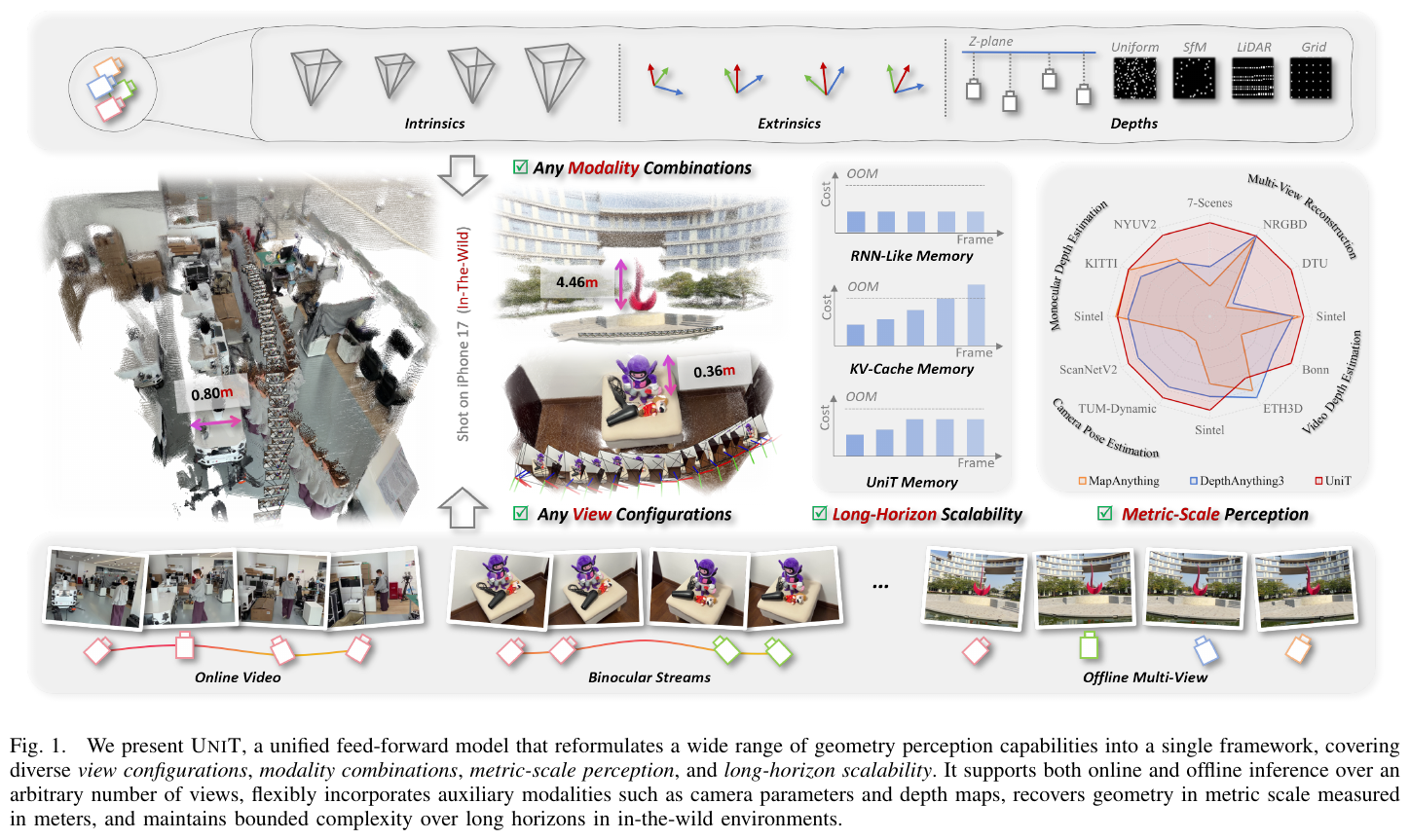

UniT: Unified Geometry Learning with Group Autoregressive Transformer

作者:Haotian Wang, Yusong Huang, Zhaonian Kuang, Hongliang Lu, Xinhu Zheng, Meng Yang, Gang Hua 单位:香港科技大学(广州), 西安交通大学, 亚马逊 会议:2026 Arxiv 链接:https://arxiv.org/abs/2605.21131 研究动机 三维几何感知是计算机视觉中的经典且核心的课题,旨在从多张图像观测中恢复出场景的三维结构(通常表示为三维点云)。近年来,以点图(Point Map)为核心表征的前馈 foundation 模型(例如 DUSt3R, MASt3R, Fast3R, VGGT, $\pi^3$, DepthAnything3 等)取得了突破性的成就,这主要得益于其将 2D-to-3D 对应关系学习与 3D-to-3D 几何推理无缝融合在单次模型前向传播中。 然而,尽管这些模型非常强大,它们的核心能力依然碎片化(Fragmented)地散落在多个互不兼容的学术与工业范式中,尚未统一: 在线流式感知(Online...

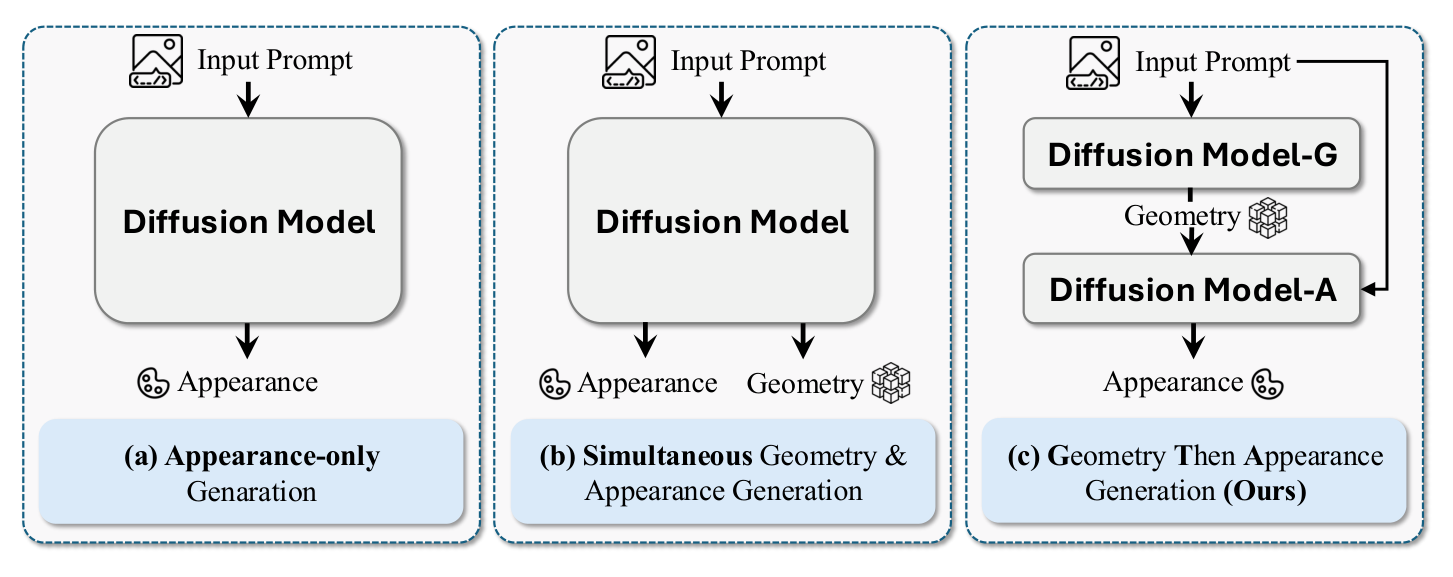

GTA: Advancing Image-to-3D World Generation via Geometry Then Appearance Video Diffusion

作者:Hanxin Zhu, Cong Wang, Peiyan Tu, Jiayi Luo, Tianyu He, Xin Jin, Zhibo Chen 单位:University of Science and Technology of China, Zhongguancun Academy, CASIA, Eastern Institute of Technology, Zhejiang University, Beihang University 会议:2026 Arxiv 链接:https://arxiv.org/abs/2605.12957 研究动机在单张图像生成具有三维一致性的新视角序列(Image-to-3D World Generation)任务中,如何克服大幅度摄像机移动带来的几何畸变与外观漂移是生成式三维领域的硬骨头。现有的主流模型(例如基于 Video Diffusion 的工作)通常采取联合预测(Simultaneous Prediction)的策略,试图通过单一网络端到端地拟合高维时空分布,同时生成几何(通常是隐式的深度或 3D 表示)和 RGB...

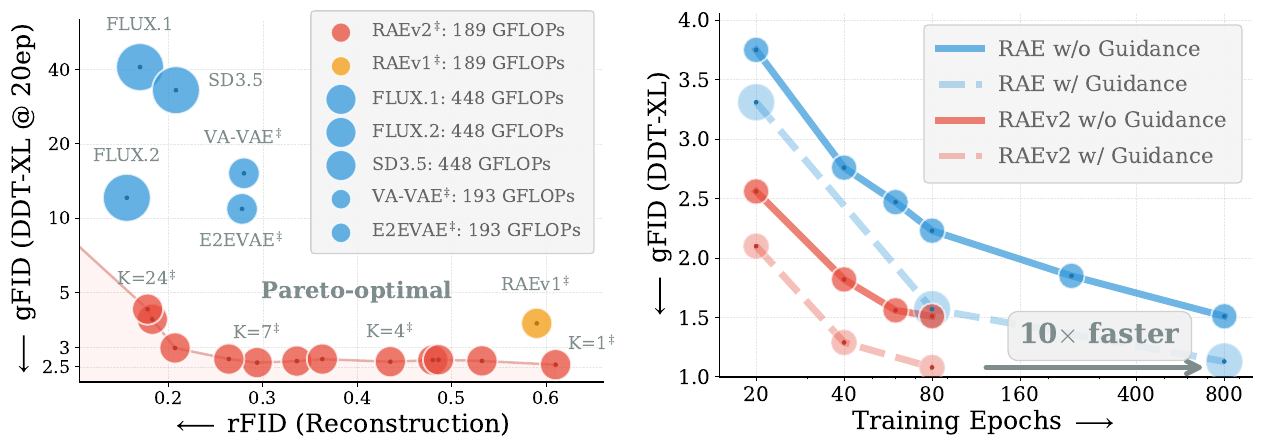

RAEv2: Improved Baselines with Representation Autoencoders

作者:Jaskirat Singh, Boyang Zheng, Zongze Wu, Richard Zhang, Eli Shechtman, Saining Xie 单位:Adobe Research, ANU, New York University 会议:2026 Arxiv 链接:arXiv | Project Page 研究动机近年来,潜在扩散模型(Latent Diffusion Models, LDM)已成为图像生成领域的主流。常规的 LDM 必须依赖于一个专门训练的变分自编码器(VAE)将高维像素空间映射至低维的潜在空间。然而,近期提出的“表征自编码器”(Representation Autoencoders, RAE)打破了这一常规,它直接利用现成的、自监督预训练视觉编码器(如 DINOv2、DINOv3 等)作为潜在空间,通过在其特征上训练扩散模型来省去独立的 VAE 训练。这对于统一计算机视觉的“理解(Understanding)”和“生成(Generation)”两大领域具有里程碑式的意义。 但是在实际落地时,初代的 RAE...

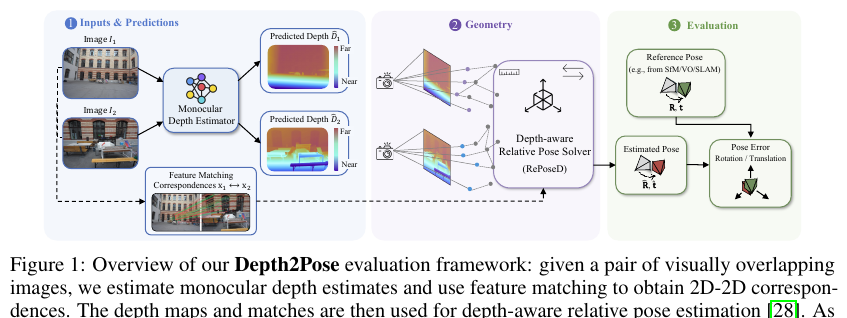

Depth2Pose: A Pose-Based Benchmark for Monocular Depth Estimation without Ground-Truth Depth

作者:Viktor Kocur, Sithu Aung, Gabrielle Flood, Yaqing Ding, Lukas Bujnak, Torsten Sattler, Zuzana Kukelova 单位:Comenius University in Bratislava, Czech Technical University in Prague 会议:2026 Arxiv 链接:https://arxiv.org/abs/2605.19797 研究动机 评估标准存在局限性: 尽管单目深度估计(MDE)近年来取得了显著进展,并且预测的深度图在 Structure-from-Motion (SfM)、视觉定位和 SLAM 等下游几何任务中扮演着关键输入角色,但现有的 MDE 方法主要仍以深度绝对精度进行评估。通用的评估指标(如 Abs.Rel 或 RMSE)是在整张图像上全局聚合误差的,这并不能直接反映深度在具体的下游三维几何任务中的实用价值。 几何重要性非均匀分布: 在下游几何任务(如 SfM 或...