MetricAnything: Scaling Metric Depth Pretraining with Noisy Heterogeneous Sources

作者:Baorui Ma,Jiahui Yang,Donglin Di,Xuancheng Zhang, Jianxun Cui, Hao Li, Xie Yan, Wei Chen

单位:Li Auto Inc

会议:2026 Arxiv

链接:https://metric-anything.github.io/metric-anything-io/

研究动机

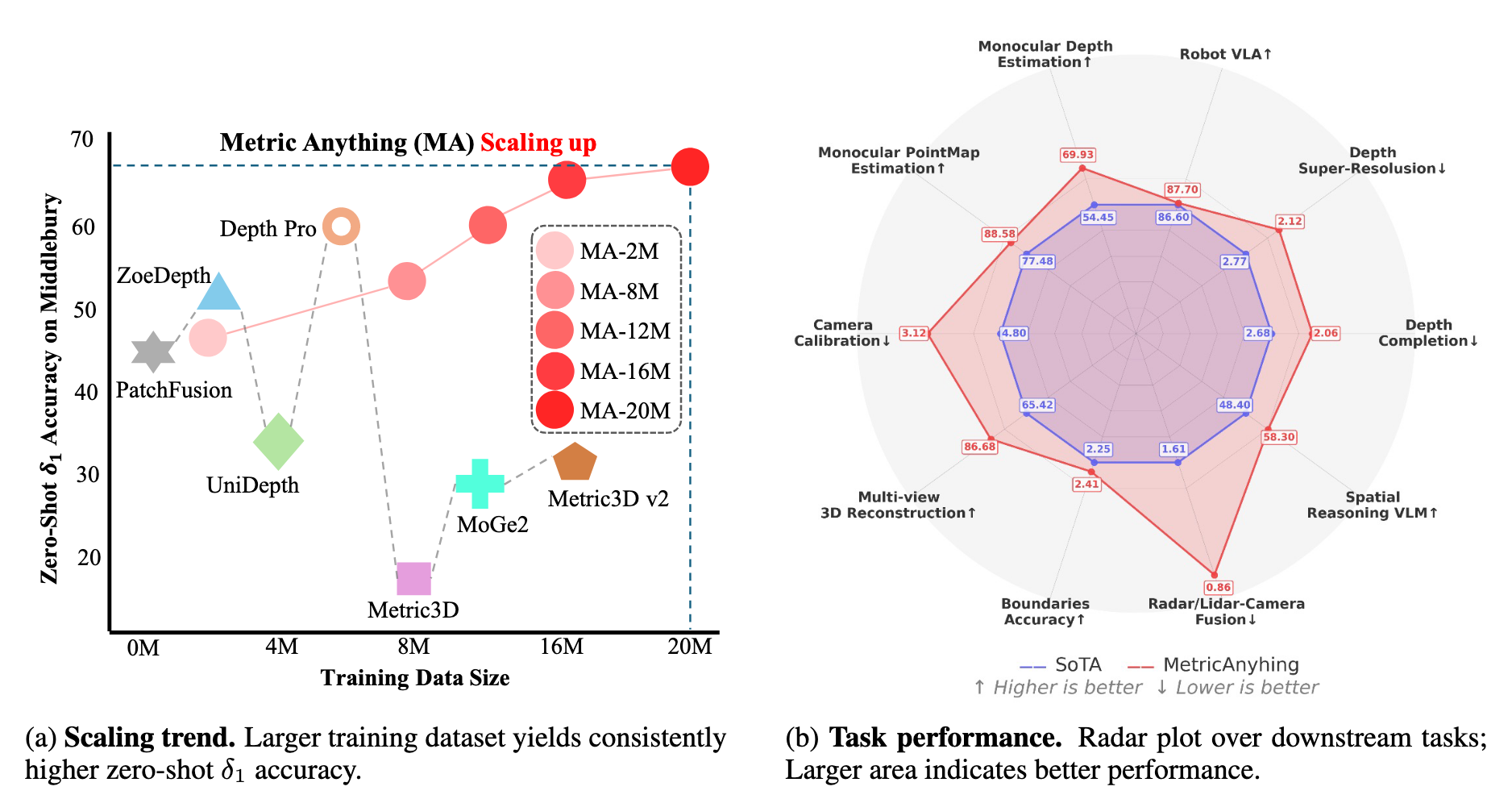

由于数据来源复杂,暂无工作将Scaling原则应用于绝对深度估计,实现一个通用的模型

核心方法

1.构造20M数据

2.Deep-to-Deep DPT

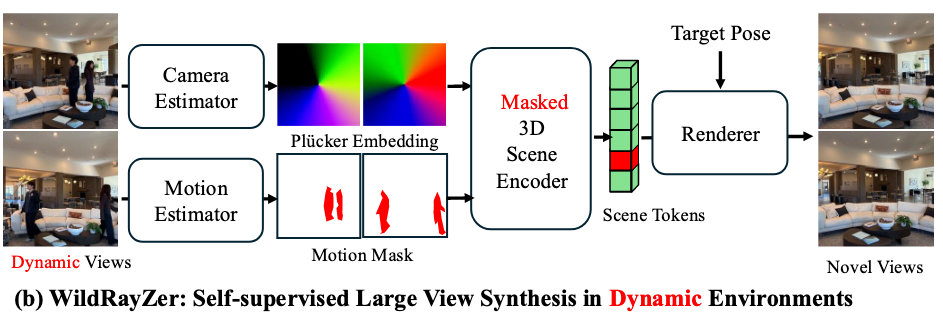

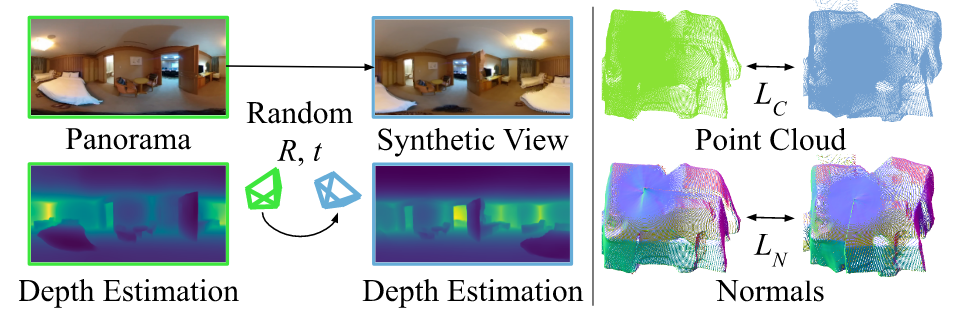

典型的带有DPT头解码器的ViT编码器使用U-Net风格的跳跃连接,将浅层特征注入更深层,并将深层特征向上传播。虽然这能在噪声监督下稳定训练,因为ViT编码器中的低层提示(如纹理和颜色)更一致且易于学习。低维特征通过跳接连接到靠近输出的DPT头,这减少了输出与噪声监督之间的冲突,从而平滑梯度波动。然而,它未能充分利用对精确深度至关重要的高层语义线索。因此,减少对浅层到深度特征注入的依赖,探索更激进的网络设计,充分发挥ViT编码器深度块所提供的丰富语义线索。

数据集

Train:

- 自建数据集

Eval:

- Booster

- Middlebury

- Sun-RGBD

- ETH3D

- NuScenes

- Sintel

- NYUv2

- KITTI

- ScanNet

- iBims-1

- Spring

算力

144张H200

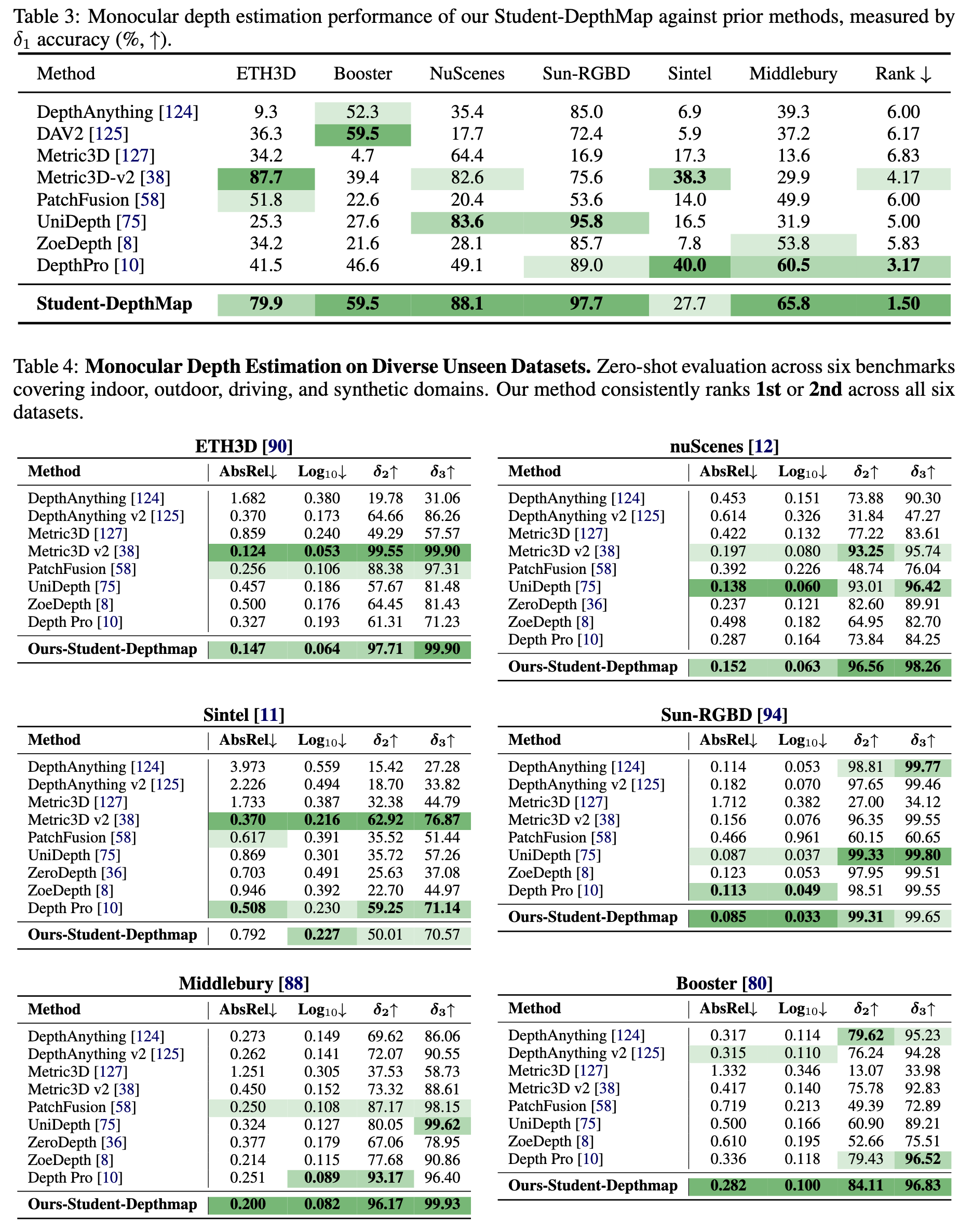

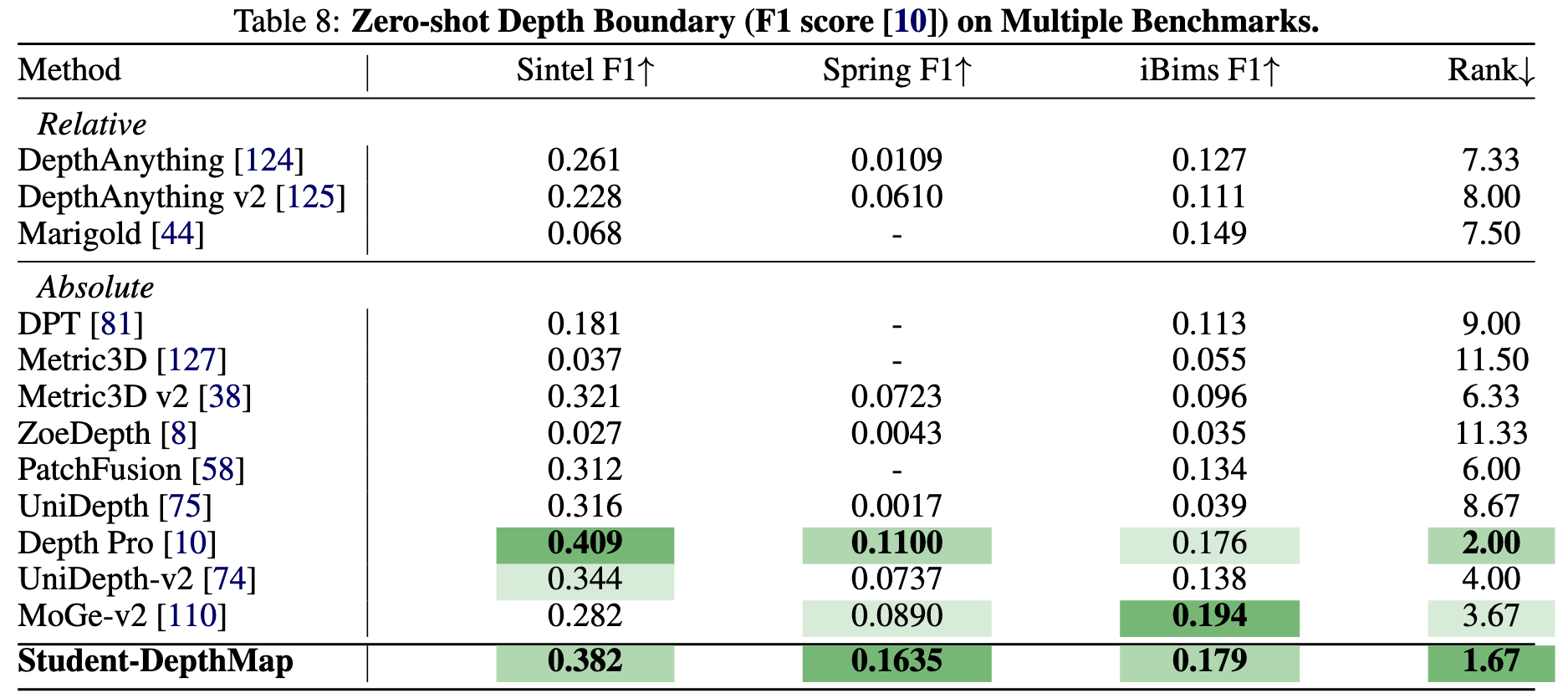

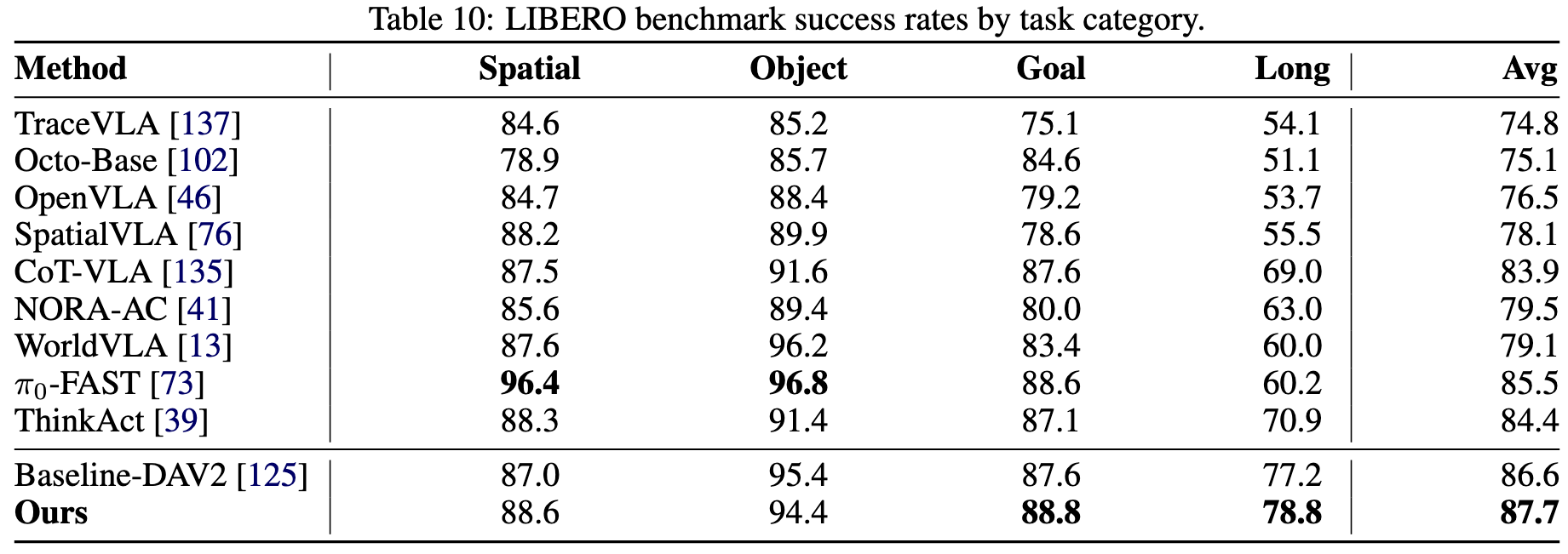

实验结果

优势与不足

优势

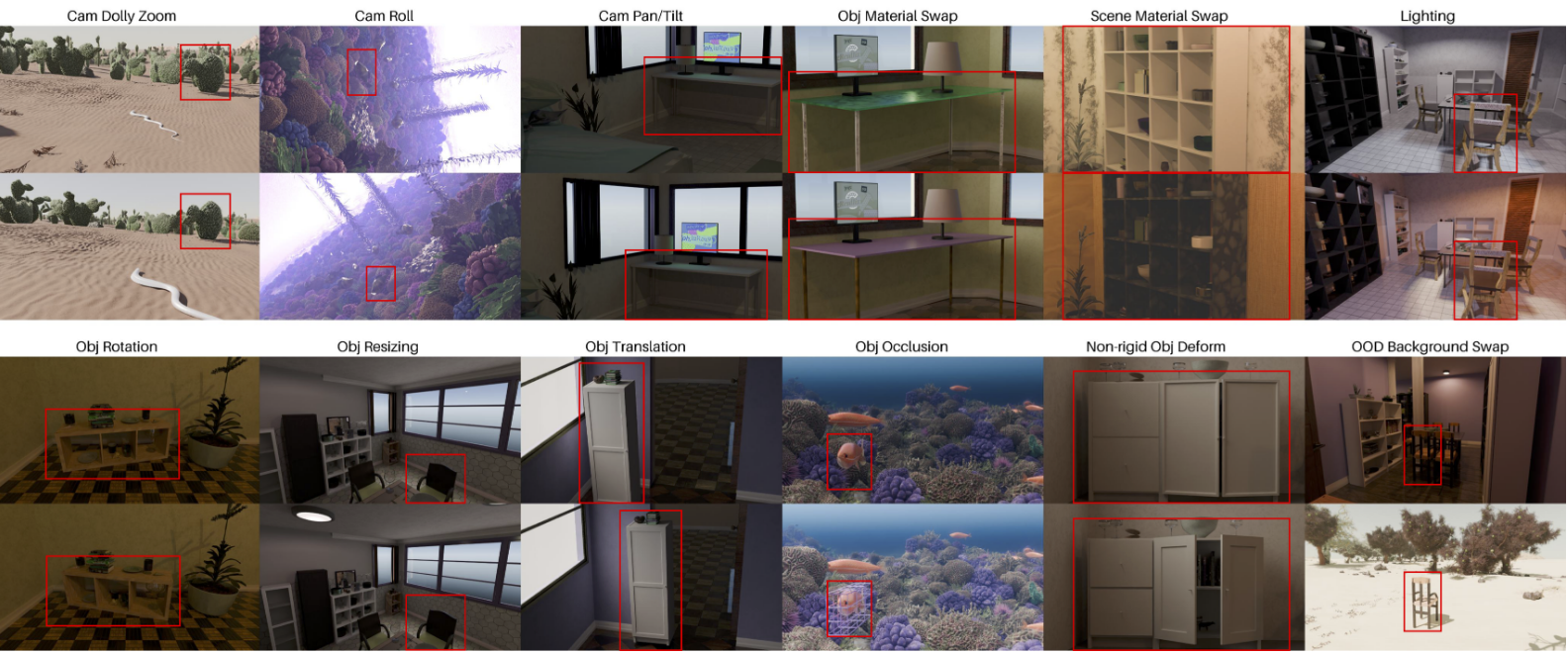

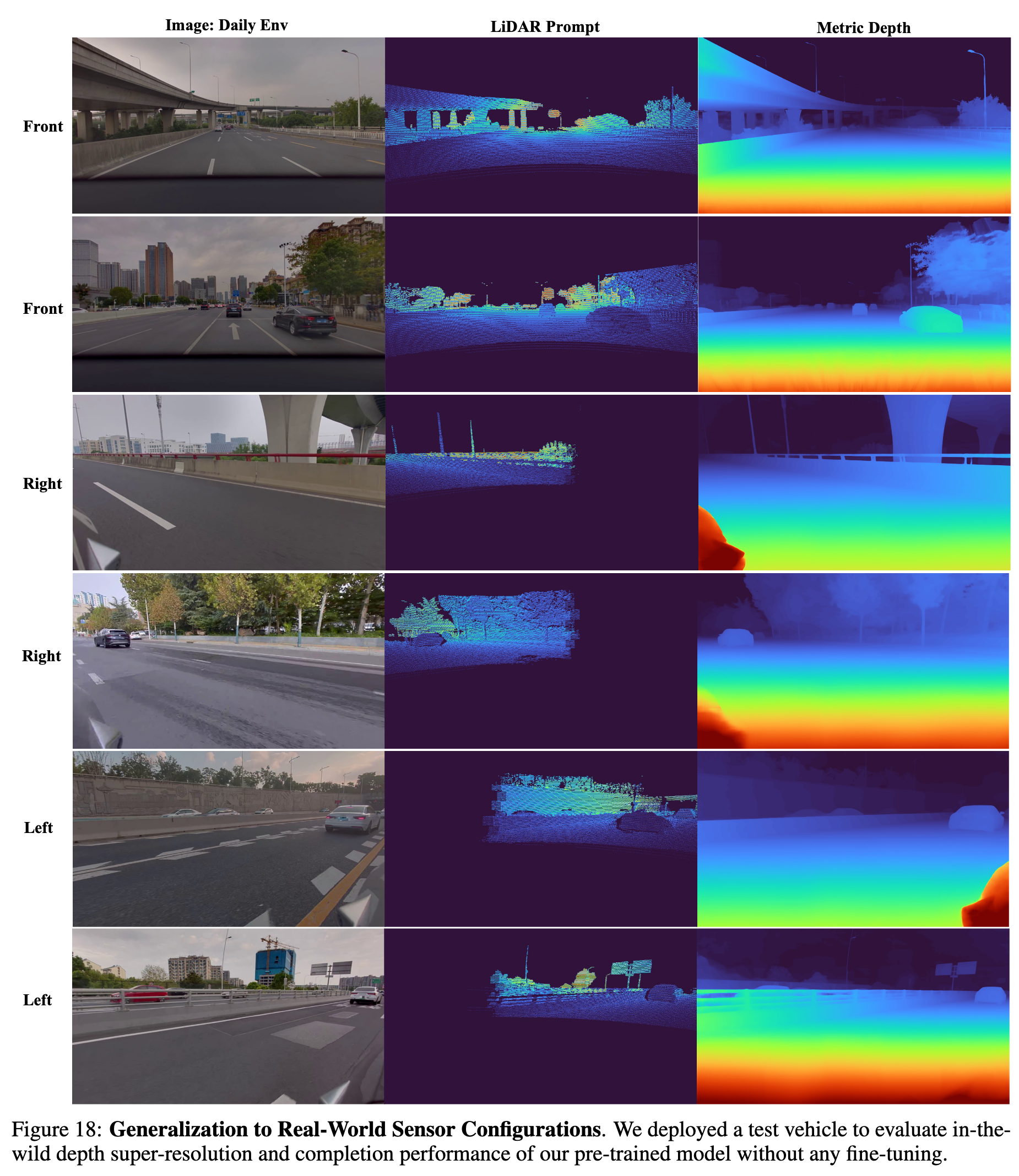

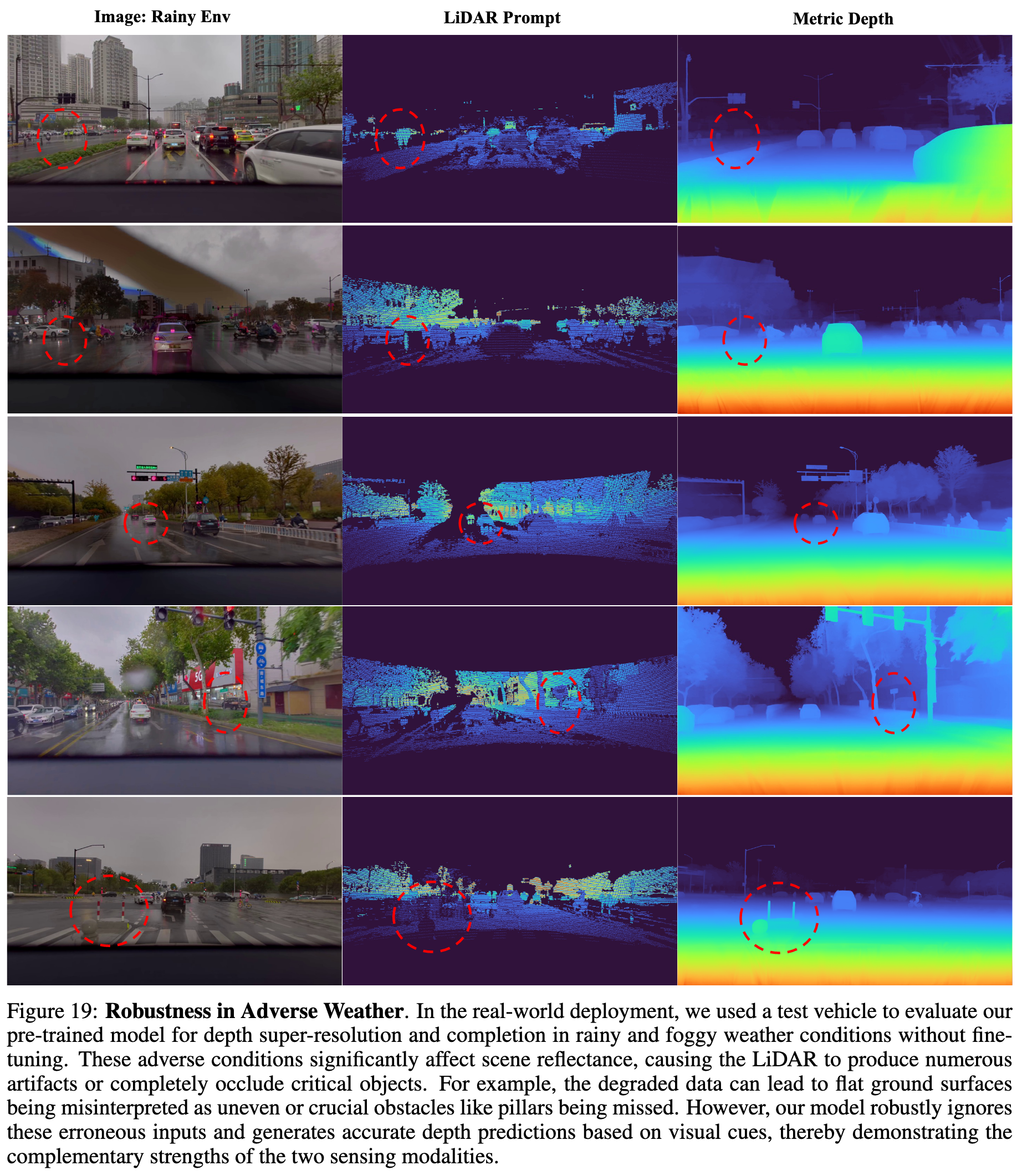

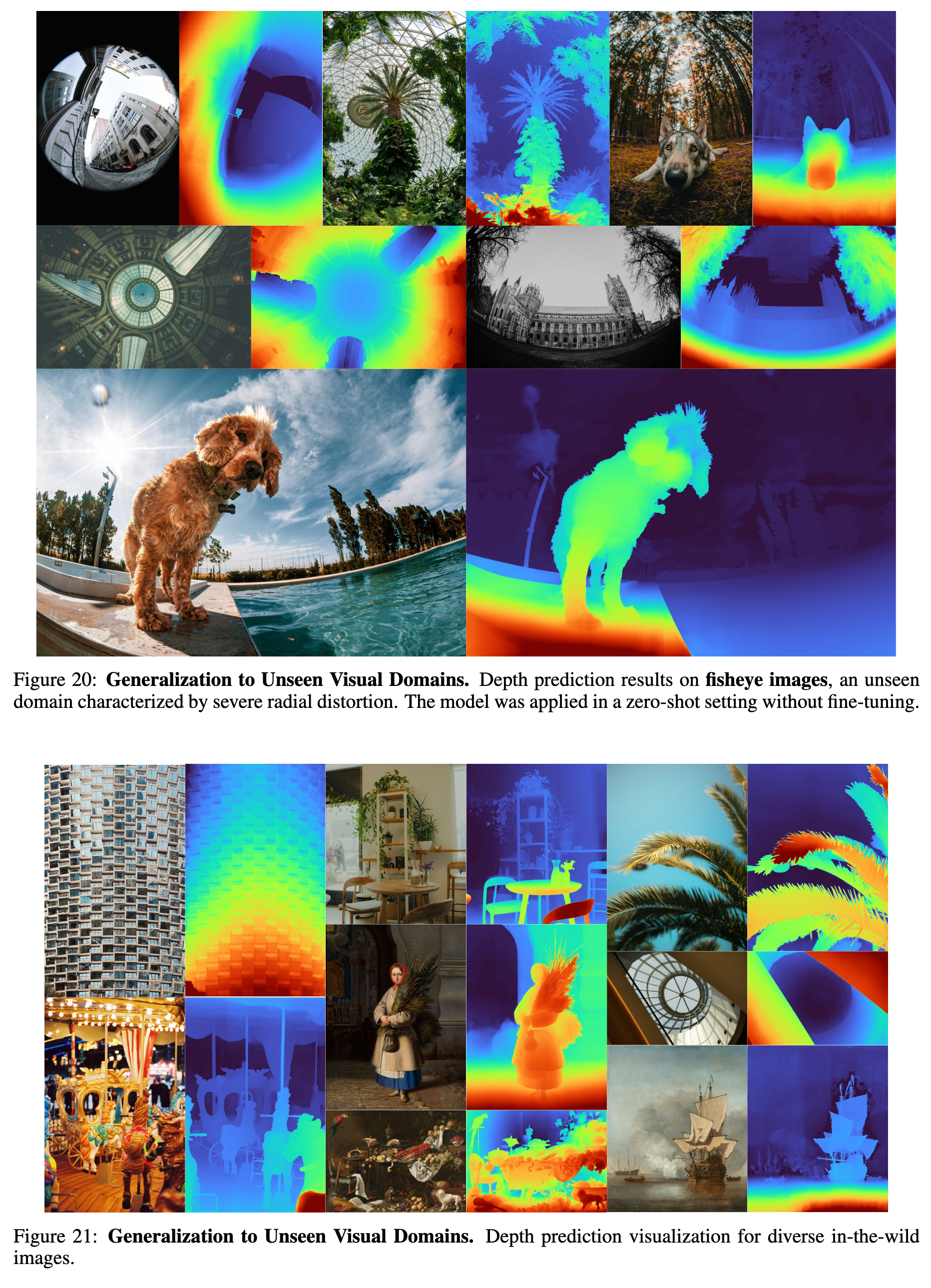

- 强大的泛化能力,多任务应用能力

- Scaling Law

- 极简的模型设计

不足

- 依旧局限于透视相机假设,对畸变相机的深度估计好看但不可用,且通过了mask的方式取巧把预测的不好的都滤除了

- 未对模型的Capacity进行实验

- 计算成本过高

记忆点

Deep-to-Deep的DPT设计

Scaling Law

Distance-aware inverse depth transform