FocusDepth: Focusable Monocular Depth Estimation

作者:Yuxin Du, Tao Lin, Zile Zhong, Runting Li, Xiyao Chen, Jiting Liu, Chenglin Liu, Ying-Cong Chen, Yuqian Fu, Bo Zhao

单位:School of Artificial Intelligence, Shanghai Jiao Tong University; The Hong Kong University of Science and Technology (Guangzhou); King Abdullah University of Science and Technology

会议:2026 Arxiv

链接:https://arxiv.org/abs/2605.11756

研究动机

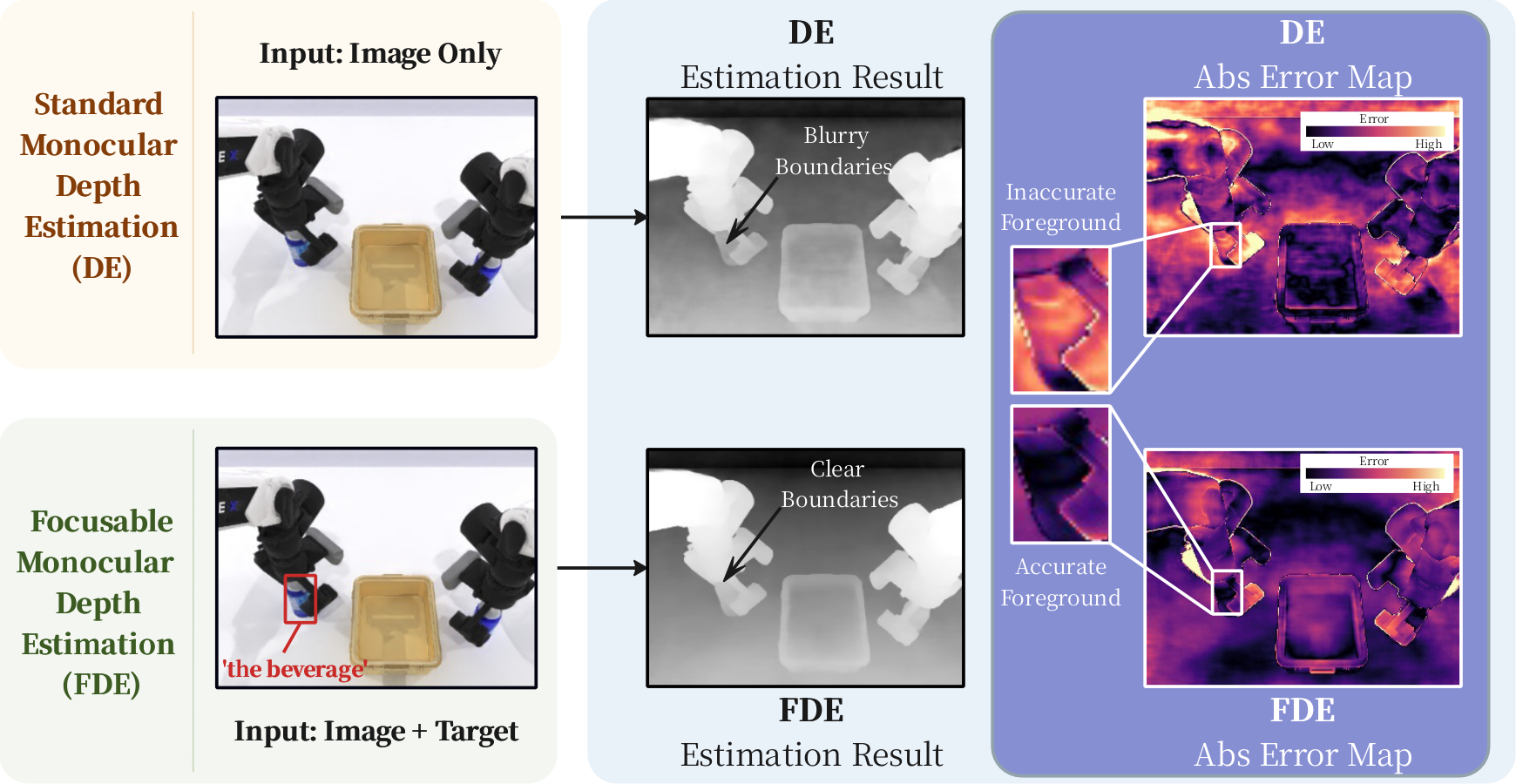

现有单目深度估计通常是 image-centric 的:输入一张图,输出一张整图深度,训练和评测也主要把所有有效像素的误差聚合起来。这个设定对全局场景理解很合理,但很多真实任务其实不是平均地关心每个像素。

机器人抓取时更关心目标物体和接触边界,AR 交互更关心用户指定区域,具身智能里也常常是“我要操作这个杯子/抽屉/把手”,而不是“整张图所有位置都同等重要”。如果深度模型只被全图损失训练,它可能在背景上表现不错,却在目标前景、物体边界、遮挡过渡处犯下对任务影响更大的错误。

这篇论文提出 Focusable Monocular Depth Estimation (FDE):给定图像和一个目标提示,模型不仅要预测深度,还要优先提升指定前景区域的深度精度,保持目标边界的清晰深度跃迁,同时不能破坏全局几何一致性。

核心问题可以写成一句话:

能不能让单目深度基础模型像 SAM 一样接受 box/text prompt,并把“用户关心哪里”真正反映到深度预测中?

核心方法

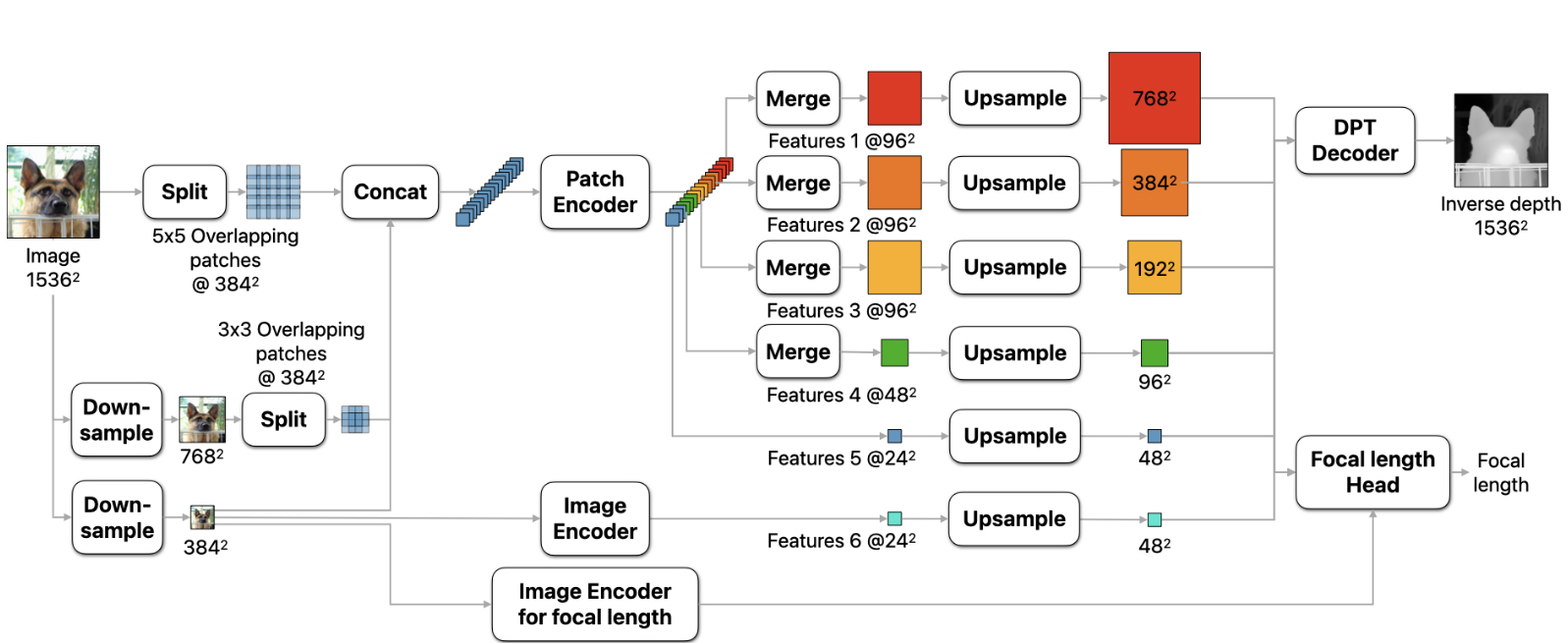

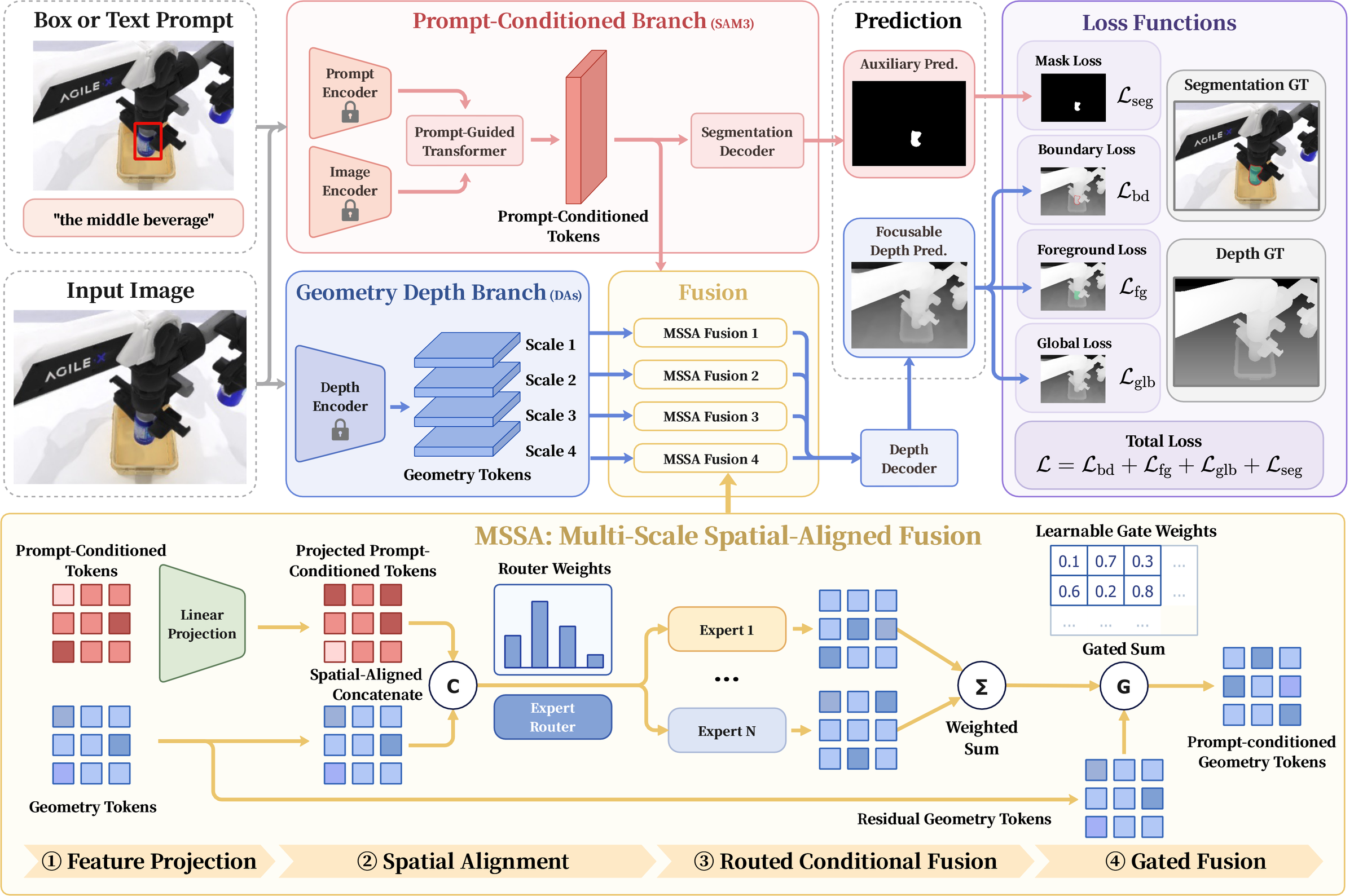

论文提出的模型叫 FocusDepth。它不是重新训练一个完全独立的深度模型,而是把 Depth Anything 系列作为 geometry depth branch,再接入 SAM3 作为 prompt-conditioned branch。这样做的动机很明确:Depth Anything 提供强全局几何先验,SAM3 提供 prompt-grounded 的目标选择能力,FocusDepth 负责把二者在空间上对齐并注入到深度特征中。

1. 任务形式

给定图像 $I$ 和交互式提示 $p$,FocusDepth 输出深度图和辅助前景 mask:

其中 $p$ 可以是 bounding box,也可以是文本提示。论文强调 FDE 的目标是空间非均匀的:前景区域要更准,边界区域要更锐,全局区域要保持几何连贯。

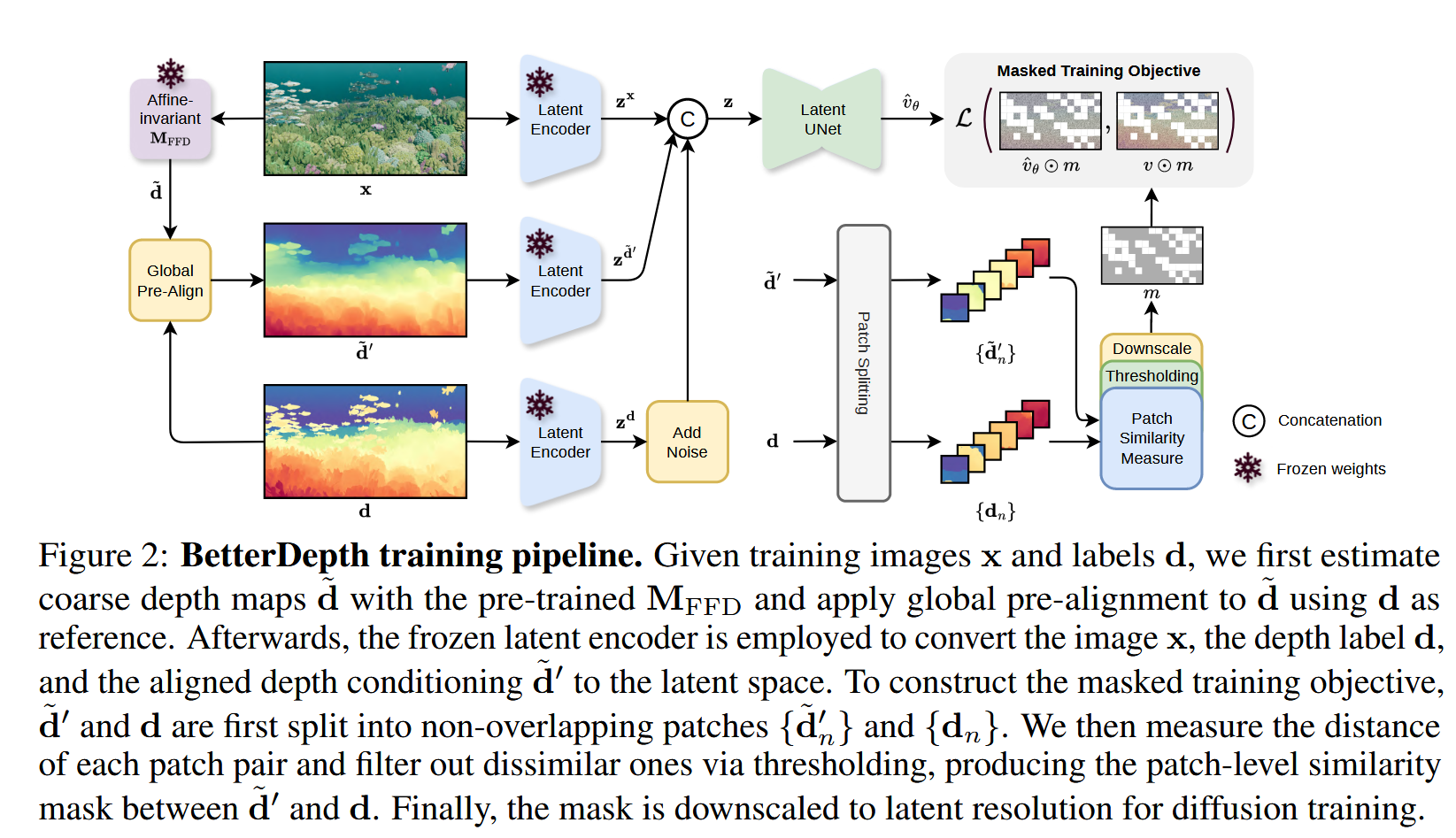

2. MSSA:Multi-Scale Spatial-Aligned Fusion

FocusDepth 的核心模块是 MSSA。Depth branch 提取多尺度几何 token:

Prompt branch 从图像和提示中提取 prompt-conditioned token:

关键点在于两条 branch 使用相同图像和相同 ViT patch grid,因此 token 数量相同,并且有一一对应的空间位置。MSSA 先把 prompt token 投影到当前尺度的 geometry token 维度:

然后在 token 维度做 spatial-aligned concatenation:

这一步是论文最重要的设计之一。Prompt 信息不是作为一个全局条件向量粗暴注入,而是在对应空间位置上注入,保证“杯子”的提示主要影响杯子所在的 token,而不是整图漂移。

3. Routed conditional fusion 与 gated injection

不同位置需要不同的提示修正:前景内部、目标边界、背景区域的调整幅度不应该一样。MSSA 因此用轻量 MoE 做 routed conditional fusion:

论文设置每个尺度 $E=4$ 个 experts。这里的 expert 不是显式对应前景/边界/背景,而是提供输入相关的融合能力。

为了避免 prompt branch 覆盖掉原本的几何先验,MSSA 又加入 gated output:

这个门控很关键。FocusDepth 不是“提示来了就把深度全改掉”,而是让模型学习哪些位置需要提示修正,哪些位置应该保留 Depth Anything 的全局几何表示。

4. 区域感知损失

FDE-Bench 将评测区域分成 foreground、boundary、global 三类。训练时,预测深度先通过 per-image scale-shift 与 GT 对齐:

然后分别计算三个区域的深度损失:

其中 depth loss 由 masked MSE 和 gradient loss 组成。辅助 mask 使用 BCE + Dice:

最终目标是:

这比普通全图 loss 更贴近 FDE 的定义:不是只追求整图平均误差更小,而是显式要求目标局部和边界更可靠。

5. 两阶段训练

论文采用 two-stage training 来稳定适配:

Stage 1:冻结所有预训练模块,只训练 MSSA,让它先学会对齐 prompt token 与 geometry token。

Stage 2:冻结 depth encoder、SAM3 image encoder 和 SAM3 prompt encoder,训练 MSSA、depth decoder、SAM3 prompt-guided transformer 和辅助 segmentation decoder。

这样把“跨模型特征对齐”和“下游 FDE 适配”拆开,避免一开始就把几何 backbone 和 prompt branch 一起搅动。

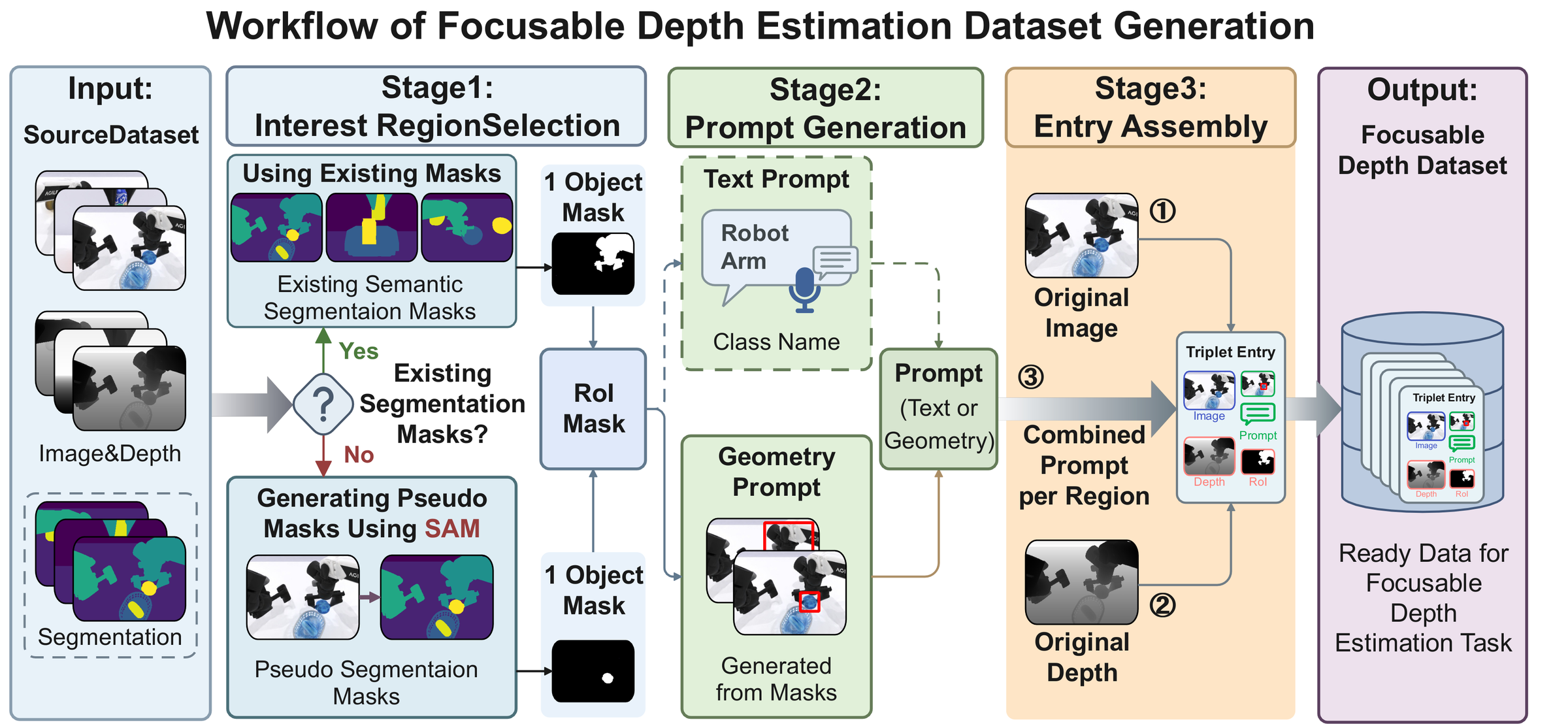

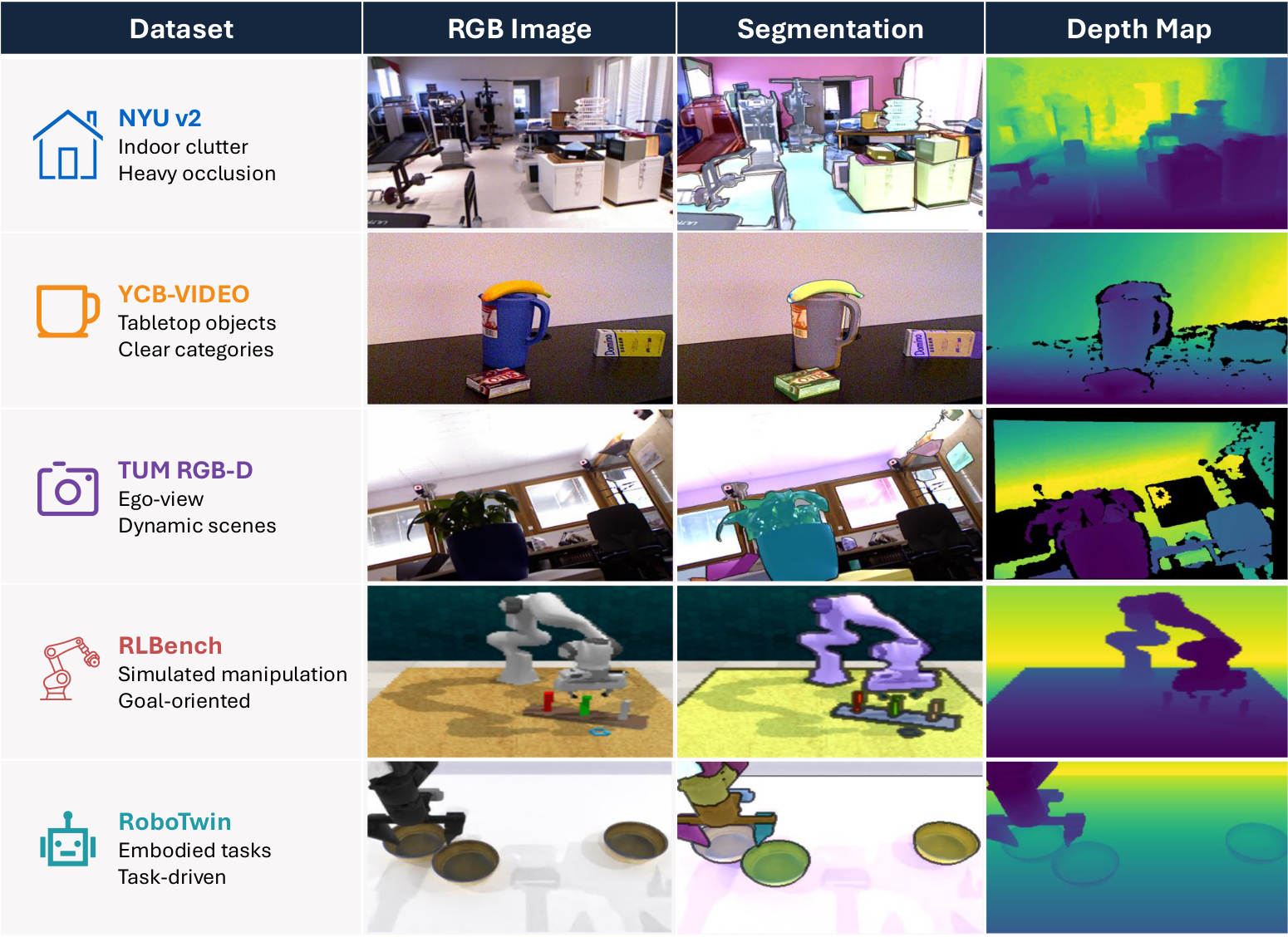

数据集

论文提出 FDE-Bench,把多个 RGB-D 数据集转换成统一的 image-target-depth triplet。每个 triplet 包括一张 RGB 图像、一个目标区域、对应深度图;同一张图可以产生多个 triplets,但每个 triplet 只对应一个目标。

FDE-Bench 的来源包括:

- NYU v2:室内场景,box/text prompt,895 类

- YCB-Video:桌面物体,box/text prompt,22 类

- TUM RGB-D:RGB-D SLAM 场景,box prompt

- RLBench:具身操作环境,box/text prompt,55 类

- RoboTwin:双臂机器人仿真,box prompt

总规模为:

- 图像:20.5K train / 8.2K val

- triplets:252.9K train / 72.5K val

- 类别:972 个带语义标签的目标类别

构建流程是:如果原数据有 instance/semantic mask,就按面积过滤目标区域;如果没有,则用 SAM automatic mask generation 产生 pseudo masks,并在 metadata 中标注。每个 mask 定义 foreground region,tight bounding box 定义 box prompt,语义类名在可用时定义 text prompt。

评测区域包括 foreground、boundary、global。指标为 $\delta_1$ 和 AbsRel,并以 per-target 方式计算后取 median,避免一张图里目标数量多就支配整体结果。

算力

实验默认使用 4 张 NVIDIA A100 80GB GPU。

FocusDepth 训练超参数:

- 输入分辨率:$1008\times1008$

- per-device batch size:4

- Stage 1:训练 1 epoch,learning rate $1\times10^{-4}$

- Stage 2:训练 4 epochs,learning rate $1\times10^{-5}$

- optimizer:AdamW

- scheduler:cosine decay with linear warmup

- weight decay:$1\times10^{-5}$

- dropout:0.1

- gradient clipping:1.0

DA2-ft / DA3-ft baseline 使用同样的 5 epoch 总训练预算,但采用单阶段 fine-tuning,learning rate 为 $1\times10^{-5}$。

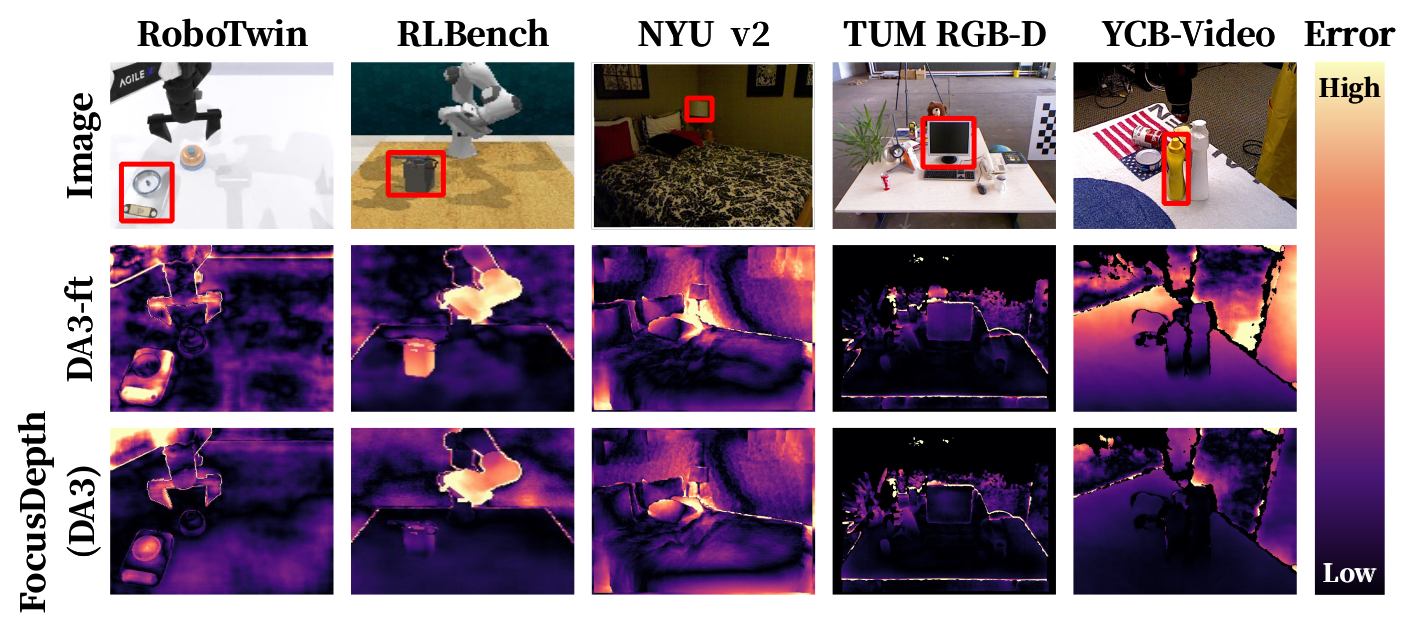

实验结果

论文比较了 UniDepth-v1、UniDepth-v2、Metric3D-v2、Depth Anything 2、Depth Anything 3 的 zero-shot 表现,也比较了 DA2/DA3 fine-tuning 与 FocusDepth(DA2/DA3)。整体结论是:已有深度基础模型的整图几何能力很强,但不必然具备 target-centric 行为;FocusDepth 的主要收益集中在提示目标的 foreground 和 boundary,同时多数情况下不破坏 global region。

Box prompt

在 RLBench 上,FocusDepth(DA3) 相比 DA3-ft:

- boundary AbsRel 从 0.073 降到 0.049

- foreground AbsRel 从 0.095 降到 0.056

- global AbsRel 从 0.042 降到 0.030

在 RoboTwin 上同样明显:

- boundary / foreground / global AbsRel 从 0.082 / 0.075 / 0.037 降到 0.058 / 0.055 / 0.029

在 NYU v2 上,很多模型的 $\delta_1$ 已接近饱和,因此差异主要体现在 AbsRel 和 quartile。FocusDepth(DA3) 主要改善 boundary 和 foreground,global AbsRel 与 DA3-ft 同为 0.053,说明 target refinement 没有牺牲全局几何。

Text prompt

Text prompt 在 RLBench、NYU v2、YCB-Video 上也带来一致提升。YCB-Video 中 FocusDepth(DA3) 相比 DA3-ft:

- boundary AbsRel 从 0.042 降到 0.034

- foreground AbsRel 从 0.035 降到 0.024

- global AbsRel 从 0.044 降到 0.032

这说明 prompt-conditioned cue 不只是 box 的空间裁剪,也能从文本语义中提供可用的目标选择信息。

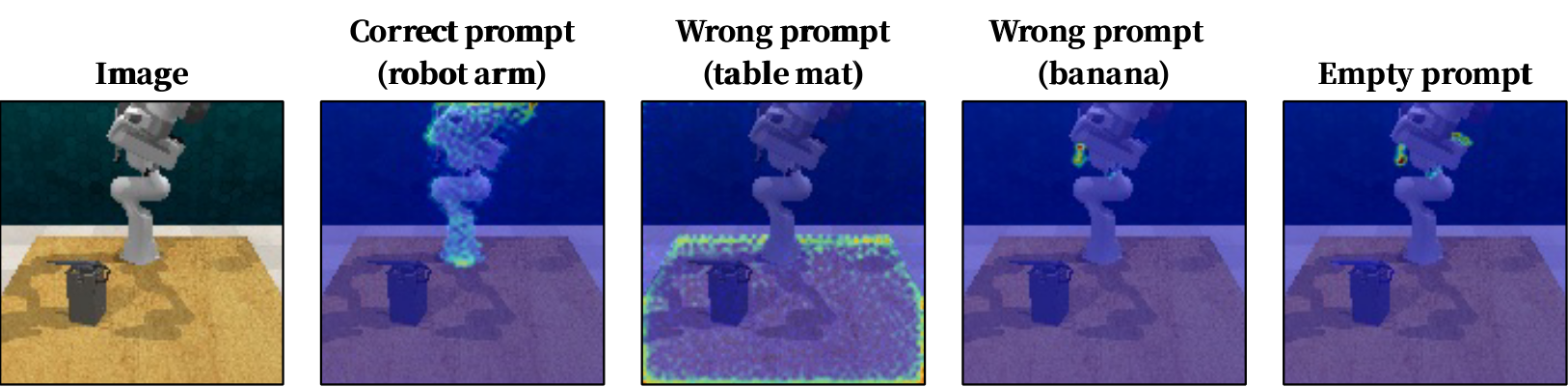

Prompt correctness

Prompt correctness study 比较了正确文本提示、错误但可见目标提示、缺失目标提示和空提示。正确提示最好;错误或空提示主要削弱局部前景/边界收益,对全局几何影响更小。一个有意思的现象是,即使提示错误或为空,FocusDepth 仍强于 DA3-ft,说明 prompt branch 经过训练后还提供了一些通用的局部/全局深度线索。

Ablation

论文的消融清楚地证明 MSSA 的空间对齐是最大贡献。将 prompt-conditioned tokens 与 geometry tokens 的对应关系打乱后,text prompt 的 global AbsRel 上升最多,达到 +13.8%。去掉 scale-specific fusion 或把 routed fusion 替换成 single MLP,也会稳定损害 foreground/boundary。

区域损失也很重要。只使用 global loss 会让 global AbsRel 好看一些,但 foreground AbsRel 明显变差,例如 box prompt 下 foreground AbsRel 上升 10.7%,text prompt 下上升 12.0%。这正好支持了论文的任务动机:如果只用整图监督,模型会自然牺牲用户真正关心的目标区域。

定性结果中,DA3-ft 可以保持背景误差较低,但对复杂目标和边界仍有明显错误;FocusDepth(DA3) 在目标区域 error map 上更干净,边界过渡也更清晰。

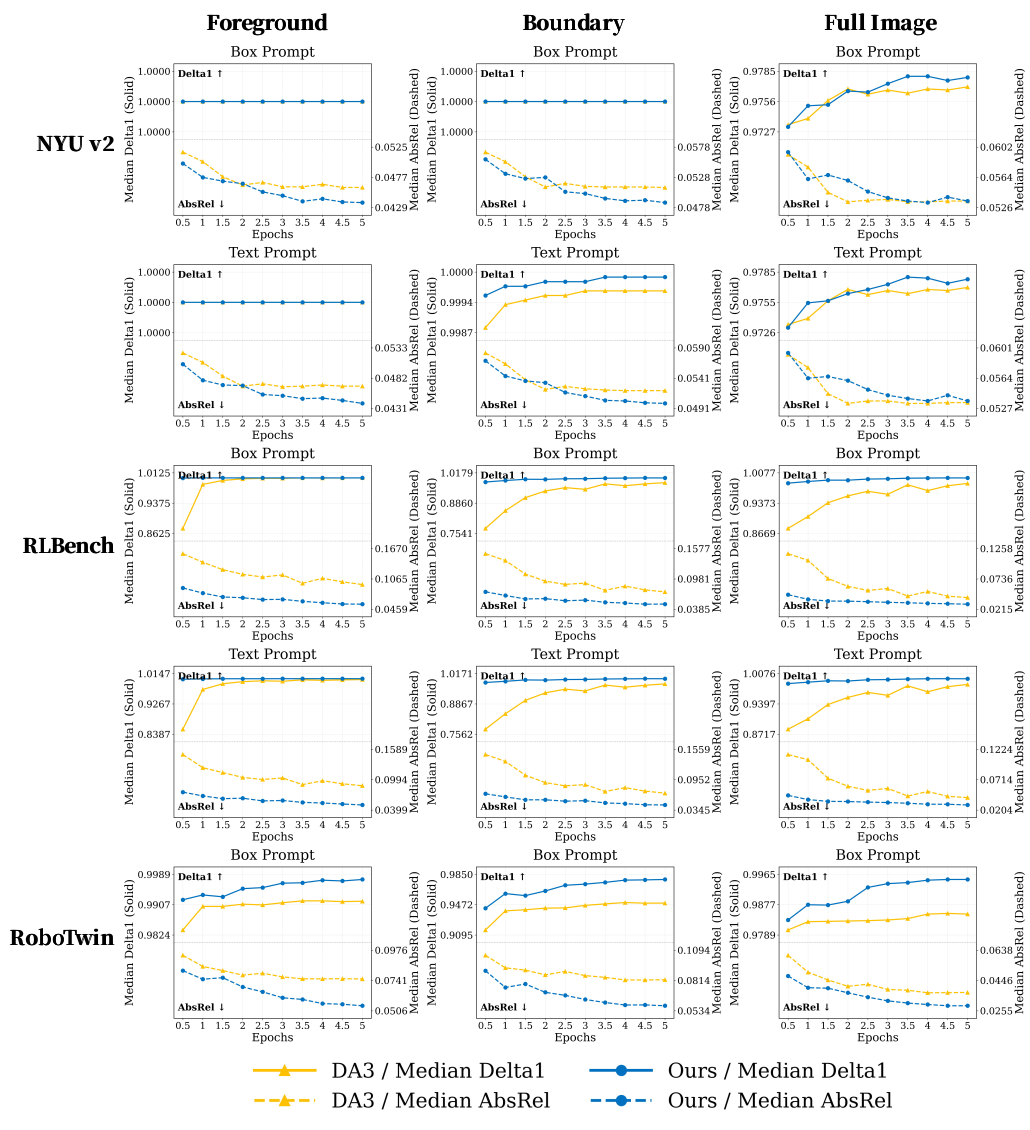

训练曲线也显示 FocusDepth 在 foreground、boundary、global 三类区域上相对 DA3-ft 更稳定地提升,说明它不是只在最终表格上偶然胜出,而是在训练过程中确实学到了 target-aware depth refinement。

优势与不足

优势

任务定义很有价值。FDE 把单目深度估计从“整图平均好”推进到“用户指定目标更好”,更接近机器人和交互式视觉系统的需求。

设计克制。FocusDepth 没有抛弃 Depth Anything 的全局几何先验,而是通过 MSSA 做受控注入,避免 prompt 信息破坏整图结构。

Benchmark 完整。FDE-Bench 同时覆盖真实 RGB-D、桌面物体、SLAM 场景、具身操作仿真,并把 foreground/boundary/global 分开评测。

消融有说服力。空间对齐、scale-specific fusion、routed fusion、gate、区域损失、两阶段训练都有对应验证。

对 box 和 text prompt 都有效,说明这个任务不局限于固定框选,也可以向语言条件几何感知扩展。

不足

方法依赖 SAM3 和 Depth Anything 系列,训练和推理成本高于普通单目深度模型;论文默认 4 张 A100 80GB 训练。

FDE-Bench 中部分 mask 来自自动生成,pseudo mask 的质量会影响训练和评测。尤其是透明、细长、强遮挡物体,mask 错误可能直接污染 foreground/boundary 指标。

论文主要证明了 benchmark 上的 depth metric 提升,真实下游任务收益仍需要进一步验证,例如抓取成功率、AR occlusion 质量或导航安全性。

Prompt 错误时虽然仍强于 DA3-ft,但局部收益会下降。真实交互系统中,用户提示、检测框、文本 grounding 错误都可能成为主要失败源。

当前方法仍是 relative depth setting,需要 scale-shift alignment 做评测;如果任务需要绝对米制深度,还需要额外尺度来源或 metric branch。

记忆点

FDE 的关键不是“深度模型加一个 prompt”,而是把前景、边界、全局三类区域的目标明确拆开。

MSSA 的 spatial alignment 是核心,打乱 prompt token 与 geometry token 的位置对应会显著退化。

只看 global loss 会掩盖目标区域错误;这篇的 benchmark 价值比单个模型技巧更大。

SAM3 负责“找目标”,Depth Anything 负责“懂几何”,FocusDepth 做的是两者之间的受控信息注入。

对交互式机器人/AR 来说,目标级深度质量可能比整图平均深度质量更重要。