Real2Sim: A Physics-driven and Editable Gaussian Splatting Framework for Autonomous Driving Scenes

作者:Kaicong Huang, Talha Azfar, Weisong Shi, Ruimin Ke

单位:Rensselaer Polytechnic Institute; University of Delaware

会议:2026 Arxiv

链接:https://arxiv.org/abs/2605.13591

研究动机

自动驾驶系统最缺的不是普通路况,而是可控、可复现、带标签、并且覆盖长尾风险的训练数据。真实道路采集昂贵,碰撞、失控、遮挡、异常交互等 corner cases 又很难大量采到;传统仿真平台虽然可编辑,但视觉域和真实世界存在明显 sim-to-real gap;纯生成模型可以生成高保真图像或视频,却常常缺少跨视角、跨时间的一致性,更难保证车辆碰撞、落地、反弹这类行为满足物理约束。

Real2Sim 想解决的正是这个夹缝问题:能否从真实自动驾驶序列出发,把场景重建成既高保真、又可编辑、还能接入物理模拟的 3D/4D 表示?如果可以,那么研究者就能在真实场景基础上移动、旋转、复制车辆,甚至制造碰撞、坠落等风险情境,同时仍然保留真实道路、建筑、光照和车辆外观带来的视觉可信度。

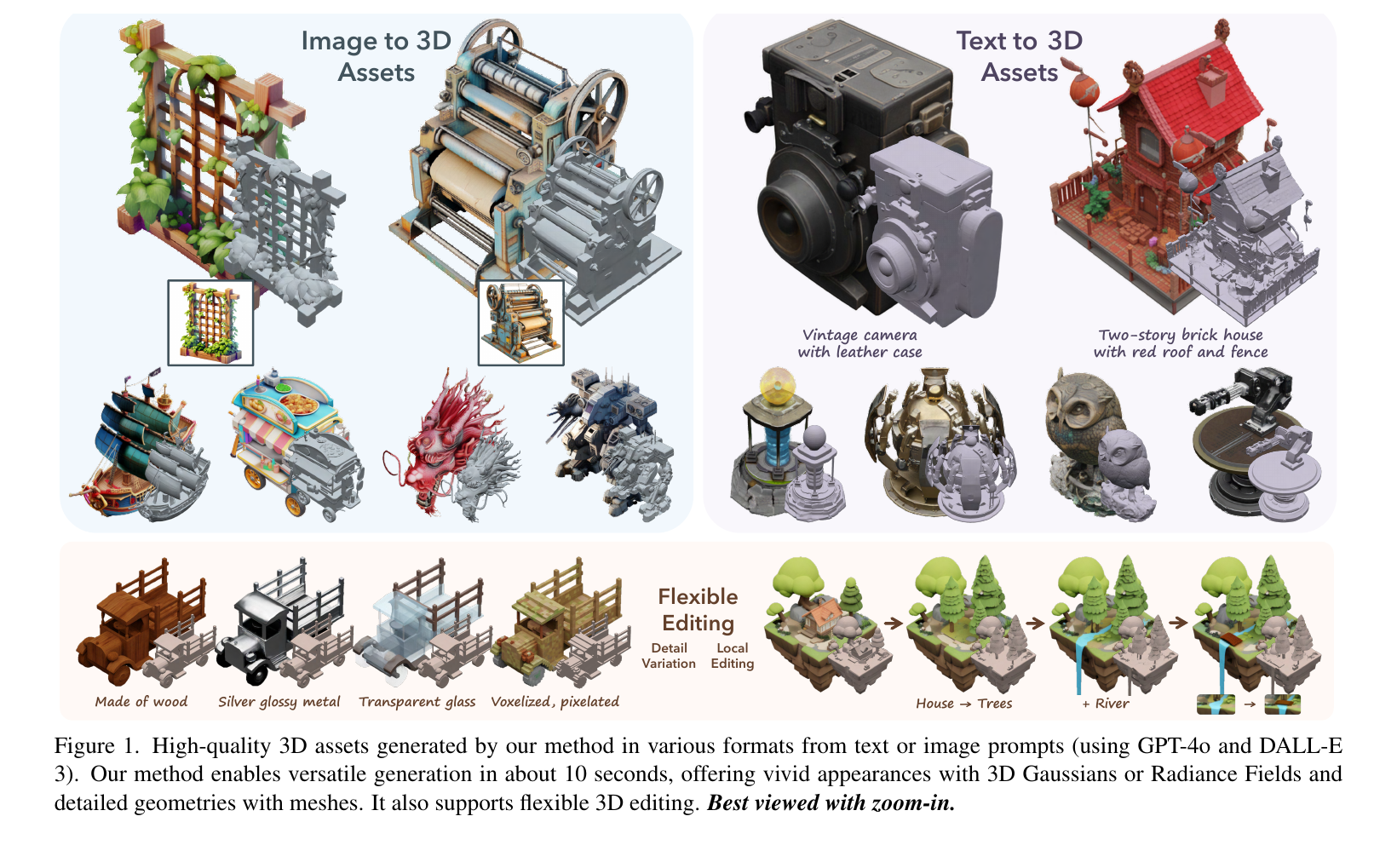

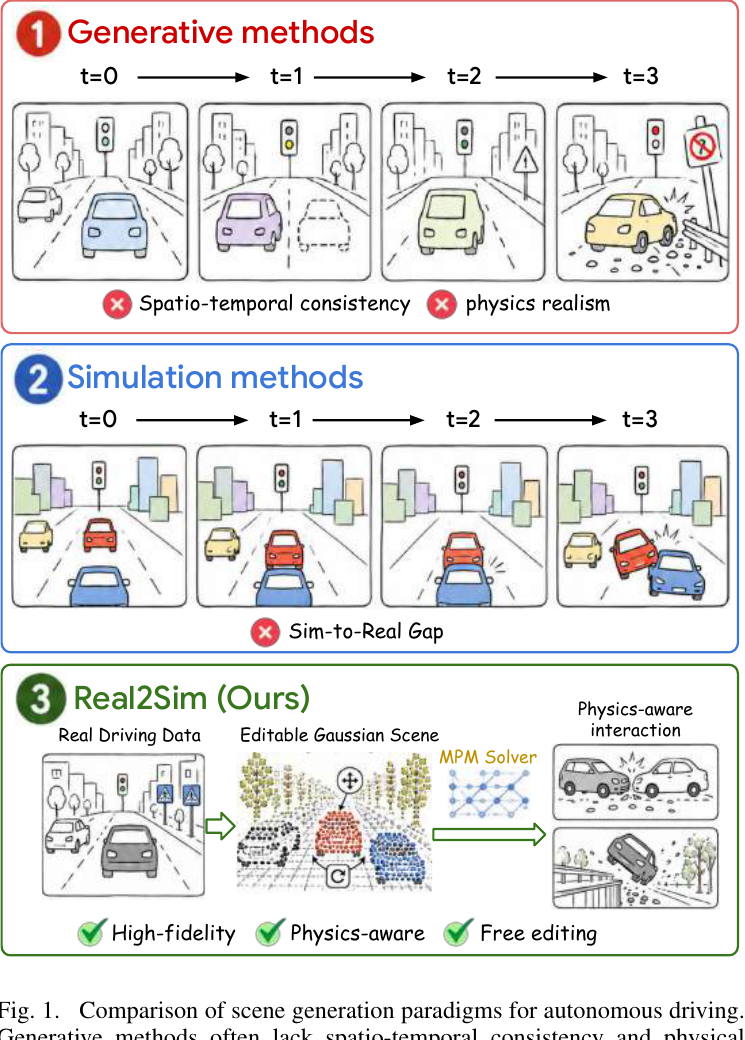

图 1 很清楚地给出了论文的定位。生成式方法的问题是时空一致性和物理真实性不足;传统仿真方法的问题是与真实世界存在视觉差距;Real2Sim 的切入点是把 Gaussian Splatting 的真实场景重建能力和可微 MPM 物理求解器结合起来,使合成场景同时具备高保真、physics-aware 和 free editing 三个属性。

这篇论文的核心目标不是再提出一个单纯的新视角合成方法,而是把 4D Gaussian Splatting 推向自动驾驶仿真:先把真实驾驶序列变成可分解的 Gaussian 场景,再把每个动态物体当作可编辑、可赋予材料属性、可参与物理求解的对象。

核心方法

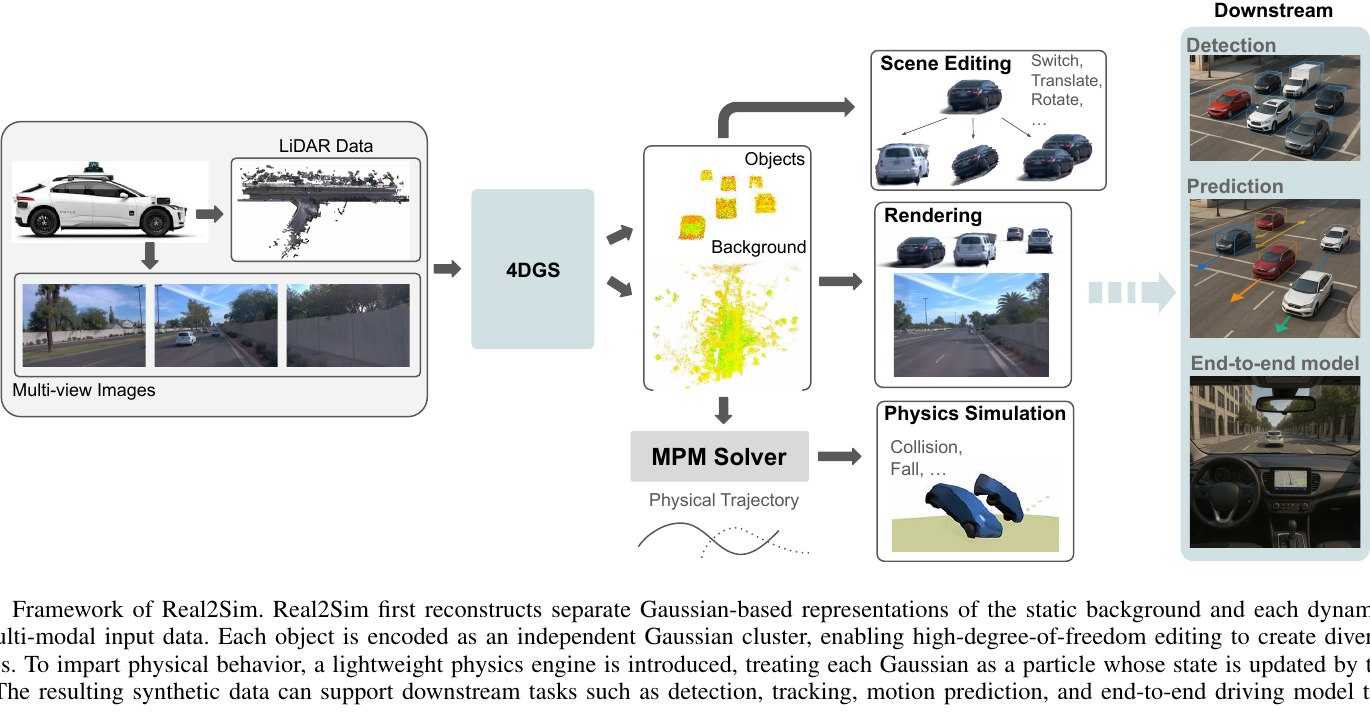

Real2Sim 的整体框架可以拆成三层:真实场景重建、实例级编辑、物理仿真。

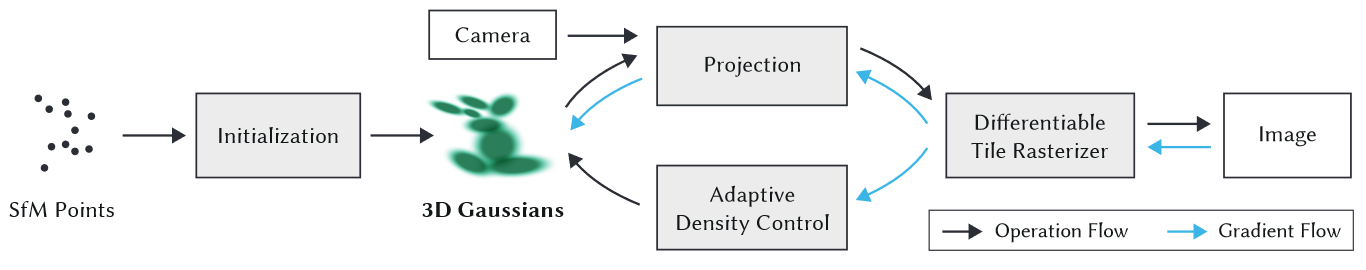

第一层是基于 Gaussian 的场景表示。论文采用 StreetGaussian 的思路,把自动驾驶序列建模为两个互相配合的部分:静态背景对应一组 Gaussian 点云,动态物体则分别对应独立的 Gaussian cluster。这样的好处是道路、建筑、树木等背景可以稳定渲染,而车辆等动态对象可以被单独取出、移动、旋转或复制。对于自动驾驶仿真来说,这种对象级分解比单一整体场景表示更关键,因为真正需要制造长尾样本的往往是物体间相对位置和运动关系。

第二层是时间连续建模。动态车辆并不是每一帧重新存一套完全独立的参数,而是通过物体位姿和时间相关的外观/谐波权重来表达。每个动态对象先在局部坐标系中定义,再通过随时间变化的旋转和平移映射到世界坐标中。这样既保留了 4D 场景的时间一致性,也给后续编辑留下了明确接口:改对象位姿,就能生成新的交通场景。

第三层是物理求解。Real2Sim 把每个 Gaussian primitive 视为一个粒子,并为其赋予密度、杨氏模量、泊松比、材料类型等物理属性,然后送入 Material Point Method(MPM)求解器。MPM 的典型流程是 particle-to-grid、更新网格速度、grid-to-particle,再更新粒子状态。对 Gaussian 来说,物理形变不仅影响粒子位置,也会通过仿射变换影响 Gaussian 的均值和协方差,因此渲染出来的车辆能够表现出碰撞挤压、下落接触和反弹等效果。

这个设计的关键是“解耦但相连”。Gaussian 重建负责外观和场景几何,MPM 负责物理状态更新。二者不是端到端联合训练,而是在已有 Gaussian 场景上接入一个轻量物理引擎。这样实现更直接,也让用户可以手动设置物理参数;但它也埋下了一个限制:物理模拟后的 Gaussian 分布未必仍然处在原始重建模型最擅长渲染的分布内。

数据集

论文使用 Waymo Open Dataset 做实验。Waymo Perception Dataset 包含 2,030 段驾驶序列,每段 20 秒,以 10Hz 采样,总量超过 400,000 帧;传感器包括 5 个 1920×1280 高分辨率相机和车载 64 线 LiDAR。这个数据集适合 Real2Sim 的原因是它既有多相机输入,又有 LiDAR,可以支撑驾驶场景的高保真重建和路面几何估计。

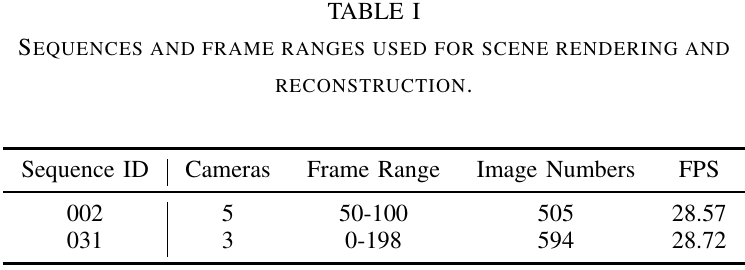

具体实验中,论文选了两段序列做渲染、重建和后续仿真:

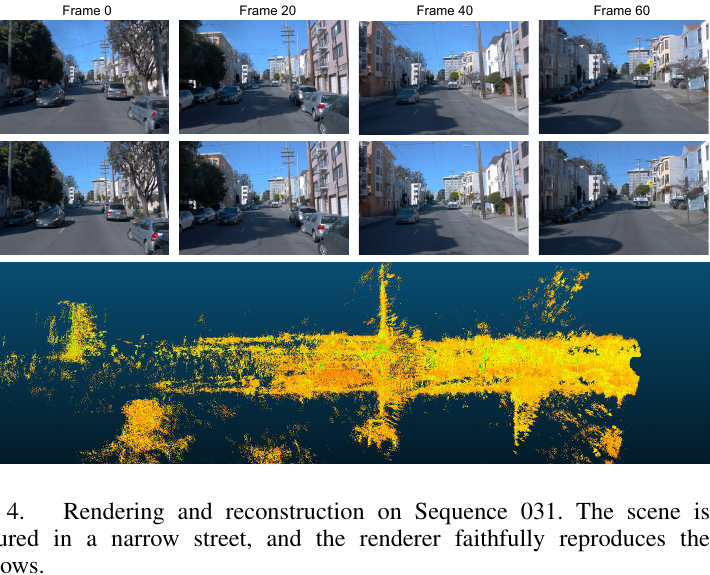

- Sequence 002:使用 5 个相机,帧范围 50-100,共 505 张图像,渲染 FPS 为 28.57。

- Sequence 031:使用 3 个相机,帧范围 0-198,共 594 张图像,渲染 FPS 为 28.72。

从表 I 看,Real2Sim 没有在整套 Waymo 上做大规模训练评测,而是选择典型序列展示系统能力。因此这篇论文更接近一个可编辑物理仿真框架的 proof-of-concept,而不是一个以大规模 benchmark 数字取胜的感知模型论文。

算力

论文说明所有训练和推理都在单张 NVIDIA RTX 4090 上完成,显存 24GB。StreetGaussian 模型每个场景训练 50,000 iterations,超参数沿用原论文设置。物理仿真与 Gaussian 模型生成解耦,因此训练阶段主要成本来自场景重建,而不是后续每次编辑或物理仿真都重新训练。

这一点对自动驾驶数据生成很重要:如果每创造一个碰撞情形都要重新训练完整场景,框架的实用性会大幅下降;Real2Sim 更像是先把真实路段资产化,然后在资产上反复做编辑和仿真。

实验结果

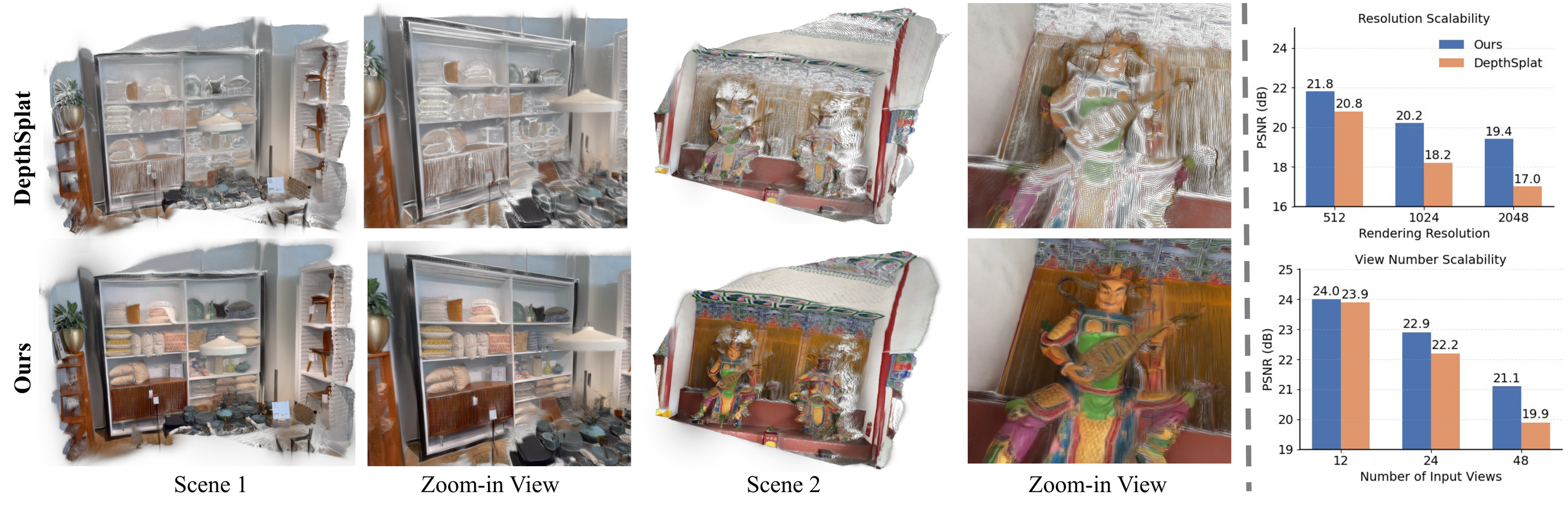

1. 场景渲染与 Gaussian 重建

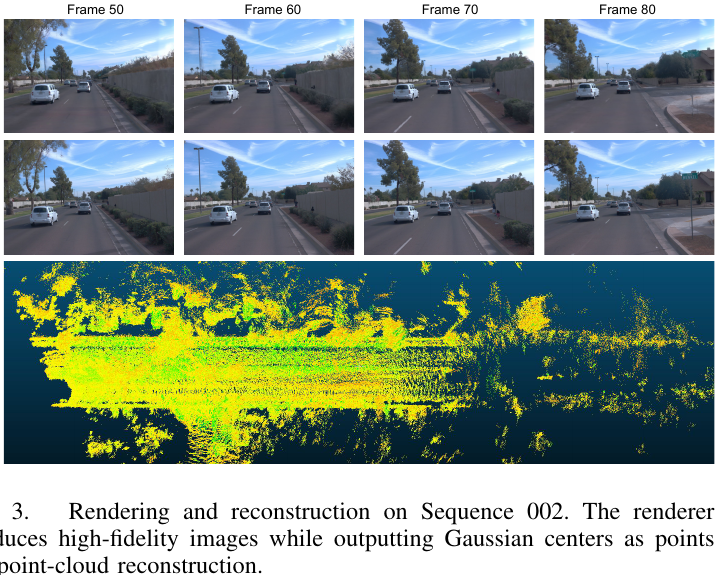

图 3 展示 Sequence 002 的渲染和重建结果。上方是前向相机在 frame 50、60、70、80 的渲染图,下方是把每个 Gaussian primitive 的中心当作点位置得到的点云式重建。可以看到,道路、树木、车辆和远处建筑都被组织到统一的 3D 表示中;这一步不是最终目标,但它决定了后面编辑和物理模拟的上限。

值得注意的是,Real2Sim 的实验重点不是报告 PSNR、SSIM、LPIPS 这类新视角合成指标,而是证明重建结果足够支撑后续可编辑仿真。也就是说,渲染质量在这里服务于“真实道路场景资产化”。

图 4 展示 Sequence 031。论文强调这个序列处在较窄街道中,场景包含车辆、建筑和阴影变化。从可视化结果看,渲染不仅保留了车辆外形和道路结构,也较好复现了阴影效果。对自动驾驶仿真而言,阴影并不是装饰性细节,它会直接影响检测器、跟踪器和端到端驾驶模型的输入分布,因此真实光照和背景纹理的保留非常关键。

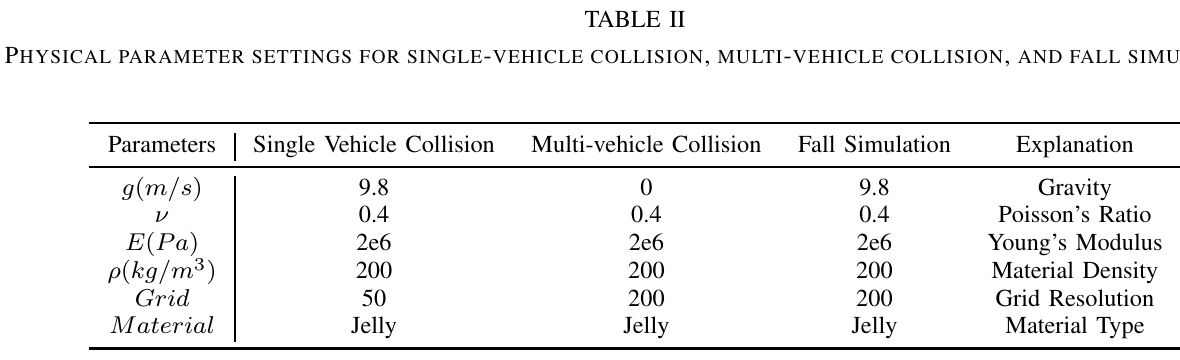

2. 物理参数设置

表 II 给出了三组仿真的物理参数:单车碰撞、多车碰撞和坠落仿真。三者的泊松比均为 0.4,杨氏模量均为 $2e6$ Pa,材料密度均为 200 kg/m³,材料类型都设为 Jelly。单车碰撞和坠落仿真使用重力 $g=9.8$,多车碰撞中重力设为 0;网格分辨率在单车碰撞中为 50,在多车碰撞和坠落仿真中为 200。

这张表很关键,因为它暴露了 Real2Sim 当前的物理建模取舍。车辆并没有被建成带车架、悬挂、轮胎和接触摩擦的复杂刚柔耦合系统,而是被近似成一个整体软体材料。因此论文里的形变更像是在验证 Gaussian-MPM 接口能否工作,而不是给出完全真实的汽车碰撞工程仿真。

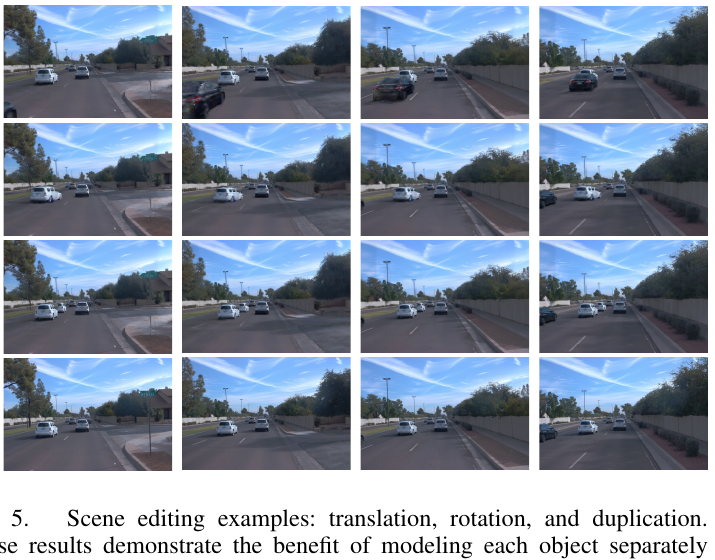

3. 实例级场景编辑

图 5 展示了三种编辑能力:平移、旋转和复制。第一行把黑色车辆从左车道平移到中间车道;第二行把中间车道白色车辆向右旋转 15 度;第三行复制一辆车并沿前进方向平移大约两个车身长度。

这组结果说明,Real2Sim 的对象级 Gaussian cluster 分解确实给交通场景编辑提供了直接操作柄。相比纯图像生成,这种编辑不是在像素空间里“想象一辆车”,而是在真实重建的 3D 场景中移动一个已有物体实例。它的优势是背景、相机视角和其他车辆关系自然保持一致;风险是如果编辑幅度太大,车辆暴露出训练视角未覆盖的一侧,渲染质量会下降。

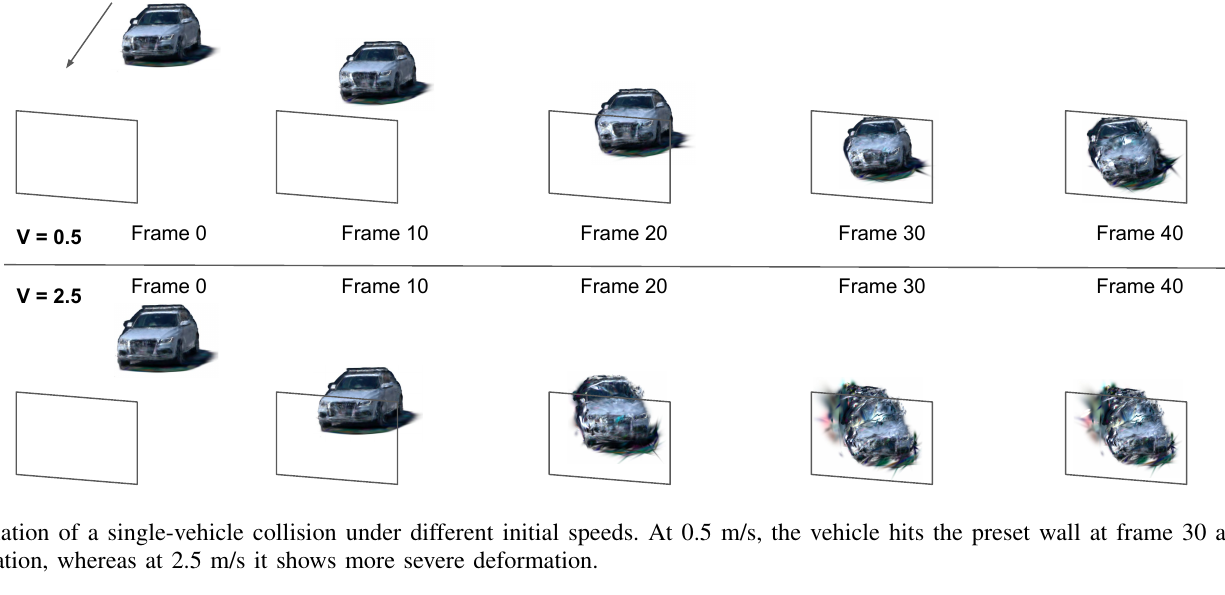

4. 单车碰撞:速度改变带来形变强度变化

图 6 是单车碰撞实验。论文从 Sequence 031 中重建一辆白色 SUV,在其前方放置一个虚拟碰撞平面,并分别设置初速度 0.5 m/s 和 2.5 m/s。低速情况下,车辆大约在 frame 30 撞上墙面,车头出现轻微形变;高速情况下,碰撞更早释放更多动能,形变明显更强。

这组实验的意义在于展示 Real2Sim 能把“初速度”这种物理变量映射到可见的场景变化中。也就是说,编辑不只是改变位置,还可以改变交互过程。但论文也明确提醒,这里的车体材料参数偏软,形变被放大,并不能直接等同真实汽车碰撞。

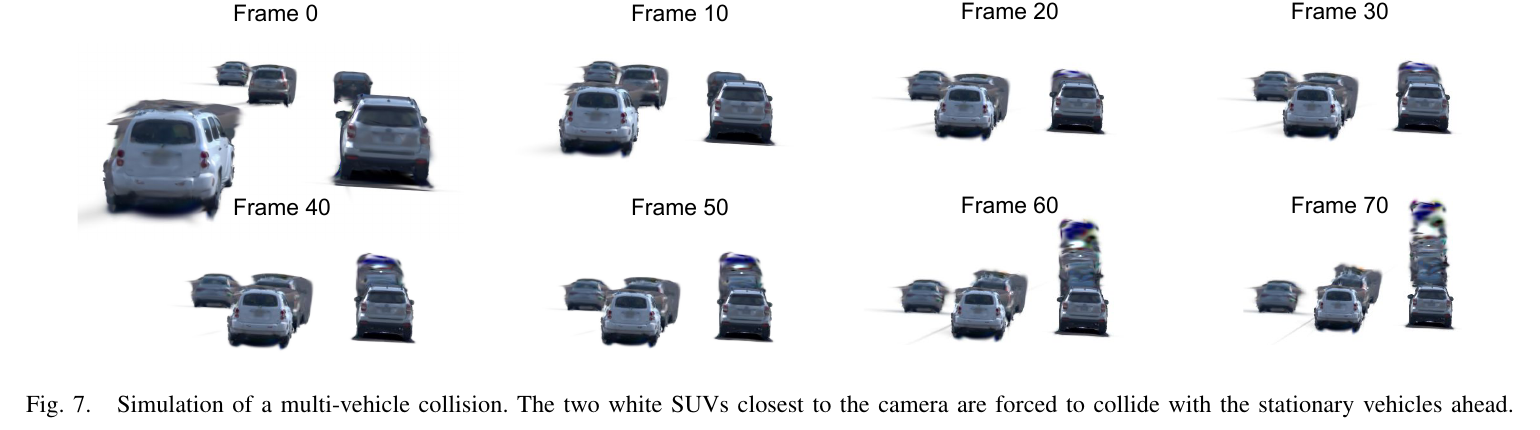

5. 多车碰撞:对象-对象交互

图 7 展示多车碰撞。实验从 Sequence 002 提取多辆车,给靠近相机的两辆白色 SUV 设置初速度 3.5 m/s,让它们撞向前方静止车辆。为了让所有车辆保持在同一水平面上,论文在该实验中设置 $g=0$,也没有使用虚拟地面平面。

从 frame 20 到 frame 70 的演化可以看到,右侧 SUV 先撞上前车并使其抬起,左侧 SUV 随后在 frame 30 左右撞上前车,并把前车向侧向推开。这个例子体现了 MPM 接入后,多个独立 Gaussian 对象之间可以发生相互作用,而不是只做静态摆放。

但也正因为重力被设为 0,这组结果更像是受控物理交互演示,而不是完整交通事故模拟。它证明系统接口可行,却还没有达到交通安全仿真中对动力学真实性的要求。

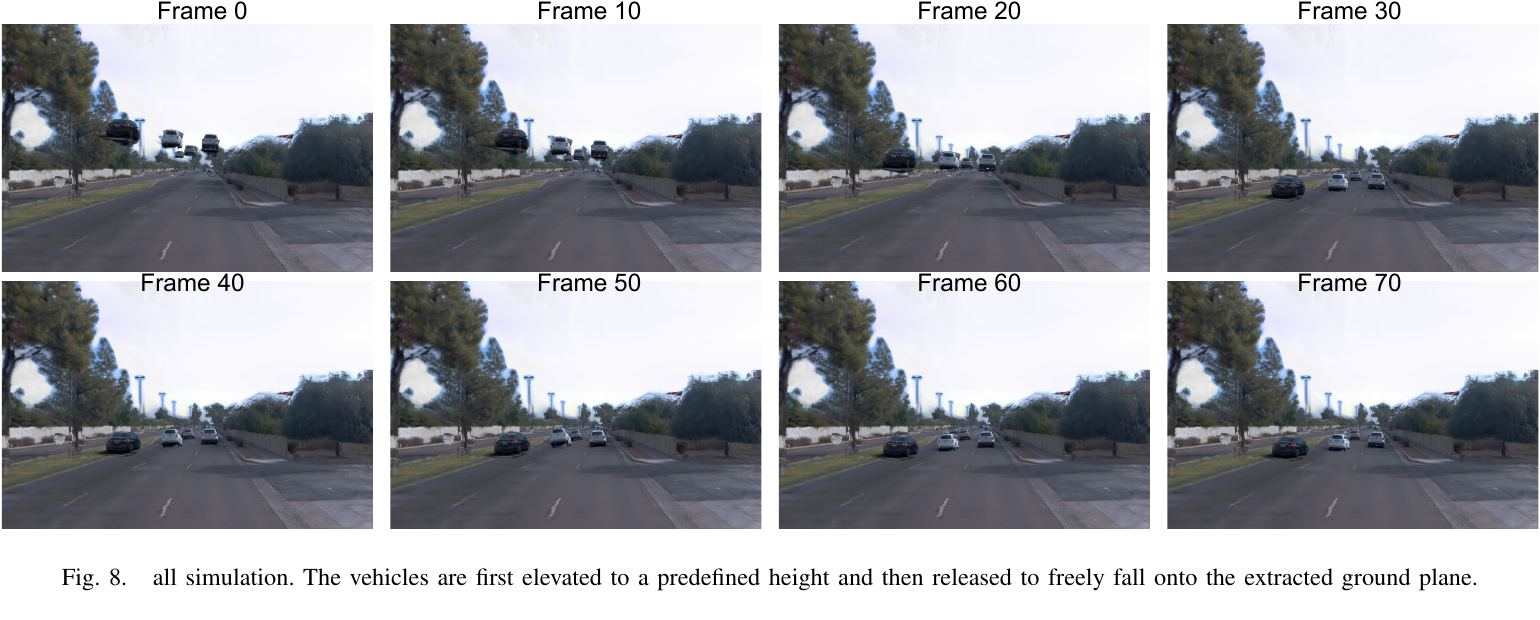

6. 坠落仿真与路面提取

图 8 展示车辆坠落仿真。车辆一开始被放在空中,随后在重力作用下下落,约 0.5 秒后接触地面,发生轻微反弹后停在道路表面。这个实验对应的是对象-环境交互:车辆不仅与其他车辆碰撞,也能与由真实场景提取出的道路平面交互。

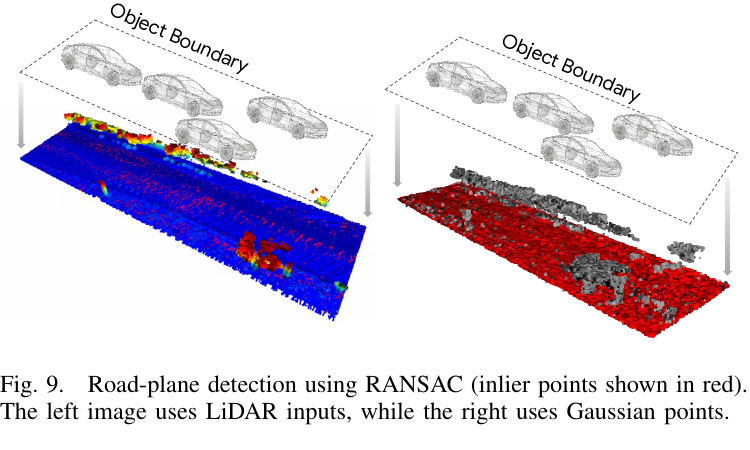

图 9 解释了坠落仿真的路面来源。论文用 RANSAC 做 road-plane detection,左侧使用 LiDAR 点云,右侧使用 Gaussian points。红色点表示内点。流程大致是:根据车辆在图像中的 2D bounding box,把相关区域投影到背景点云中,在附近筛选点,再用 RANSAC 估计地面平面,最后生成 surface collider。

这张图说明 Real2Sim 并不是凭空指定一个无限平面,而是尽量从真实场景几何中提取碰撞面。对自动驾驶来说,这一点很重要,因为道路坡度、局部几何和车辆相对地面的关系都会影响合成数据是否可信。不过从图中也能看出,Gaussian points 与 LiDAR 点云的密度和噪声形态不同,实际路面估计仍可能受到重建质量影响。

优势与不足

优势

把 Gaussian Splatting 的真实场景重建能力和 MPM 的物理交互能力接在了一起,使自动驾驶数据生成从“看起来真实”进一步走向“交互过程可控”。

对象级 Gaussian cluster 让编辑操作很直接。平移、旋转、复制、碰撞、坠落都可以围绕独立车辆实例展开,而不必重新生成整个场景。

论文使用 Waymo 真实多相机/LiDAR 序列做资产来源,避免了传统仿真从手工场景建模开始带来的巨大外观域差距。

单张 RTX 4090 即可完成实验中的训练与推理,说明该框架至少在实验室规模下具备可复现性,不是只能依赖大规模集群的系统。

图 6-9 展示了明确的对象-平面、对象-对象、对象-环境交互,这比只展示静态插车或简单轨迹编辑更进一步。

不足

物理真实性仍然有限。表 II 中车辆统一使用 Jelly 材料,并被建模为单个软体对象,缺少真实车辆的刚体结构、轮胎、悬挂、摩擦和碰撞吸能机制。

渲染与物理仿真是解耦的。MPM 从某一时刻的 Gaussian snapshot 出发预测未来状态,模拟后的 Gaussian 分布可能偏离原始训练分布,从而带来渲染退化。

Gaussian 建模依赖训练视角数量。若编辑后出现原始相机没有充分观察到的车辆角度,外观会变模糊或不完整。

实验以可视化为主,缺少大规模定量评估。论文展示了渲染 FPS、物理参数和典型案例,但还没有证明这些合成 corner cases 能在检测、跟踪、预测或端到端驾驶训练中带来稳定增益。

路面提取和碰撞平面估计依赖点云/重建质量。在复杂坡道、遮挡、稀疏点云或非平整道路上,RANSAC 平面假设可能不够。

记忆点

Real2Sim 的核心不是单纯 4DGS,而是“真实场景 Gaussian 资产 + 实例级编辑 + MPM 物理求解”。

车辆被拆成独立 Gaussian cluster 后,自动驾驶场景编辑才真正变得可控:移动一辆车、旋转一辆车、复制一辆车,都不会破坏整个背景。

MPM 把 Gaussian primitive 当粒子处理,使车体碰撞、形变、下落和反弹可以通过物理参数控制。

表 II 里的 Jelly 材料是理解论文边界的关键:它证明接口能跑通,但还不是高保真车辆动力学仿真。

这篇论文的价值在于提供了一条从真实路采数据到可编辑、可交互、可生成长尾场景的路线,后续真正要验证的是这些合成数据能否提升自动驾驶下游任务。