Mix3R: Mixing Feed-forward Reconstruction and Generative 3D Priors for Joint Multi-view Aligned 3D Reconstruction and Pose Estimation

作者:Siyou Lin, Zhou Xue, Hongwen Zhang, Liang An, Dongping Li, Shaohui Jiao, Yebin Liu

单位:Tsinghua University, Beijing Normal University, ByteDance

会议:SIGGRAPH 2026 Conference Track / arXiv 2026

链接:https://arxiv.org/abs/2605.03359

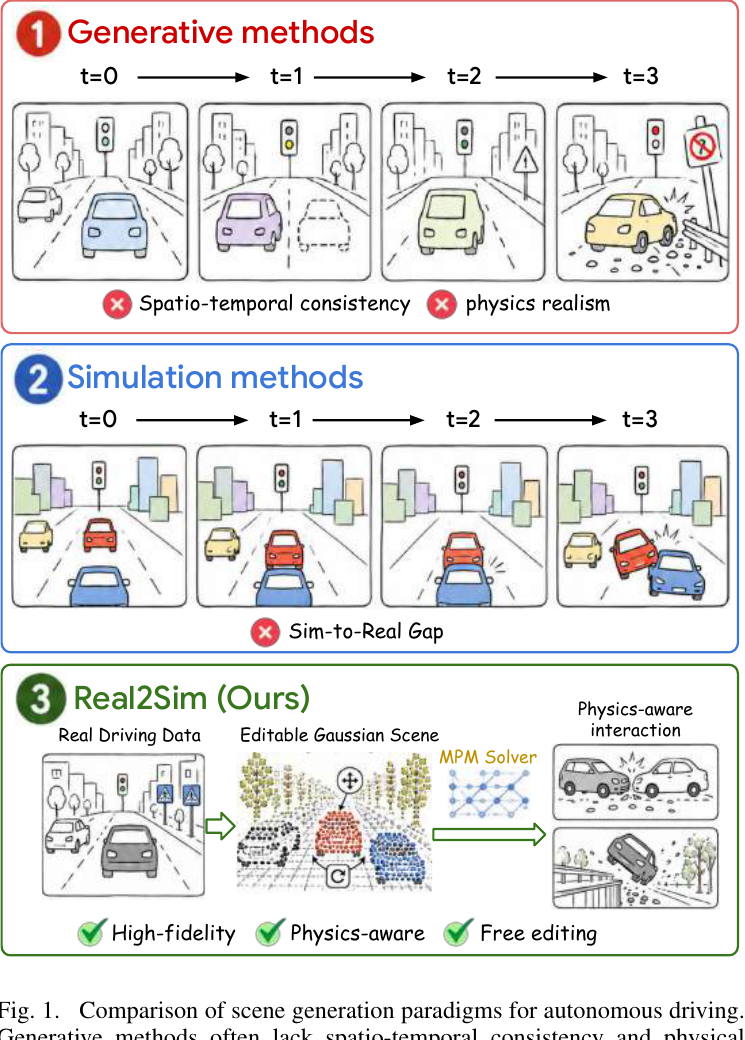

研究动机

传统多视角重建方法例如 COLMAP 依赖密集相机、特征匹配和多视角几何优化,几何精度很强,但在稀疏视角、纹理不足或遮挡明显的物体上容易失效,计算流程也不够前馈。

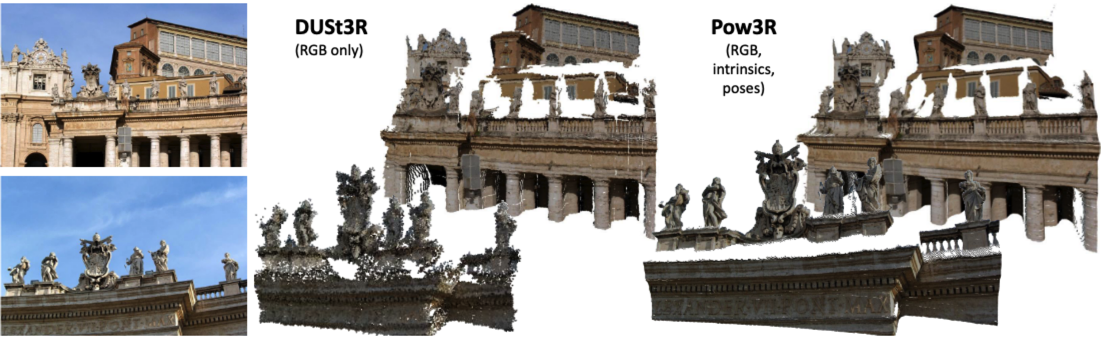

前馈式重建方法例如 VGGT、$\pi^3$、MapAnything 和 Depth Anything 3 可以直接预测深度、点图、射线图或相机位姿,优势是像素级对齐很自然;问题是它们主要重建可见区域,对输入视角之间的重叠依赖较强,所以稀疏视角下容易得到不完整或错误的形状。

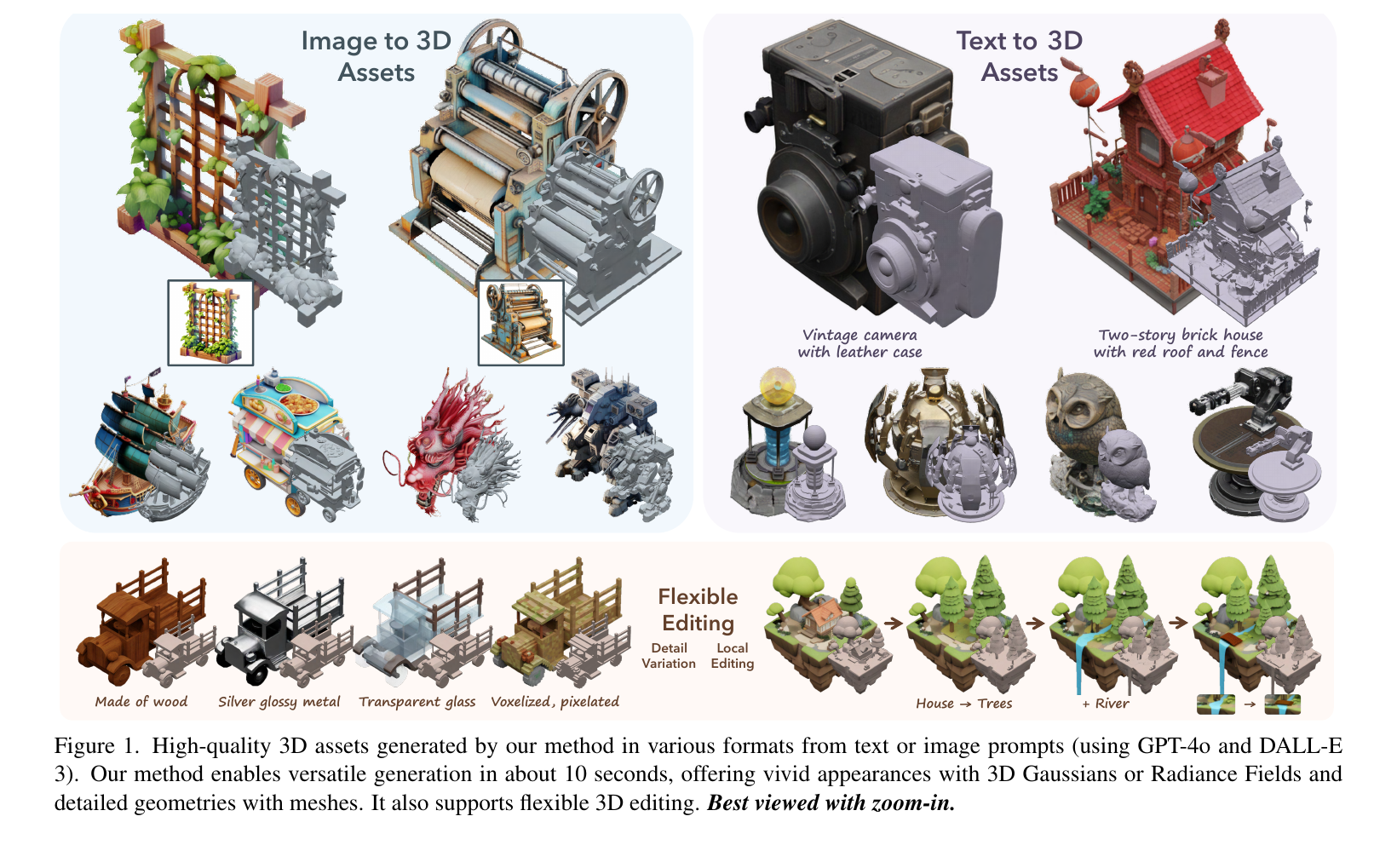

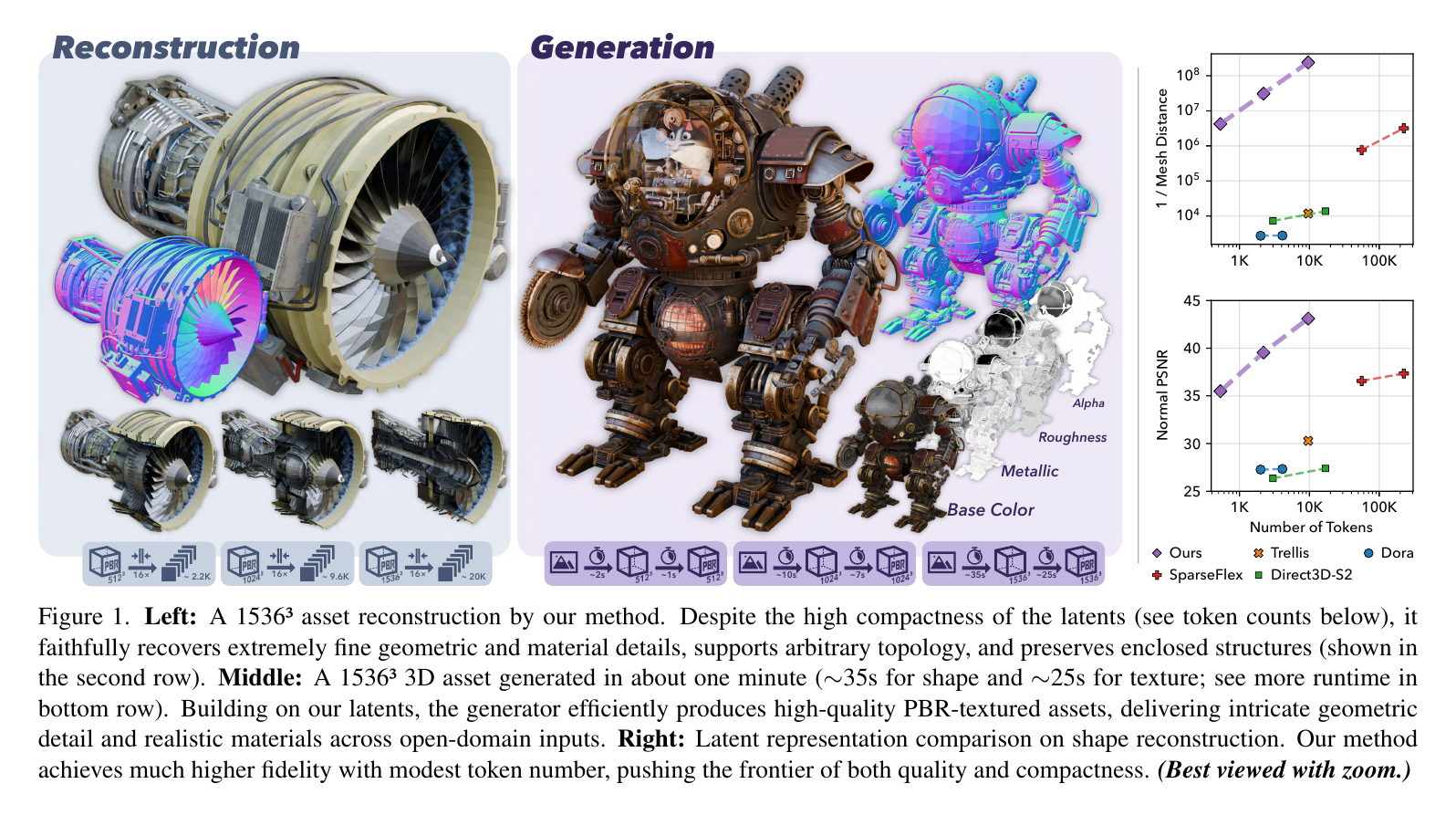

3D 生成模型例如 TRELLIS 可以补全完整物体形状,视觉上更像一个完整资产;但它们的图像条件通常不是显式的 2D-3D 对齐控制,生成结果可能只是“看起来像”输入物体,却没有忠实保留尺寸、纹理位置和相机几何。

Mix3R 想解决的是一个鸡生蛋问题:如果前馈分支知道完整 3D 先验,它的点图和相机就不会只依赖局部重叠;反过来,如果生成分支知道可靠相机和像素对齐,它也能把纹理更准确地贴到生成形状上。

核心问题:能否把前馈重建的像素对齐能力和 3D 生成模型的完整几何先验放进同一个对齐框架里,让两者互相提供约束,而不是单向蒸馏或后处理拼接?

核心方法

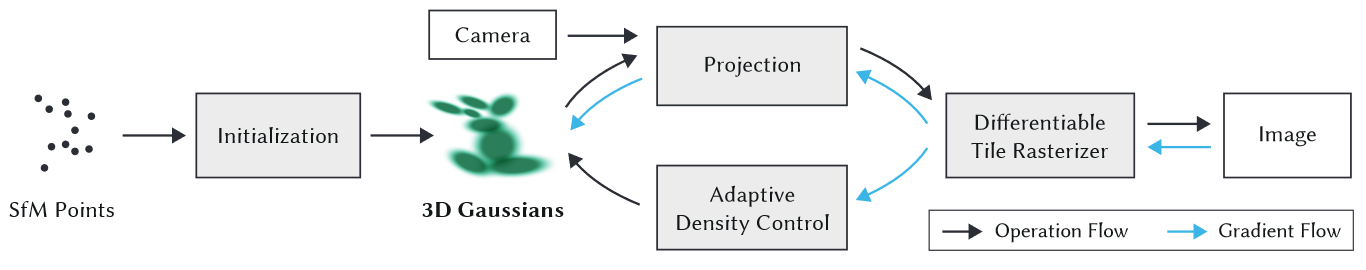

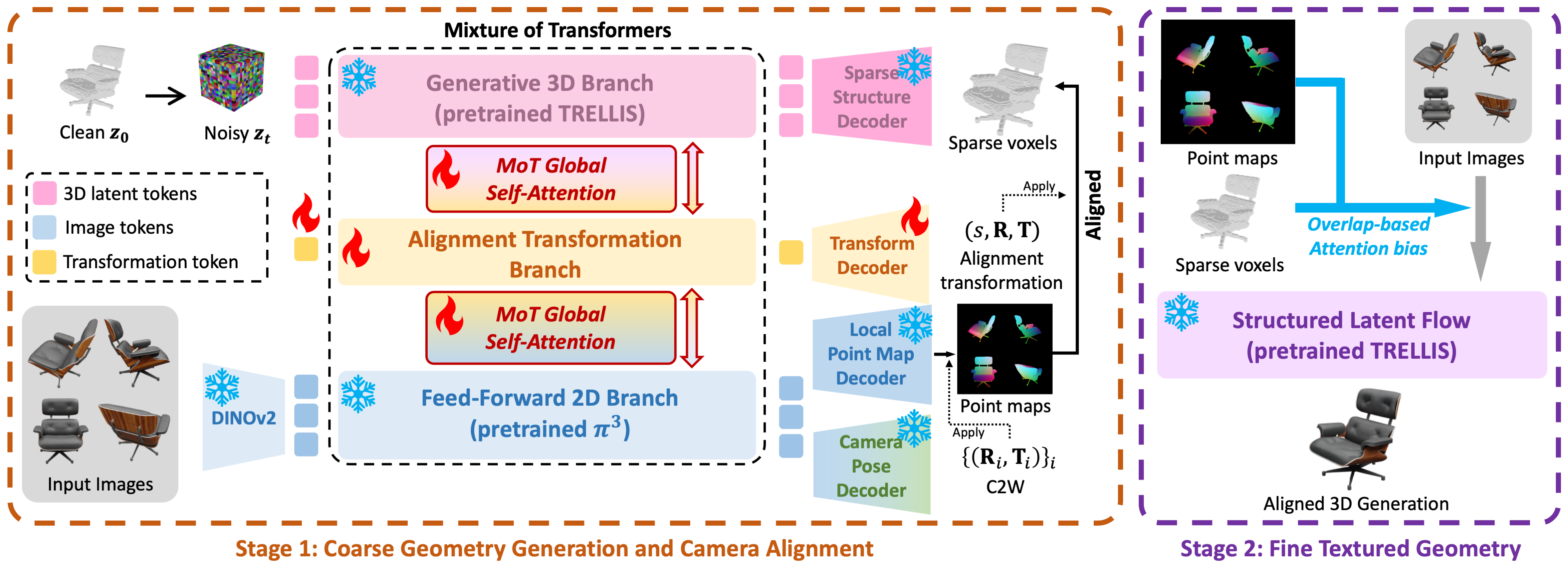

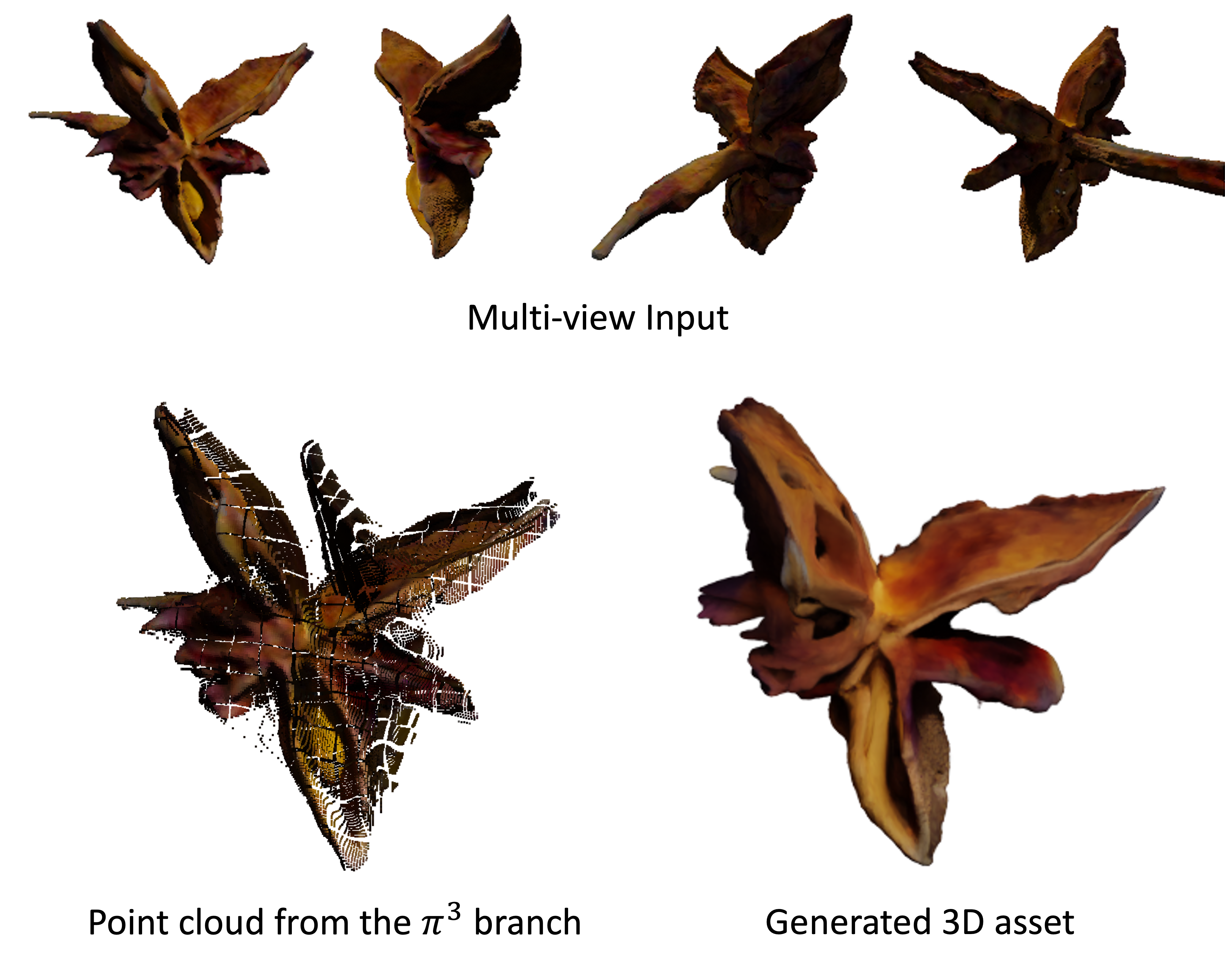

Mix3R 采用两阶段粗到细框架。第一阶段从多视角、未知位姿输入图像出发,同时生成粗 3D 结构、局部点图、相机位姿,以及把点图对齐到 3D 体素空间的相似变换;第二阶段利用这种已经建立好的 2D-3D 对齐关系,在 TRELLIS 的纹理几何生成模型上加入 overlap-based attention bias,从而生成更贴合输入图像的最终 3D 资产。

- Stage 1:把 TRELLIS 和 $\pi^3$ 混成一个 MoT 网络

第一阶段的 3D 分支来自 TRELLIS 的 sparse structure flow model,负责生成稀疏结构 latent;2D 分支来自 $\pi^3$ 的 backbone transformer,负责处理多视角图像并输出点图和相机位姿。由于 TRELLIS 的体素空间和 $\pi^3$ 的点图空间并不天然一致,作者额外加入一个 transformation token,用来预测相似变换 $(s,\mathbf R,\mathbf T)$。

整个网络输入包括 noisy sparse structure latent $\mathbf z_t$、时间步 $t$、多视角图像和 transformation token。输出包括 flow matching 的速度 $\mathbf v$、每个视角的局部点图 $\mathbf X_i$、相机位姿 $(\mathbf R_i,\mathbf T_i)$,以及全局对齐变换。点图经过相机变换和相似变换后被监督到 GT point maps 上:

训练目标由 TRELLIS 的 flow matching loss、点坐标 L1 loss 和法向 L1 loss 构成。一个细节很关键:点图监督权重依赖时间步 $t$,作者设置 $\lambda{\rm pts}={\rm Sigmoid}(-24t+9)$,并让 $\lambda{\rm nml}=0.1\lambda_{\rm pts}$。这等于只在低噪声、粗几何已经可恢复时强监督点图对齐;高噪声时不强迫点图去解释几乎没有几何信息的 latent。

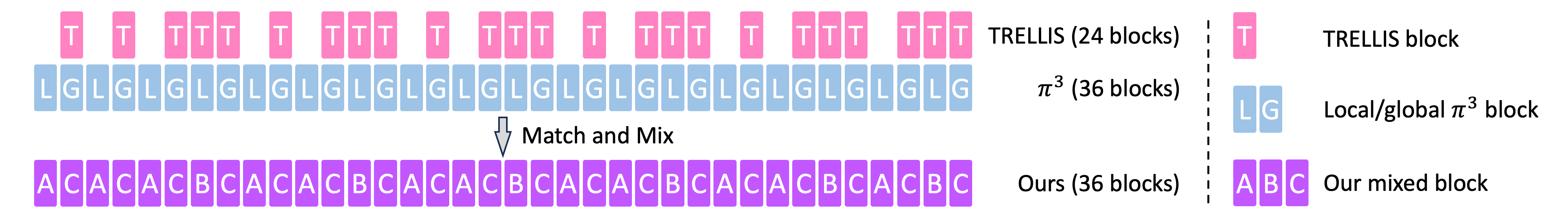

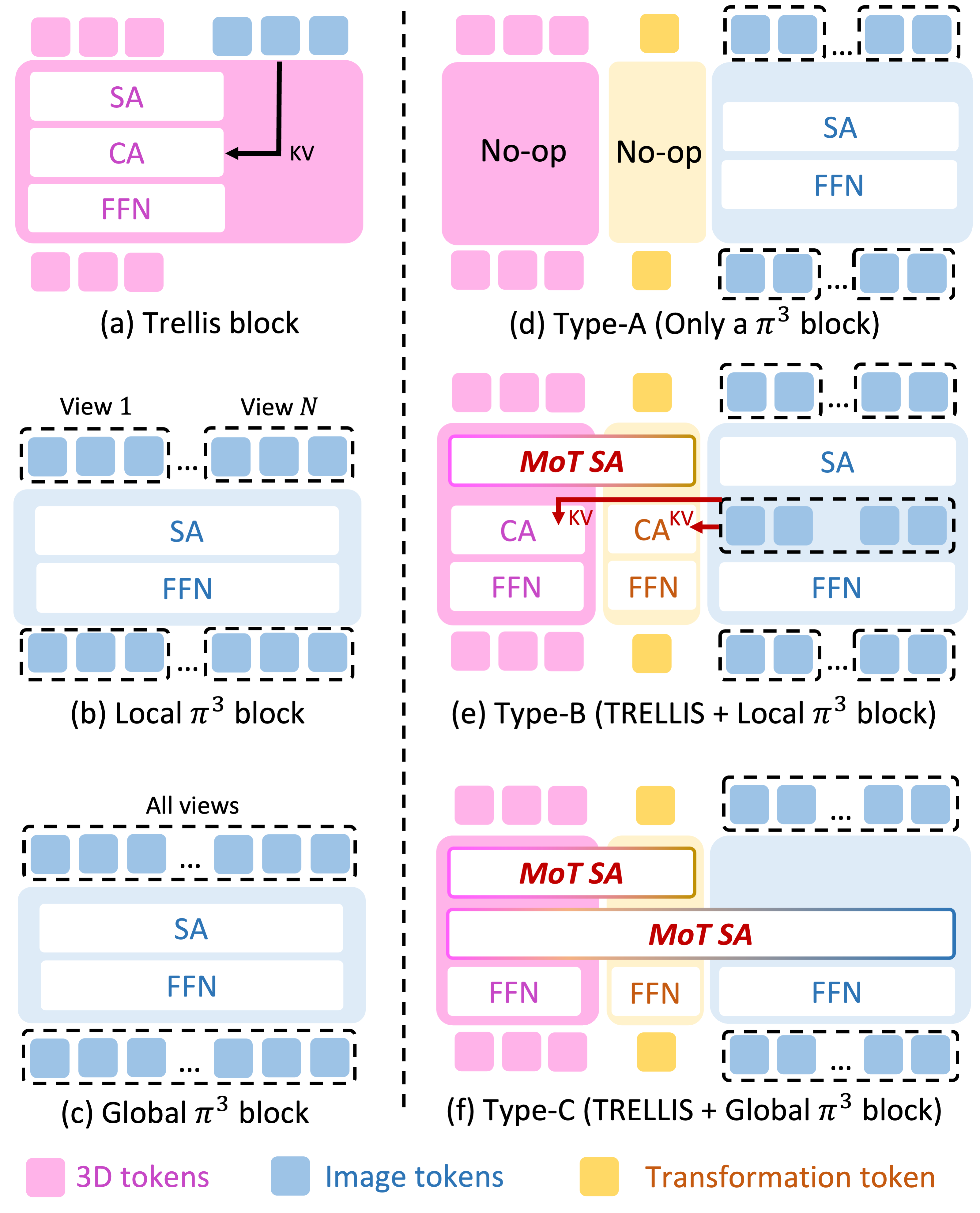

- Mixture-of-Transformers 的 block matching

TRELLIS 有 24 个 transformer blocks,$\pi^3$ 有 36 个 blocks,并且 $\pi^3$ 交替使用 local self-attention 和 global self-attention。Mix3R 的设计目标不是重写两个模型,而是在尽量保留预训练权重的前提下让 2D token、3D token 和 transformation token 交换信息。

作者先把 $\pi^3$ 的 18 个 global blocks 均匀匹配到 TRELLIS 的 24 个 blocks 中,再把剩余 TRELLIS blocks 按顺序匹配到 local blocks。最终形成三类混合块:Type-A 只保留 local $\pi^3$ block;Type-B 把 TRELLIS block、local $\pi^3$ block 和 transformation branch 通过 cross-attention / MoT attention 连接;Type-C 则在 global $\pi^3$ block 上扩展成覆盖三种模态的大型 MoT self-attention。

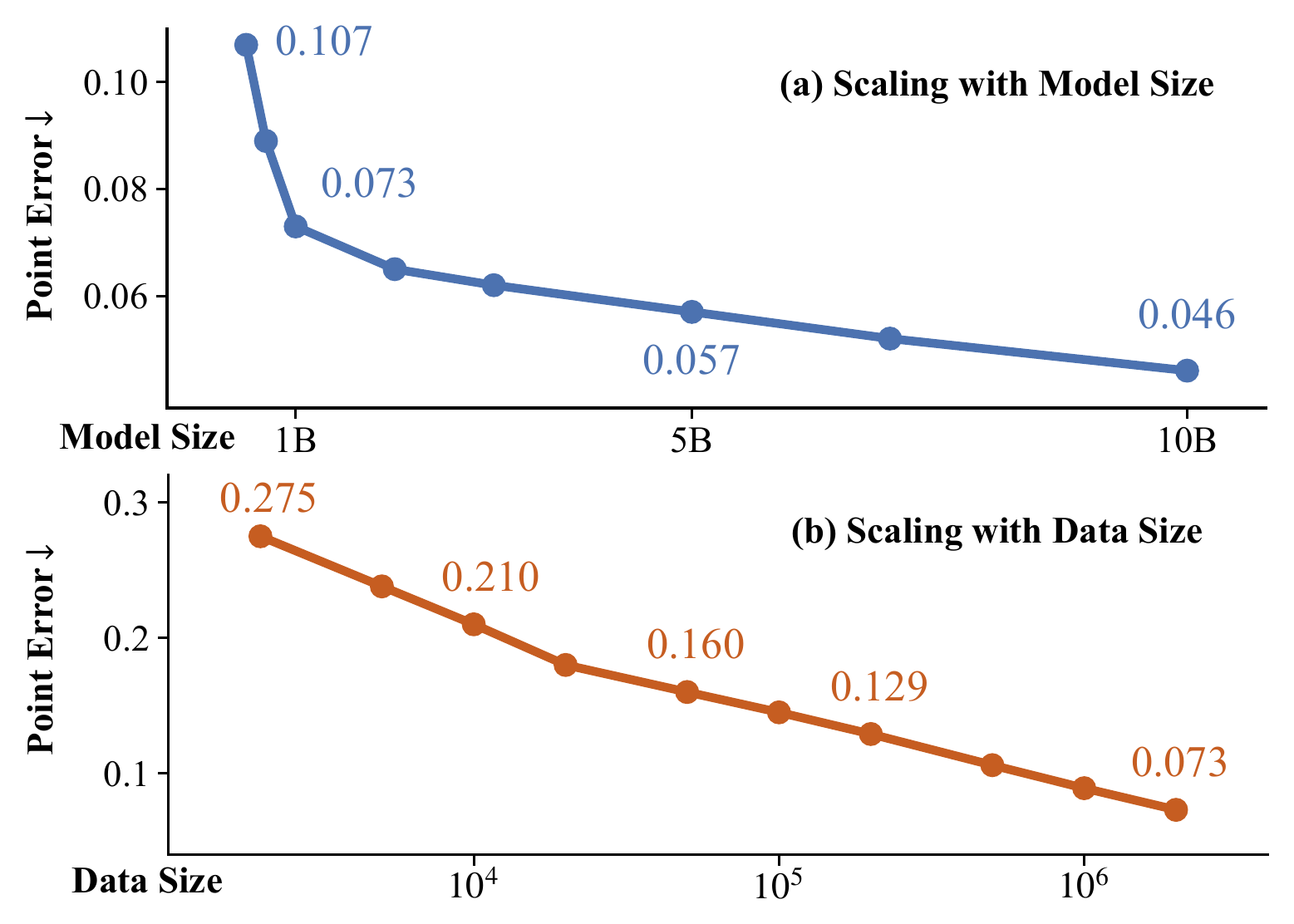

训练时,已经有预训练权重且没有被新模块影响的参数被冻结;新增参数、MoT self-attention、cross-attention 等参与训练。补充材料中给出的规模是核心训练模型 1.71B 参数,其中 839.78M 可训练。

- Stage 2:用 overlap-based attention bias 做训练自由的纹理几何对齐

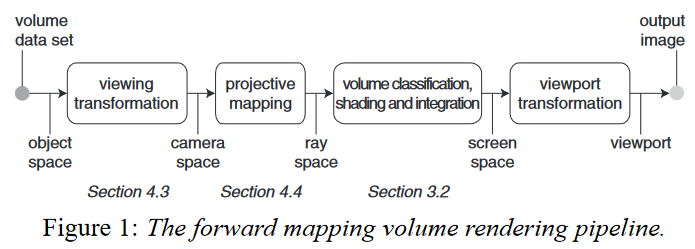

第一阶段得到 sparse voxels、对齐点图和相机后,第二阶段仍使用 TRELLIS 的 structured latent flow model 生成最终 textured geometry。区别在于,Mix3R 会计算每个 3D voxel 与每个图像 patch token 的重叠关系,并把这个重叠关系变成 cross-attention bias。

具体来说,体素 token $\mathbf f_j$ 对应一个 3D voxel $\mathbf p_j$,图像 token $\mathbf y_k$ 对应某个视角中的 patch。作者用对齐后的点图判断 patch 里的 3D 点是否落入该 voxel,并计算 average point count。若某个 patch 与 voxel 的重叠高于该 voxel 的平均重叠,就给它正向 attention bias;负向 bias 被裁剪为 0。实验中 bias 系数 $\alpha=5$。

这个设计的直觉很直接:如果某个图像 patch 真正覆盖了某个 3D voxel,生成该 voxel 的纹理/几何 latent 时就应该更多看这个 patch。它不需要重新训练 TRELLIS stage-2,只是在推理时修改 cross-attention score。

- 相机参数 refinement

Stage 1 预测的是相机外参,内参并不直接输出。作者先用最小二乘解透视投影方程估计内参,再用 DRTK differentiable renderer 联合优化内参和外参。优化目标是渲染图像与输入图像之间的 RGB loss 和 mask loss;补充材料中写到使用 Adam、学习率 $10^{-2}$、2000 steps,并在 100 steps loss 无下降时 early stopping。

数据集

Train:TRELLIS-500k 的子集。原始 TRELLIS-500k 来自 Objaverse-XL、ABO 和 HSSD。由于完整 TRELLIS 数据处理流水线成本很高,作者使用 TRELLIS 生成训练所需的 sparse structure latents、structured latents、多视角渲染和相机参数,最终得到 404354 个对象;每个对象配有 GT latent codes 和覆盖上半球的 32 张渲染图,焦距也有变化。

训练时,每一步随机选一个对象并从 32 张渲染中采样 4 个视角。采样策略混合三种模式:完全随机采样概率 0.2,nearest-view sampling 概率 0.4,farthest-view sampling 概率 0.4。

Eval:Toys4k 和 Google Scanned Objects (GSO)。定量评测包括输入对齐、novel-view rendering、Chamfer distance 和相机位姿精度;定性评测还包括真实手机拍摄物体。

Baselines:不同实验中比较 ReconViaGen、MV-SAM3D、TRELLIS、UniLat3D、VGGT 和 $\pi^3$。其中 TRELLIS / UniLat3D 使用官方 multi-image API 适配多视角输入,MV-SAM3D 使用训练自由的多视角扩展。

算力

训练:学习率 $10^{-4}$,cosine schedule,400k steps,batch size 16。核心训练在 16 张 NVIDIA A100 GPU 上运行约一周。

推理:输入分辨率为 518。4 个输入视角、单张 NVIDIA A100 GPU 上,stage-1 生成 50 steps,约 30 秒;stage-2 生成 25 steps,约 3 到 10 秒,取决于第一阶段生成的 voxel 数量;attention bias 计算通常小于 10 秒。相机 refinement 每个视角不超过 10 秒,如果不需要精确位姿可以跳过。

实验结果

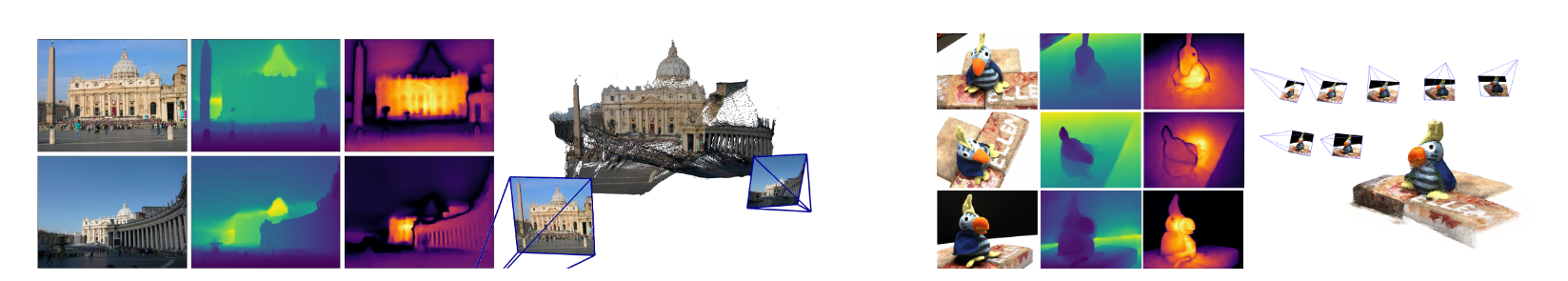

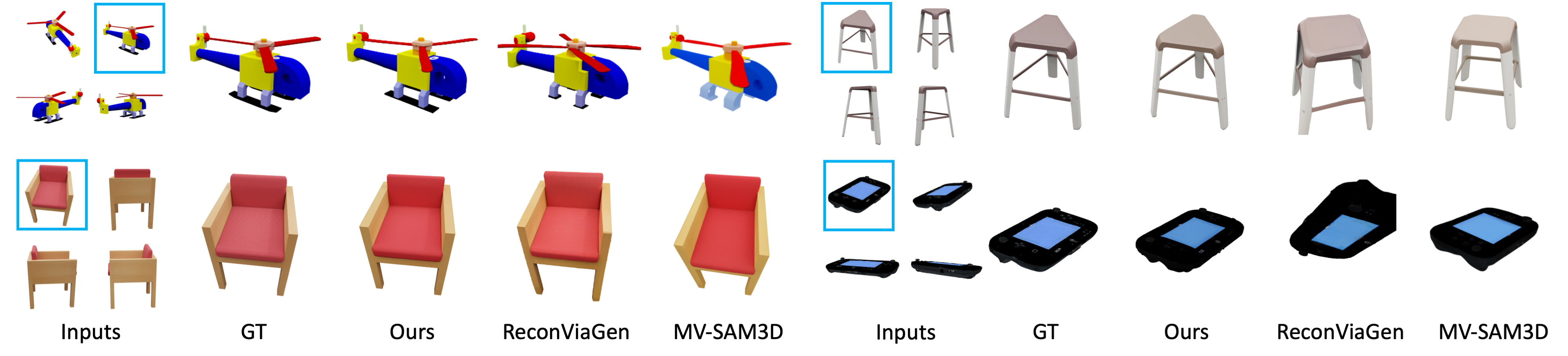

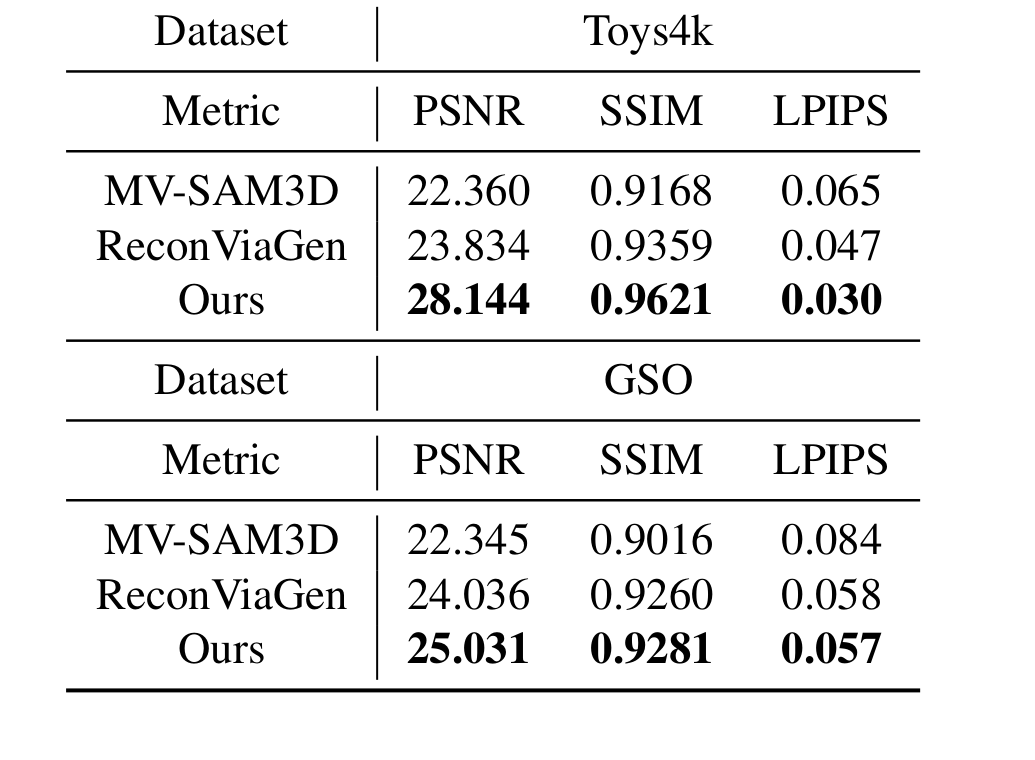

- 输入对齐:生成结果能否用预测相机重新投影回输入图像

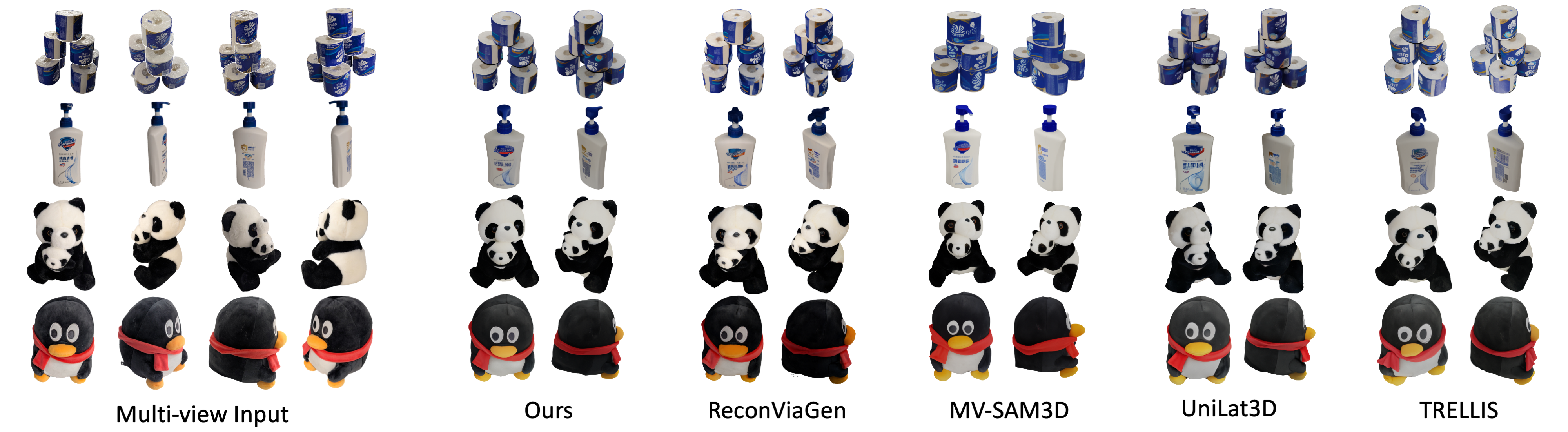

这个实验同时检验两件事:生成的 3D 形状是否正确,以及预测相机是否能把形状投影回输入视角。Mix3R 在 Toys4k 和 GSO 上的 PSNR、SSIM、LPIPS 都优于 ReconViaGen 和 MV-SAM3D。定性图里也能看到,baseline 容易出现姿态错、结构错或纹理位置不一致;Mix3R 的重投影更接近输入图像。

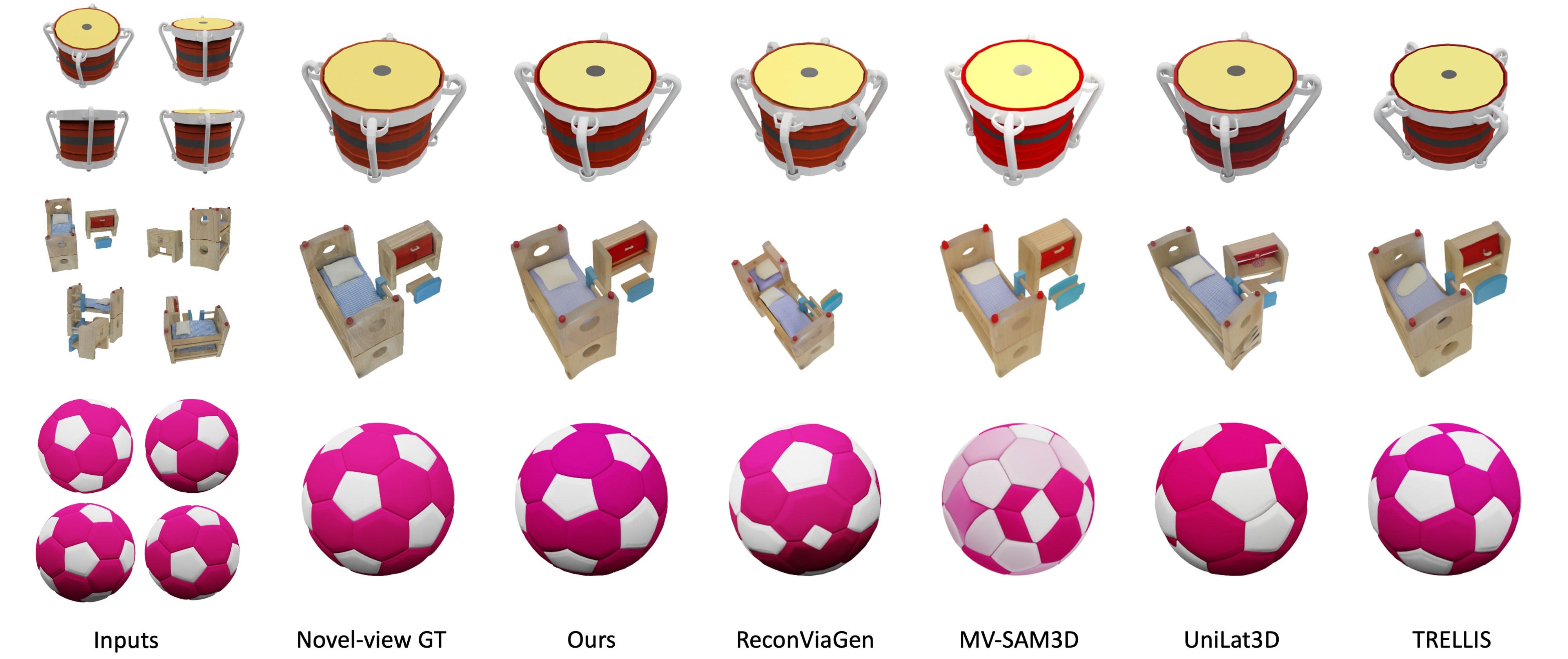

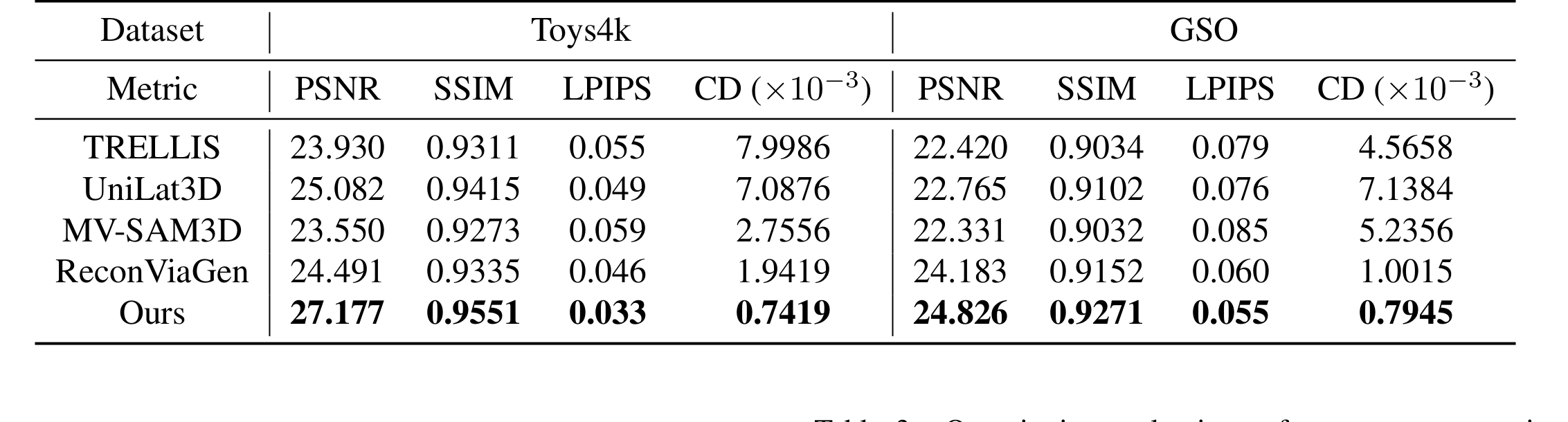

- Novel-view rendering 和几何精度

在不依赖预测相机的生成质量评测中,所有生成形状先与 GT 做 similarity alignment,然后计算 novel-view PSNR、SSIM、LPIPS 和 Chamfer distance。Mix3R 在 Toys4k 和 GSO 上四个指标全部最好,尤其 Chamfer distance 相比 TRELLIS 和 UniLat3D 明显更低,说明它不是只生成“看起来合理”的物体,而是更好保留了输入物体的尺寸比例和几何结构。

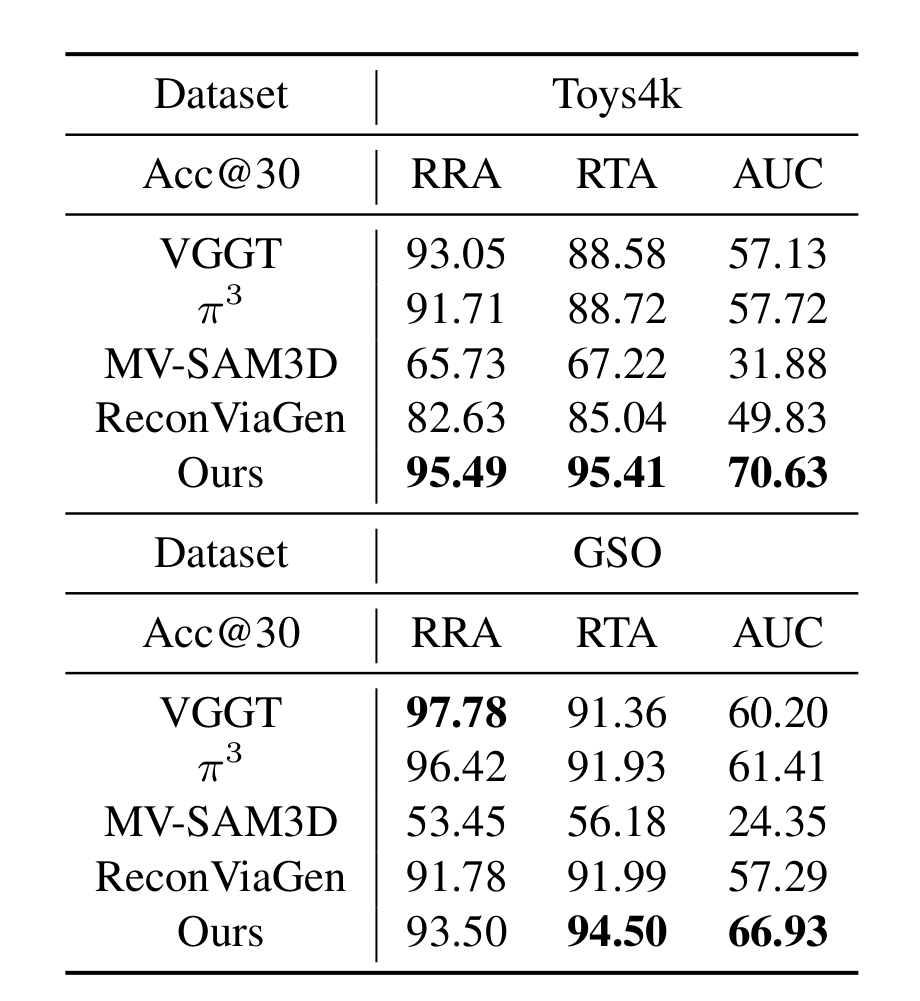

- 相机位姿估计

相机评测使用 30 度阈值下的 relative rotation accuracy、relative translation accuracy 和 AUC。Mix3R 在 Toys4k 上三个指标都最好;在 GSO 上,VGGT 的 RRA 更高,但 Mix3R 的 RTA 和 AUC 最好,整体说明生成分支带来的 3D 先验并没有损害位姿估计,反而能帮助点图和相机落到更一致的物体坐标里。

- 真实手机拍摄

真实手机拍摄实验没有提供严格定量指标,但定性结果显示 Mix3R 与 ReconViaGen 接近,其他方法更容易出现几何扭曲或纹理扭曲。这里也能看出方法的边界:真实数据中的光照、反光、阴影与训练生成数据的分布并不完全一致。

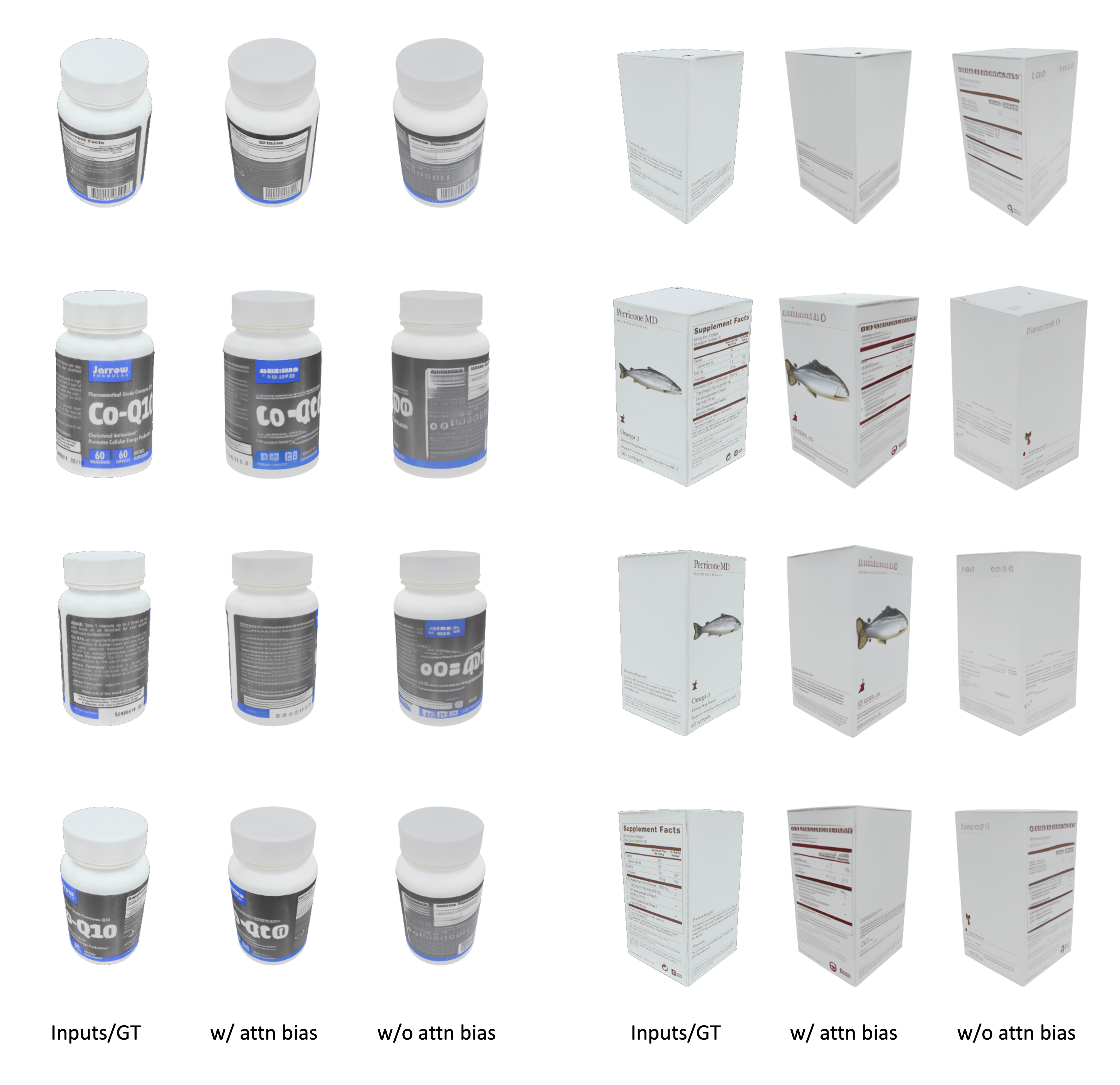

- Attention bias 和 refinement 的作用

补充材料中指出,attention bias 的平均指标提升看起来不一定很大,但在“几何对称、纹理非对称”的物体上非常关键。例如球、瓶子、盒子这类形状本身存在旋转歧义,如果没有 patch-to-voxel 的 overlap bias,纹理很容易贴到错误方位。camera refinement 则进一步提升重投影和对齐指标,但如果只关心生成资产外观,可以不启用。

优势与不足

优势

Mix3R 的贡献不是简单把 VGGT / $\pi^3$ 特征喂给生成器,而是让 feed-forward reconstruction branch 和 generative 3D branch 在 MoT 结构中互相交换信息。前馈分支获得完整 3D 先验,生成分支获得像素级几何信号。

第一阶段同时输出 sparse voxels、point maps、camera poses 和 alignment transformation,让第二阶段可以把“哪个图像 patch 对应哪个 voxel”变成显式 attention bias。这比纯文本或全局图像条件更适合处理纹理对齐。

方法大量复用 TRELLIS 和 $\pi^3$ 的预训练能力,只训练新增或被混合影响的模块;从工程角度看,它提供了一种把不同 3D foundation models 拼接成联合模型的具体范式。

实验覆盖输入对齐、生成质量、几何误差和位姿估计四条线。结果显示 Mix3R 不只是提高某个单点指标,而是在“生成完整物体”和“保持输入对齐”之间取得了更好的折中。

不足

训练和推理都不轻。核心训练模型 1.71B 参数,训练需要 16 张 A100 约一周;推理阶段还包括 50-step stage-1、25-step stage-2、attention bias 和可选相机 refinement,离实时交互还有距离。

方法对输入视角配置仍有分布依赖。论文在局限中明确指出,当测试视角与训练分布偏离较大时,$\pi^3$ 分支的几何特征可能反过来干扰 3D 分支,导致性能下降。

训练数据由 TRELLIS 生成,缺少复杂光照和视角相关视觉效果。因此面对非均匀光照、强阴影、镜面反射或更野外的数据时,点图匹配和 overlap bias 都可能不稳定。

TRELLIS VAE decoder 在本文中被冻结,最终质量仍受预训练 TRELLIS latent distribution 和 decoder 能力上限约束。如果底层生成器无法表达某类细节,Mix3R 的对齐机制也不能凭空生成它。

记忆点

Mix3R 最有价值的中间变量是 aligned point maps:它既保留前馈重建的像素对齐,又能作为 2D patch 和 3D voxel 的桥梁。

MoT 的意义在于“保留预训练能力再混合”,而不是从零训练一个巨大的统一模型。Type-A/B/C block matching 是这篇文章里很实用的模型融合细节。

Attention bias 是一个很朴素但有效的想法:让每个 3D token 多看真正覆盖它的图像 patch,尤其适合解决对称几何上的非对称纹理贴错问题。

时间步加权监督很值得记住:当 noisy latent 中没有足够几何信息时,不应该强行用点图监督;低噪声阶段才让前馈分支对齐到可恢复的 3D 结构。

这篇文章把“生成完整性”和“输入忠实性”放到了同一个框架里,是 3D 生成模型从好看走向可控、可测、可对齐的一步。