GaussianGPT: Towards Autoregressive 3D Gaussian Scene Generation

作者:Nicolas von Lützow, Barbara Rössle, Katharina Schmid, and Matthias Nießner

单位:Technical University of Munich

会议:2026 Arxiv

链接:https://arxiv.org/pdf/2603.26661v1

研究动机

1.三维场景的生成是一个逐渐拓展的过程,因此需要将三维空间视为结构化的序列,逐步重建

2.当前的三维生成方法虽然质量高,但是全局生成,无法进行补全、拓展、编辑。

核心方法

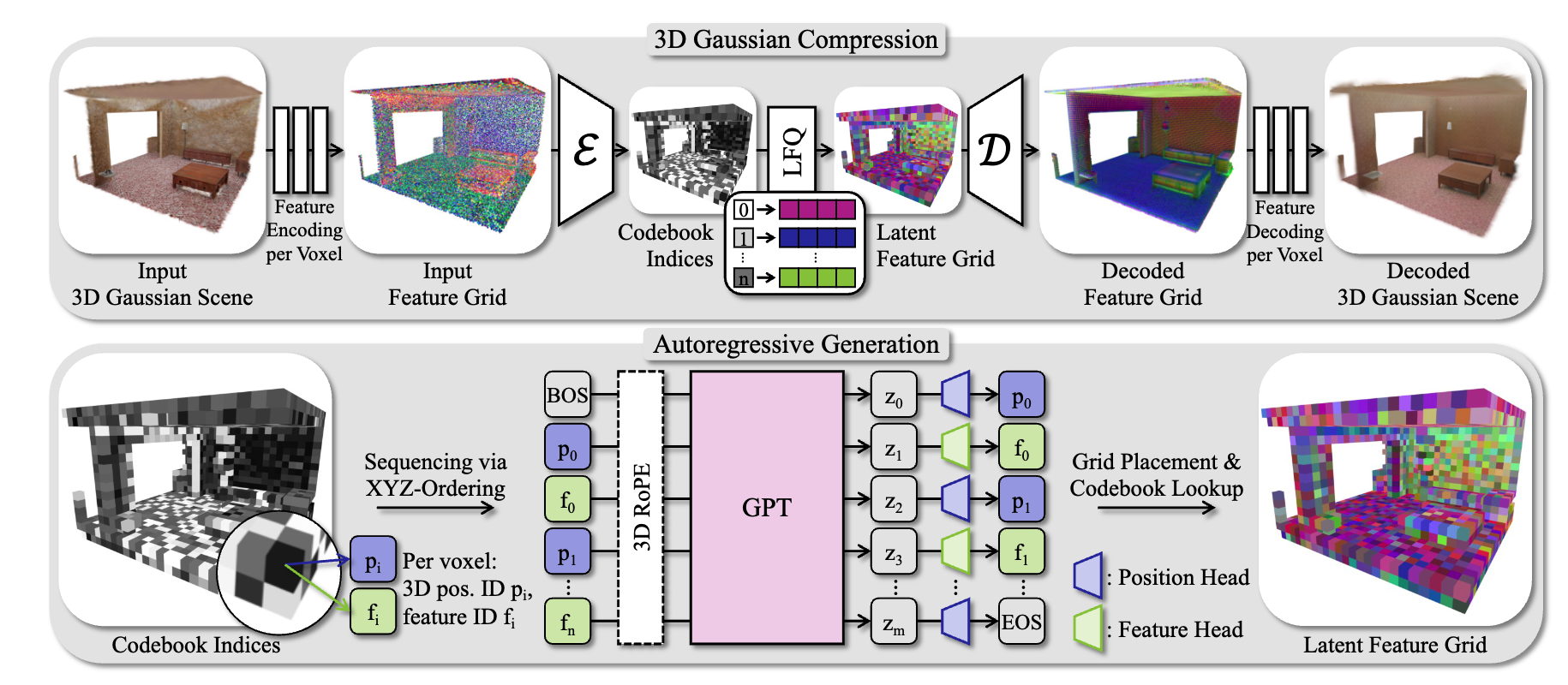

1.基于稀疏三维潜在编码的场景压缩

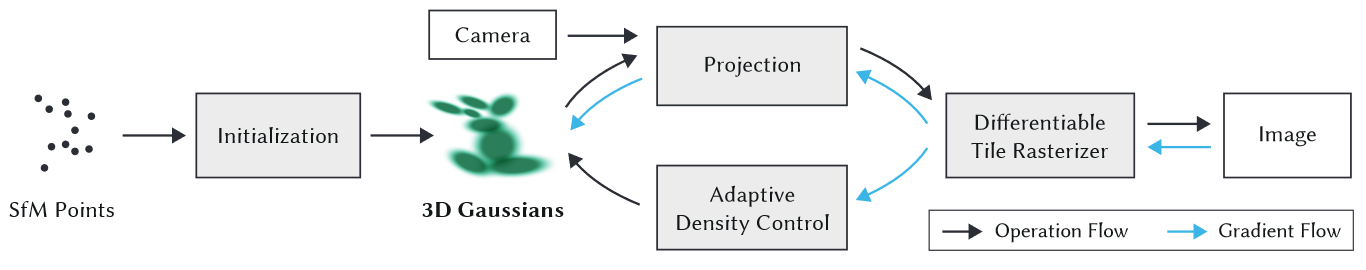

将高斯元投影为三维特征网格:根据三维高斯元的位置分配到对应的体素网格中,并用他们相对体素中心的偏移量代替绝对位置。若体素中包含多个高斯元,则进行采样。然后用一个轻量化的编码器编码为高斯特征

使用稀疏三维卷积自编码器编码网格:采用编码器将网格编码为紧凑的潜在表示,解码器则重建出体素级的特征

通过向量量化离散化潜在表示:编码器的输入根据符号离散化为0和1并对应codebook的索引

2.三维潜在网格的自回归建模

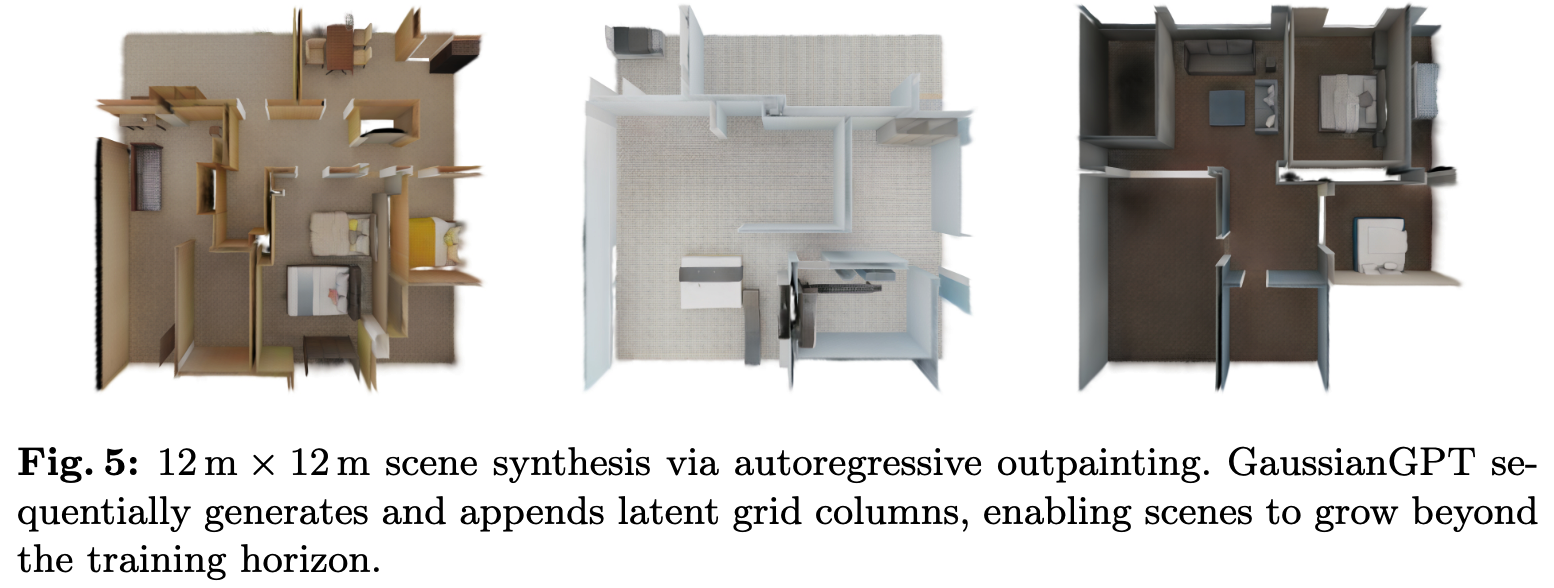

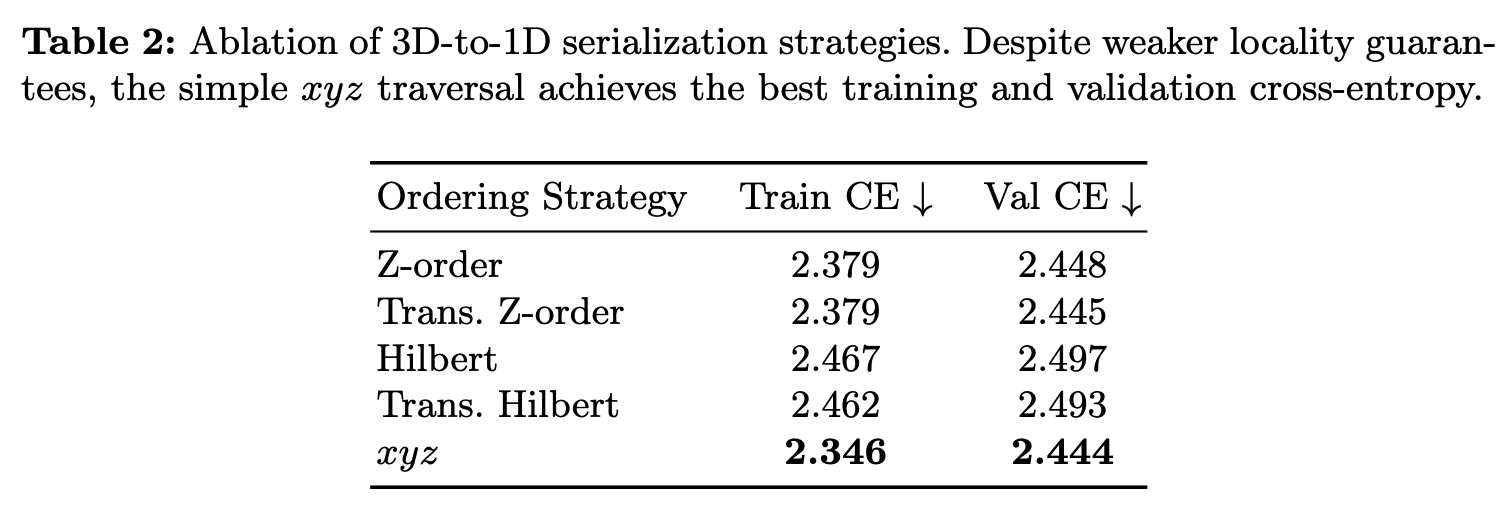

依据(x,y)位置进行遍历,虽然无法保留三维空间的局部性,但是排序简单且可解释。然后将位置token和feature token进行交错排列,为了限制序列长度,在chunks上进行处理。

为位置token与特征token设置了不同的词汇表,位置预测Head预测下一个被占用的体素索引,特征预测Head预测前一个位置的特征,位置与特征分离,互不干扰

采用3D RoPE进行位置编码,并添加第四个维度,来表示位置token以及特征token的不同类型

采用GPT-2架构,使用Muon优化器

数据集

Aria Synthetic Environments (ASE),3D-FRONT,PhotoShape

算力

4张A6000,4张H200

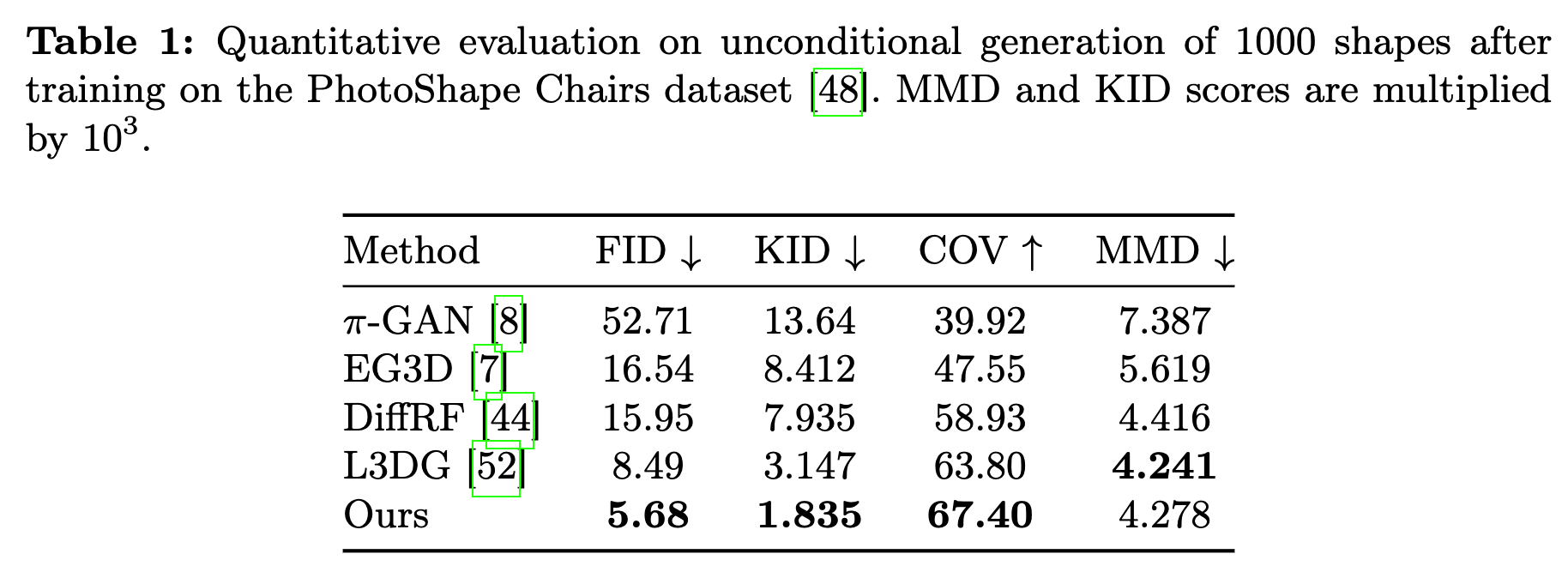

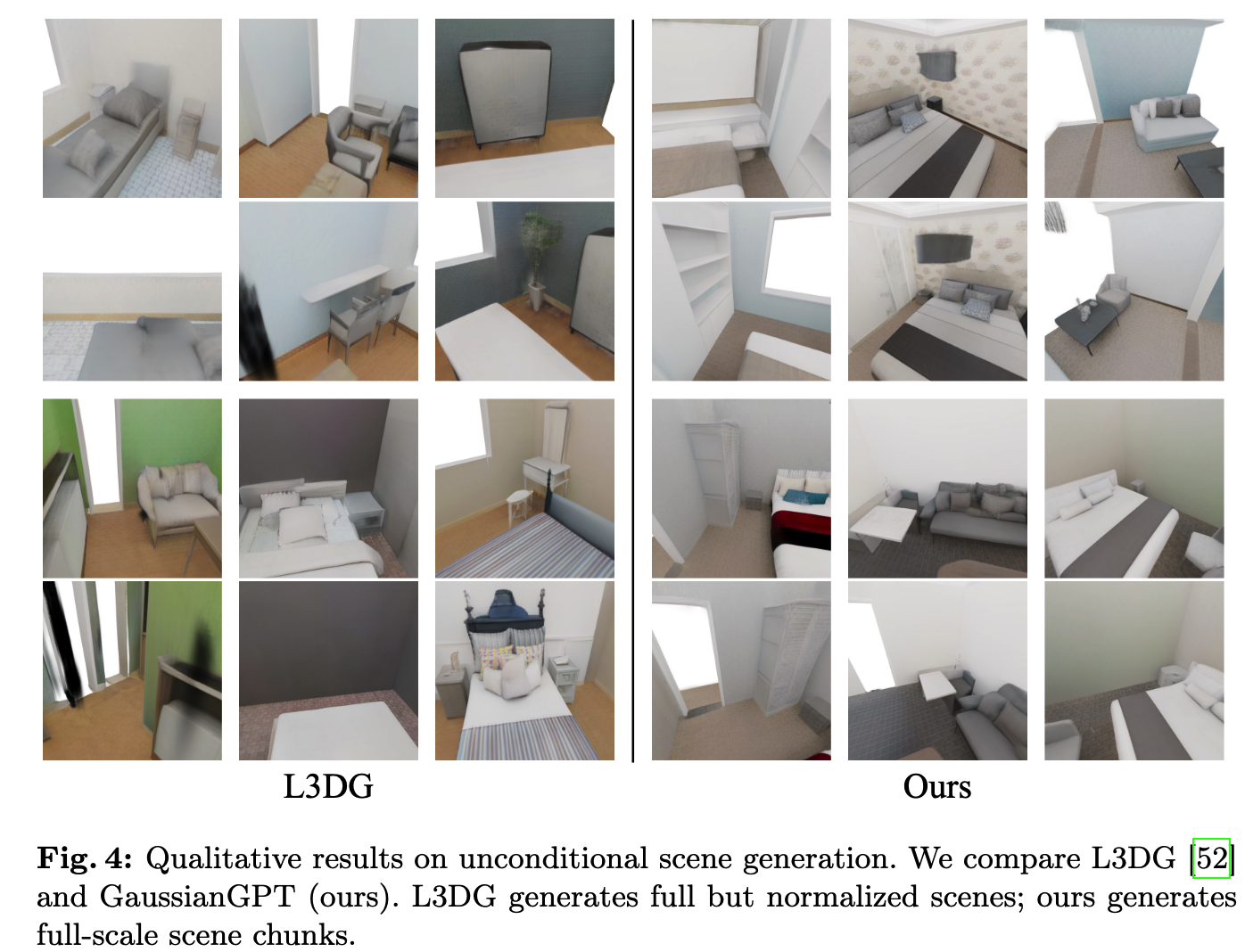

实验结果

优势与不足

优势

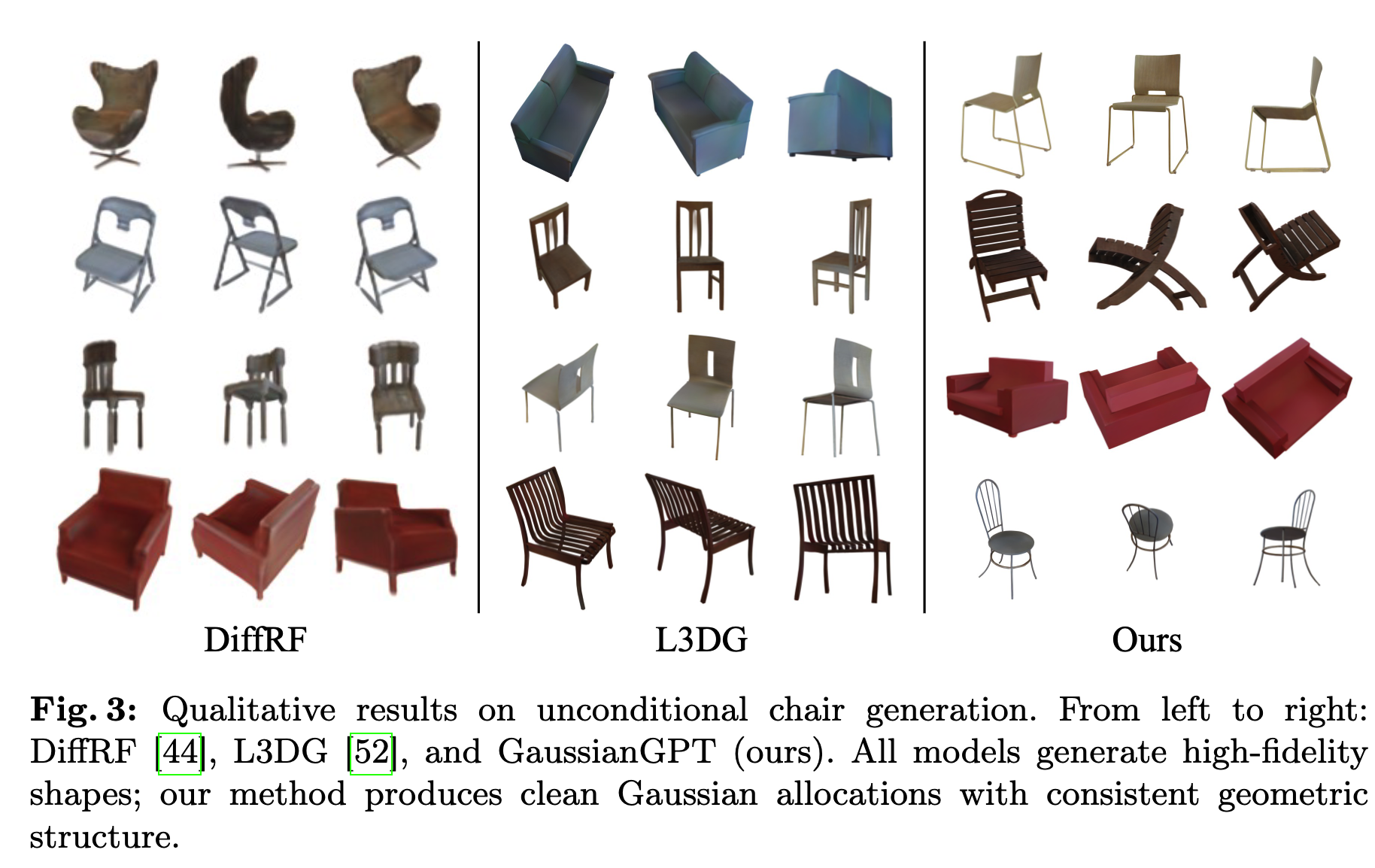

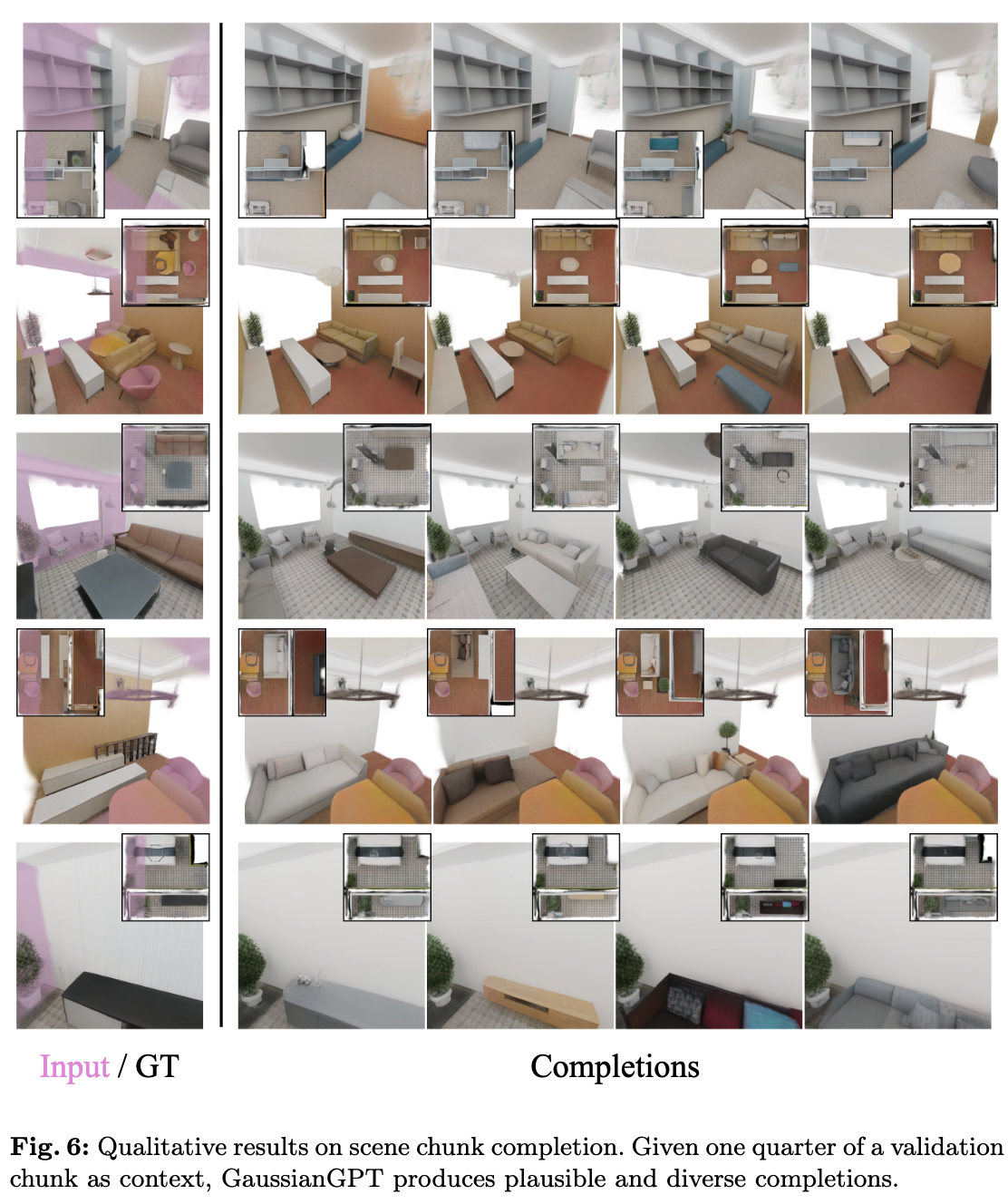

1.利用自回归的建模方式,实现了渐进式的三维场景生成建模,能够应用于生成,场景补全,外扩等多个任务

2.位置特征分离建模

3.可控生成过程

不足

1.生成效率低

2.受编解码压缩性能限制

3.长序列建模可能会存在不一致问题

记忆点

1.位置、特征token分离建模预测